Лидеры мира IT и науки подписали открытое письмо с призывом запретить разработку автономных военных роботов, о чем стало известно из официального пресс-релиза компании FutureOfLife, занимающейся созданием петиций и сбором подписей. Среди всем известных личностей можно выделить гениального физика Стивена Хокинга, сооснователя Apple Стива Возняка, и главу Tesla Илона Маска.

Из опубликованного текста следует, что решение о подписании появляется в умах действительно великих людей из-за угрозы очередной «гонки вооружений».

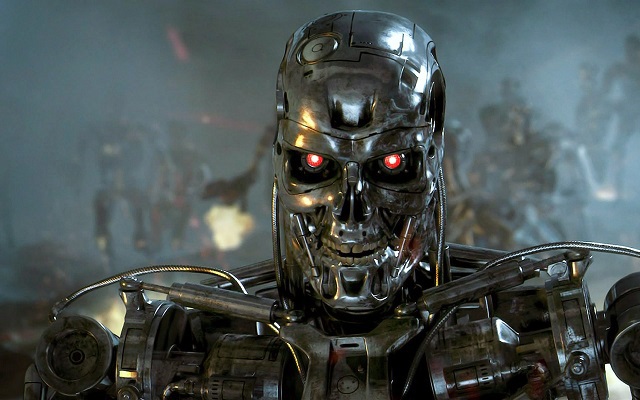

«Автономное оружие выбирает и стреляет в цели без человеческого вмешательства. Они могли бы, например, решить убрать того или иного человека, не соответствующего неким собственным критериям, так что это не относится к пилотируемым людьми дронам и крылатым ракетам. Технология Искусственного интеллекта (AI) достигла точки, где развертывание таких систем — если это не запретить — вполне реализуемый проект в течение ближайших десяти лет. Давайте мы напомним, что автономное оружие было описано ранее, как третья революция в войне после пороха и ядерного оружия», – гласит текст письма.

«Разумеется, многое говорит и в пользу автономного оружия. Например, фактически полная замена человеческого фактора на поле боя, а значит и сохранение большинства жизней участников войны. Но не стоит забывать, что создание подобного AI приведет к самым разрушительным последствиям: начнется гонка вооружений, а мы помним, до чего она довела в прошлый раз (карибский кризис – прим. авт.). Кроме того, данный вид оружия окажется достаточно дешевым, и подобные силы появятся на вооружении у многих армий мира, а того и гляди – у террористов. Автономное оружие идеально подходит для таких задач, как убийство, дестабилизируя при этом страны, подчиняя население и выборочно убивая особую этническую группу.

Как и химики с биологами когда-то поддержали запрет на ядерное оружия, так и сотрудники компаний по созданию интеллектуального оружия должны воспротивиться этому, ибо создание такого средства уничтожения просто снизит нашу социальную значимость.

Мы считаем, что знаний и умений у AI не достаточно для совершения чего-то действительно стоящего и полезного для человечества, так пускай они на это и ориентируются. Начинать гонку интеллектуальных автономных вооружений – очень плохая идея и должна быть предотвращена посредством запрета на создание смертельного оружия вне человеческого контроля», — завершается обращение к мировому сообществу.

Как ожидается, петиция будет официальна зачитана в ходе международной конференции по искусственному интеллекту в Буэнос-Айресе.

Автор: adiunov