Чем хороши большие JBOD’ы?

Новый JBOD Western Digital на 102 диска по 12ТБ получился мощным. При разработке этого JBOD были учтены предыдущий опыт с двумя поколениями 60-дисковых полок.

Data102 получился на редкость для таких гигантов сбалансированным по объему и производительности.

Зачем же нужны такие большие дисковые корзины, когда в мире растет популярность гиперконвергентных систем?

Задачи, при которых требования по объемам хранения значительно превышают требования по вычислительной мощности, могут раздуть бюджет заказчика до невероятных размеров. Вот лишь несколько примеров и сценариев:

- Replication Factor 2 или 3, применяемый при строительстве Scale-out систем, на нескольких петабайтах данных — решение недешевое.

- Интенсивные последовательные операции чтения/записи заставляют узел кластера выходить за пределы локального хранилища, что грозит такими проблемами, как long-tail latency. В этом случае следует предельно внимательно отнестись к построению сети.

- Распределенные системы прекрасно справляются с задачами типа «множество приложений работают с множеством своих файлов» и посредственно справляются с записью и чтением с сильно-связанного кластера, особенно в режиме N-to-1.

- При задачах типа «увеличить глубину видеоархива в 2 раза» гораздо дешевле накинуть большой JBOD, чем увеличить количество серверов в кластере в 2 раза.

- Используя внешние СХД с JBOD, мы можем четко выделить для наших приоритетных приложений объем и производительность, зарезервировав для них определенные диски, кэш, порты, и при этом сохранив необходимый уровень гибкости и масштабируемости.

Как правило, дисковые полки уровня Data102 разрабатывается производителями дисков, которые хорошо понимают, как с этими дисками работать и знают все подводные камни. В таких устройствах все в порядке с уровнем вибрации и охлаждением, а энергопотребление соответствует реальным потребностям по хранению данных.

Чем хорош JBOD от Western Digital?

Мы прекрасно понимаем, что модульные системы ограничены по масштабируемости возможностями контроллеров и что сеть всегда создает задержки. Но при этом такие системы обладают более низким стоимостью IOps, GBps и ТБ хранения.

Есть две вещи, за которые инженеры RAIDIX полюбили Data102:

- JBOD не просто позволяет разместить > 1 PB данных на 4U. Он реально очень быстрый и на потоковых операциях не уступает многим all-flash решениям: 4U, 1PB, 23 ГБ/с — хорошие показатели для дискового массива.

- Data102 прост в обслуживании и не требует инструментов, вроде отвертки.

Сотрудники нашей группы тестирования ненавидят отвертки, которые уже снятся им по ночам. Когда они услышали, что HGST/WD делает 102-дискового монстра, и представили, как придется иметь дело с 408 мелкими винтиками, в соседнем магазине закончился крепкий алкоголь.

Зря боялись. Заботясь об инженерах, в Western Digital придумали новый способ крепления диска, который позволяет облегчить обслуживание. Диски крепятся к шасси c помощью фиксирующих зажимов, без болтов и винтов. Все диски механически изолируются с помощью эластичных крепежей на задней панели. Новая прошивка сервопривода и акселерометры отлично компенсируют вибрацию.

Что у нас в коробке?

В коробке — корпус корзины, набитый дисками. Купить можно минимум 24 диска, а масштабируется решение наборами по 12 дисков. Делается это для того, чтобы обеспечить правильное охлаждение и бороться с вибрацией наилучшим образом.

Кстати, именно развитие двух вспомогательных технологий — IsoVibe и ArcticFlow — сделали возможным рождение нового JBOD’а.

Состоит IsoVibe из следующих компонентов:

- Специализированная прошивка дисков, которая с помощью датчиков управляет сервоприводами и предиктивно снижает уровень вибраций.

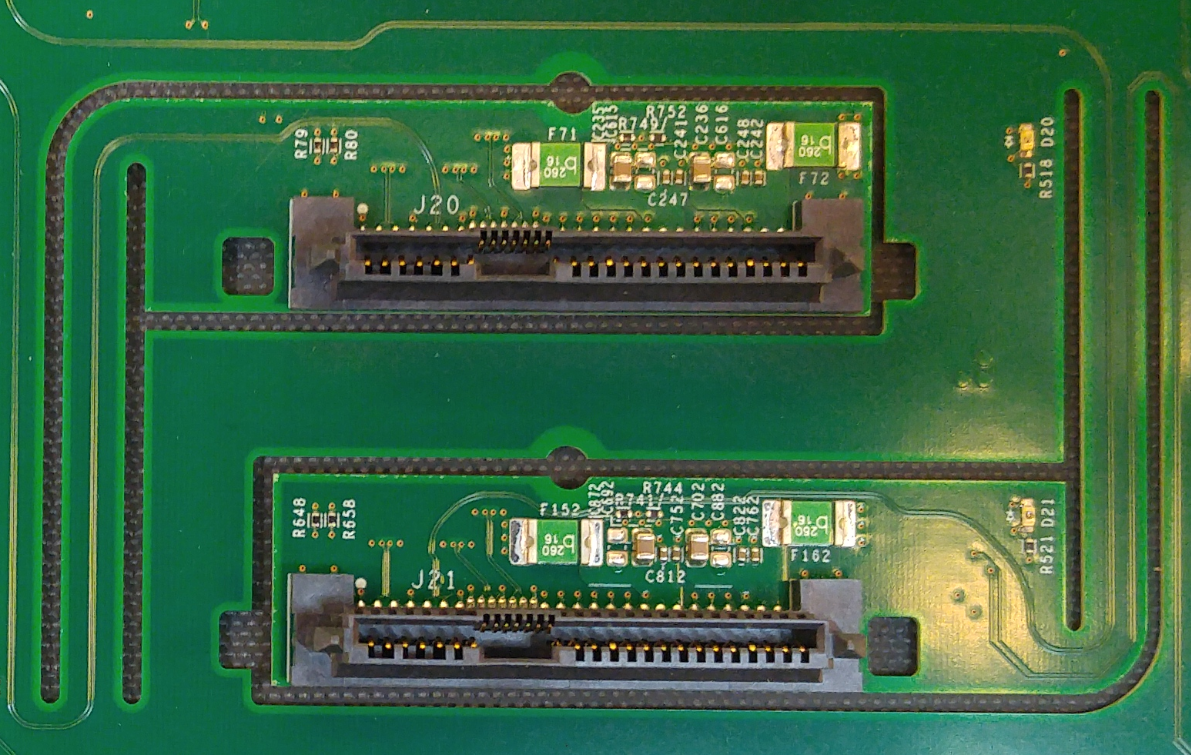

- Вибрационно изолированные разъемы на задней панели сервера (рис. 1).

- Ну и, конечно, специальные крепления дисков, которые не требуют винтов.

Рис. 1. Вибрационно изолированные разъемы

Температура — это второй после вибрации фактор, убивающий жесткие диски. При средней температуре работы выше 55C, наработка на отказ жесткого диска будет в два раза меньше расчетной.

Особенно от плохо охлаждения страдают серверы с большим количеством дисков и большие дисковые полки. Зачастую задние ряды дисков греются на 20 и более градусов больше, чем диски, находящиеся вблизи от холодного коридора.

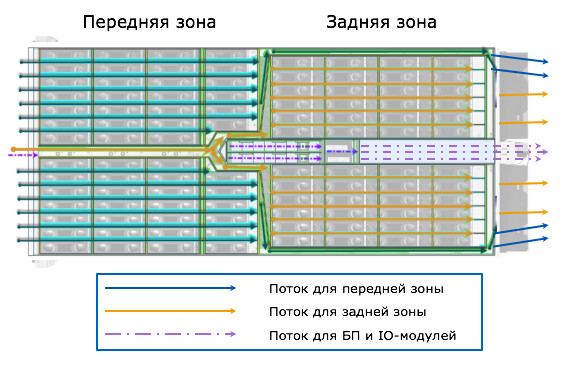

ArcticFlow — это запатентованная Western Digital технология охлаждения полки, смысл которой заключается в создании дополнительных воздуховодов внутри шасси, которые позволяют протягивать холодный воздух к задним рядам дисков напрямую из холодного коридора, минуя передние ряды.

Рис. 2. Принцип работы ArcticFlow

Отдельный поток холодного воздуха построен для охлаждения модулей ввода-вывода и блоков питания.

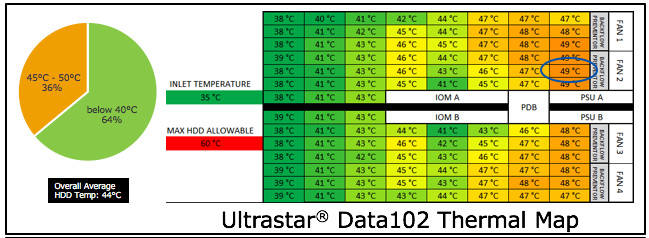

Результат — великолепная термальная карта работающей полки. Разброс температур между передними и задними рядами дисков — 10 градусов. Самый горячий диск — 49C при температуре в «холодном» коридоре +35C. На охлаждение каждого диска тратится 1.6Вт — в два раза меньше, чем у других подобных шасси. Вентиляторы работают тише, вибрация меньше, диски живут дольше и работают быстрее.

Рис. 3. Температурная карта Ultrastar Data 102

Учитывая бюджет по питанию в 12Вт на один диск, полку легко можно сделать гибридной — из 102 дисков 24 могут быть SAS SSD. Их можно установить и использовать как в гибридном режиме, так и настроив SAS Zoning и передав хосту, нуждающемуся в all-flash.

Еще у нас в коробке есть салазки для крепления в стойку. Для установки JBOD нужна парочка физически сильных инженеров. Вот с чем они столкнутся:

- Полка в сборе весит 120 кг, а без дисков — 32 кг

- Глубокая стойка в данном случае начинается от 1200 мм

- Ну и добавляем кабели SAS и питания

.

Крепления и кабелировка JBOD разработаны таким образом, что можно «на горячую» выполнять обслуживание. Отметим также вертикальную установку модуля ввода-вывода (IOM).

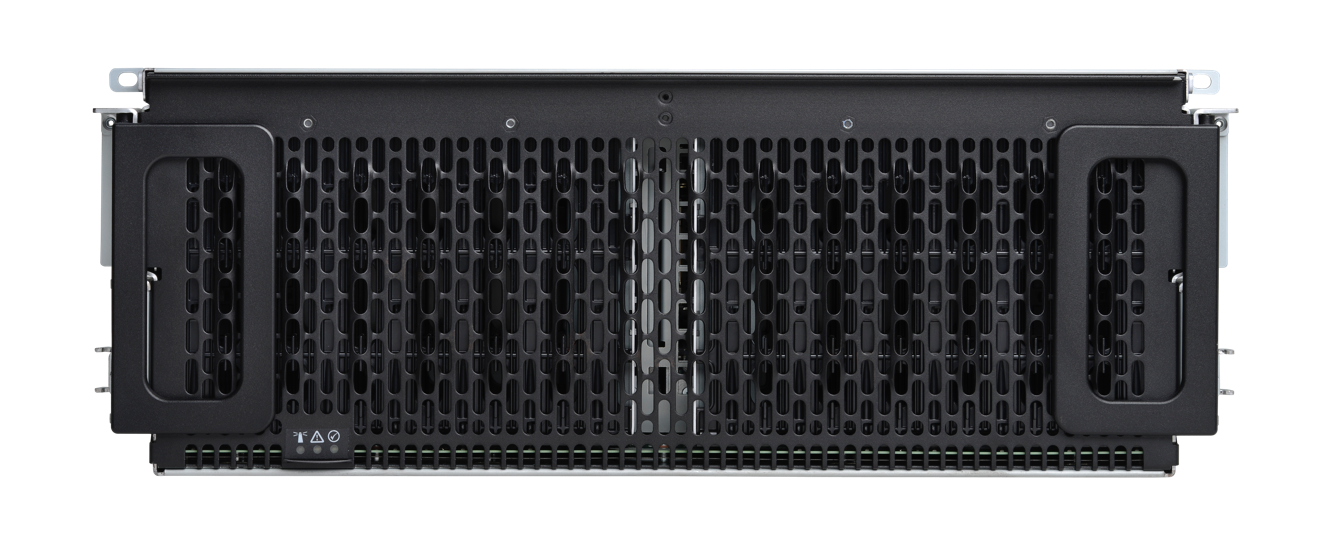

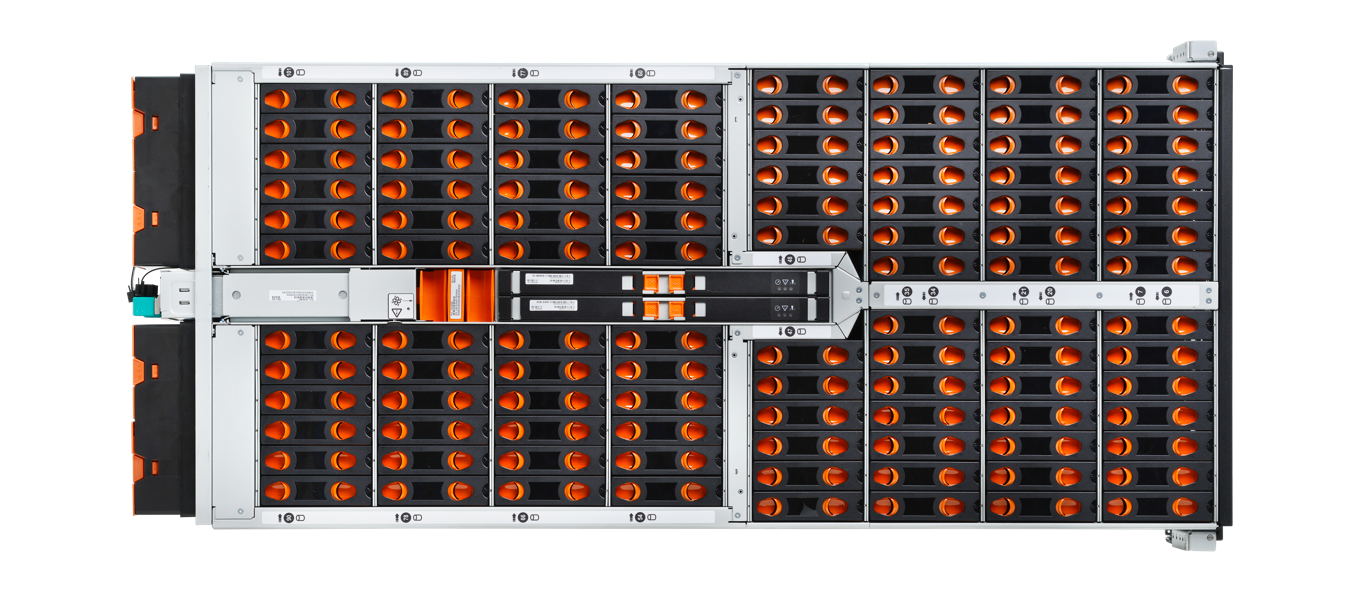

Давайте взглянем на эту систему. Спереди все просто и лаконично.

Рис. 4. Ultrastar Data 102. Вид спереди

Одной из самых интересных особенностей JBOD является установка IO-модулей сверху!

Рис. 5. Ultrastar Data 102

Рис. 6. Ultrastar Data 102. Вид сверху

Рис. 7. Ultrastar Data 102. Вид снизу

Сзади у JBOD для каждого IO-модуля есть по 6 SAS 12G портов. Итого мы получаем 28800 MBps пропускной способности бэкенда. Порты можно использовать как только для подключения к хостам, так и частично для каскадирования. Портов для питания системы два (80+ Platinum rated 1600W CRPS).

Рис. 8. Ultrastar Data 102. Вид сзади

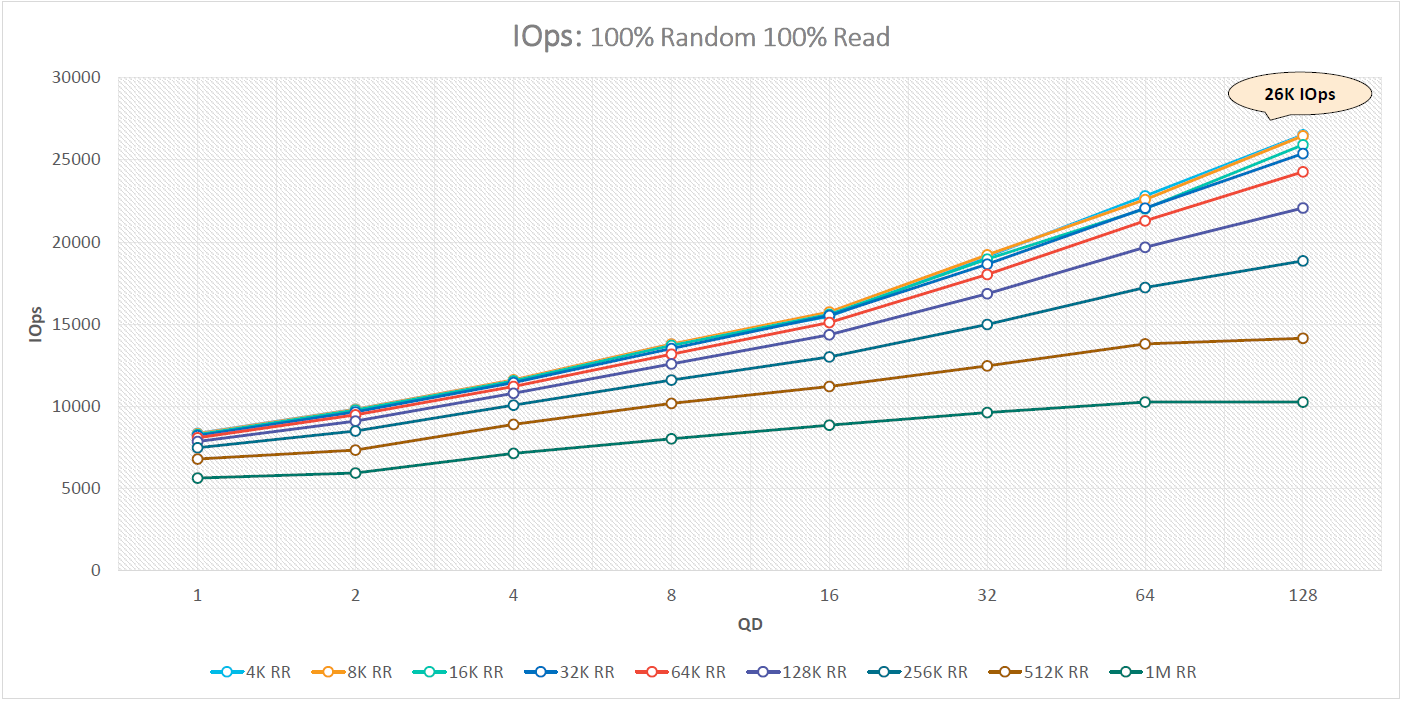

Производительность

Как мы и говорили, Data102 не просто огромен — он быстрый! Результаты тестов, проведенных вендором, таковы:

На 12 серверов:

Последовательная нагрузка

- Чтение = 24.2GB/s max. @ 1MB (237 MB/s per HDD max.)

- Запись =23.9GB/s max. @ 1MB (234 MB/s per HDD max.)

Случайная нагрузка

- Чтение 4kB с глубиной очереди = 128: >26k IOps

- Запись 4kB с глубиной очереди 1–128: >45k IOps

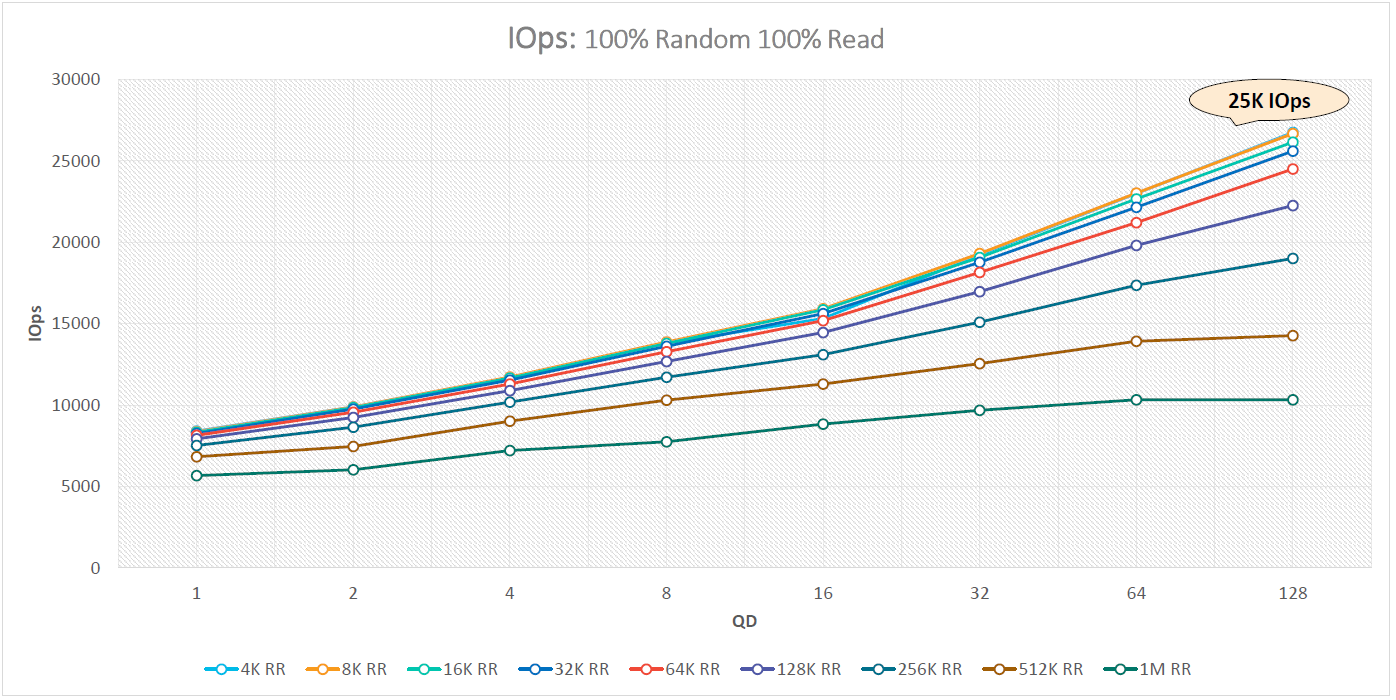

На 6 серверов:

Последовательная нагрузка

- Чтение = 22.7GB/s max. @ 1MB (223 MB/s per HDD max.)

- Запись =22.0GB/s max. @ 1MB (216 MB/s per HDD max.)

Случайная нагрузка

- Чтение 4kB с глубиной очереди = 128: >26k IOps

- Запись с глубиной очереди = 1–128: >45k IOps

Рис. 9. Параллельная нагрузка с 12-ти серверов

Рис. 10. Параллельная нагрузка с 6-ти серверов

Управление

Управлять JBOD со стороны софта можно двумя способами:

- По SES

- По RedFish

RedFish позволяет находить компоненты, зажигая LED, получать информацию о «здоровье» компонентов, а также обновлять прошивку.

Кстати, шасси поддерживает T10 Power Disabling (Pin 3) для отключения питания и ресета индивидуальных дисков.

Это полезно использовать, если у вас диск подвешивает всю SAS-шину.

Типовые конфигурации

Для того, чтобы использовать возможности такого JBOD с максимальной пользой, нам потребуются RAID-контроллеры или программное обеспечение. Здесь на выручку и приходит ПО RAIDIX.

Для создания отказоустойчивой СХД нам потребуются два узла хранения и одна или более корзин с SAS дисками. Если же мы не хотим внедрять защиту от отказа узла или использовать репликацию данных, то можно подключить к корзине один сервер и использовать SATA диски.

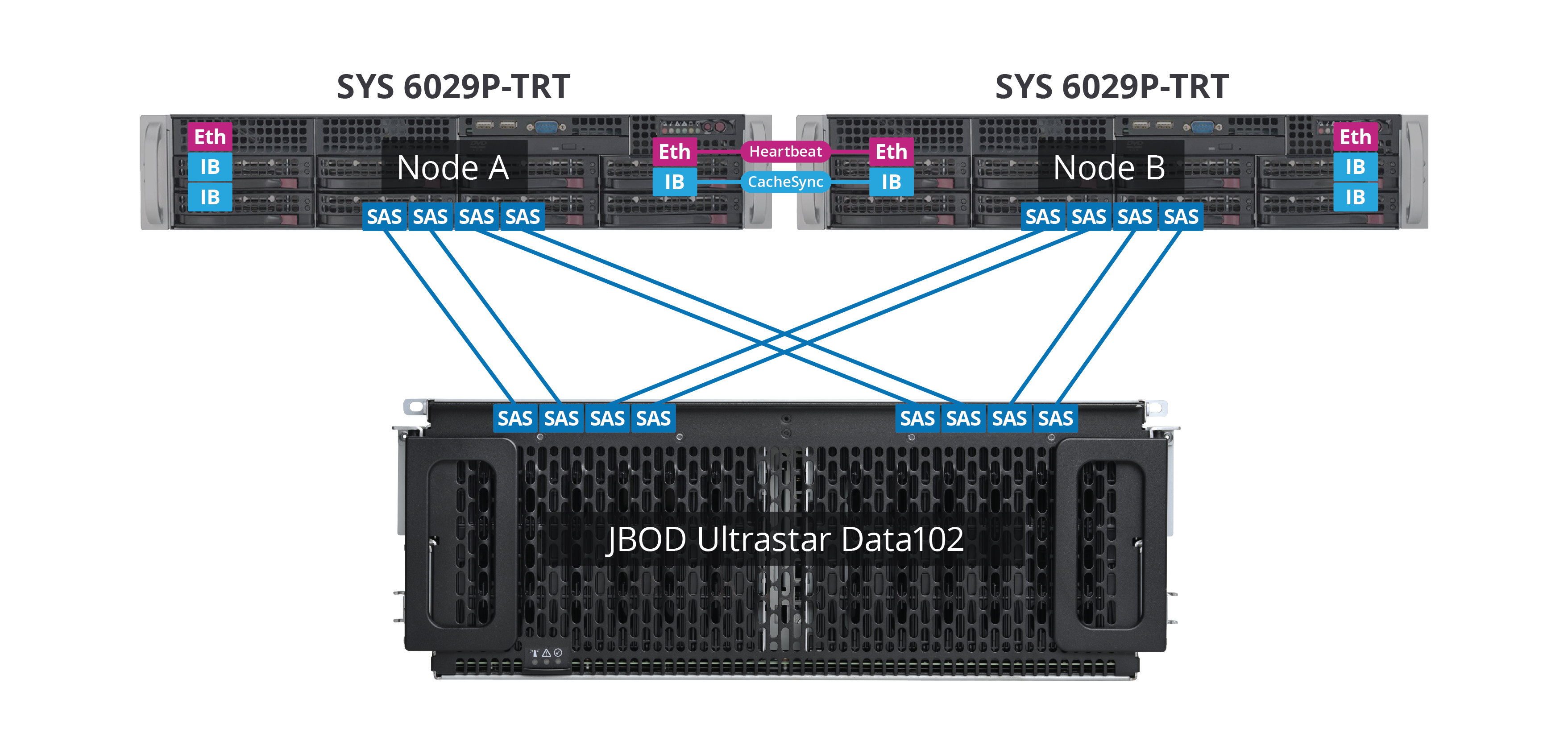

Двухконтроллерная конфигурация

В качестве контроллеров для СХД на основе RAIDIX могут использоваться практически любые серверные платформы архитектуры x86: Supermicro, AIC, Dell, Lenovo, HPE и многие другие. Мы постоянно ведем работу над сертификацией нового оборудования и портируем наш код под различные архитектуры (например, «Эльбрус» и OpenPower).

Для примера возьмем платформу Supermicro и попытаемся достичь максимально возможной пропускной способности и плотности вычислений. При «сайзинге» серверов будем использовать шину PCI-E, куда установим back-end и front-end контроллеры.

Также нам понадобятся контроллеры для подключения дисковой полки, не менее двух AVAGO 9300-8e. Альтернативно: пара 9400-8e или один 9405W-16e, но для последнего понадобится полноценный слот x16.

Следующий компонент — слот для канала синхронизации. Это может быть Infiniband или SAS. (Для задач, где пропускная способность и задержки не критичны, можно обойтись синхронизацией через корзину без выделенного слота.)

Ну и, конечно, нам будут нужны слоты для хост-интерфейсов, которых тоже должно быть никак не менее двух.

Итого: каждому контроллеру нужно иметь от 5 слотов x8 (без запаса для дальнейшего масштабирования). Для построения недорогих систем, ориентированных на производительность в 3–4 ГБ/с на узел мы можем обойтись всего двумя слотами.

Варианты конфигурации контроллеров

Supermicro 6029P-TRT

Контроллеры можно разместить в двух 2U серверах 6029P-TRT. Они не самые богатые в плане PCI-E cлотов, но зато них установленная стандартная материнская плата без рейзеров. На этих платах гарантированно «заведутся» NVDIMM-N модули от Kingston для защиты кэша от отказов питания.

Для подключения дисков возьмем Broadcom 9400 8e. Грязные сегменты кэша будем синхронизировать через IB 100Gb.

Внимание! Приведенные ниже конфигурации рассчитаны на максимальную производительность и функционирование всех имеющихся опций. Для вашей конкретной задачи спецификация может быть существенно сокращена. Обращайтесь к нашим партнерам.

Конфигурация системы, которая у нас получилась:

| № | Наименование | Описание | P/N | Кол-во на один RAIDIX DC |

|---|---|---|---|---|

| 1 | Платформа | SuperServer 6029P-TRT | SYS-6029P-TRT | 2 |

| 2 | CPU | Intel Xeon Silver 4112 Processor | Intel Xeon Silver 4112 Processor | 4 |

| 3 | Memory | 16GB PC4-21300 2666MHz DDR4 ECC Registered DIMM Micron MTA36ASF472PZ-2G6D1 | MEM-DR416L-CL06-ER26 | 12 |

| 4 | System Disk | SanDisk Extreme PRO 240GB | SDSSDXPS-240G-G25 | 4 |

| 5 | Hot-swap 3.5" to 2.5" SATA/SAS Drive Trays | Tool-less black hot-swap 3.5-to-2.5 converter HDD drive tray (Red tab) | MCP-220-00118-0B | 4 |

| 6 | HBA for cache-sync | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 7 | HBA for JBOD connection | Broadcom HBA 9400-8e Tri-Mode Storage Adapter | 05-50013-01 | 4 |

| 8 | Ethernet patchcord | Ethernet patch cord for cache sync 0.5m | 1 | |

| 9 | Cable for cache sync | Mellanox passive copper cable, VPI, EDR 1m | MCP1600-E001 | 2 |

| 10 | HBA for host connection | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 11 | SAS cable | Storage Enclosure Ultrastar Data102 Cable IO HD mini-SAS to HD mini-SAS 2m 2Pack | 8 | |

| 12 | JBOD | Ultrastar Data102 | 1 | |

| 13 | RAIDIX | RAIDIX 4.6 DC/NAS/iSCSI/FC/SAS/IB/SSD-cache/QoSmic/SanOpt/Extended 5 years support/unlimited disks/ | RX46DSMMC-NALL-SQ0S-P5 | 1 |

Вот примерная схема:

Рис. 11. Конфигурация на базе Supermicro 6029P-TRT

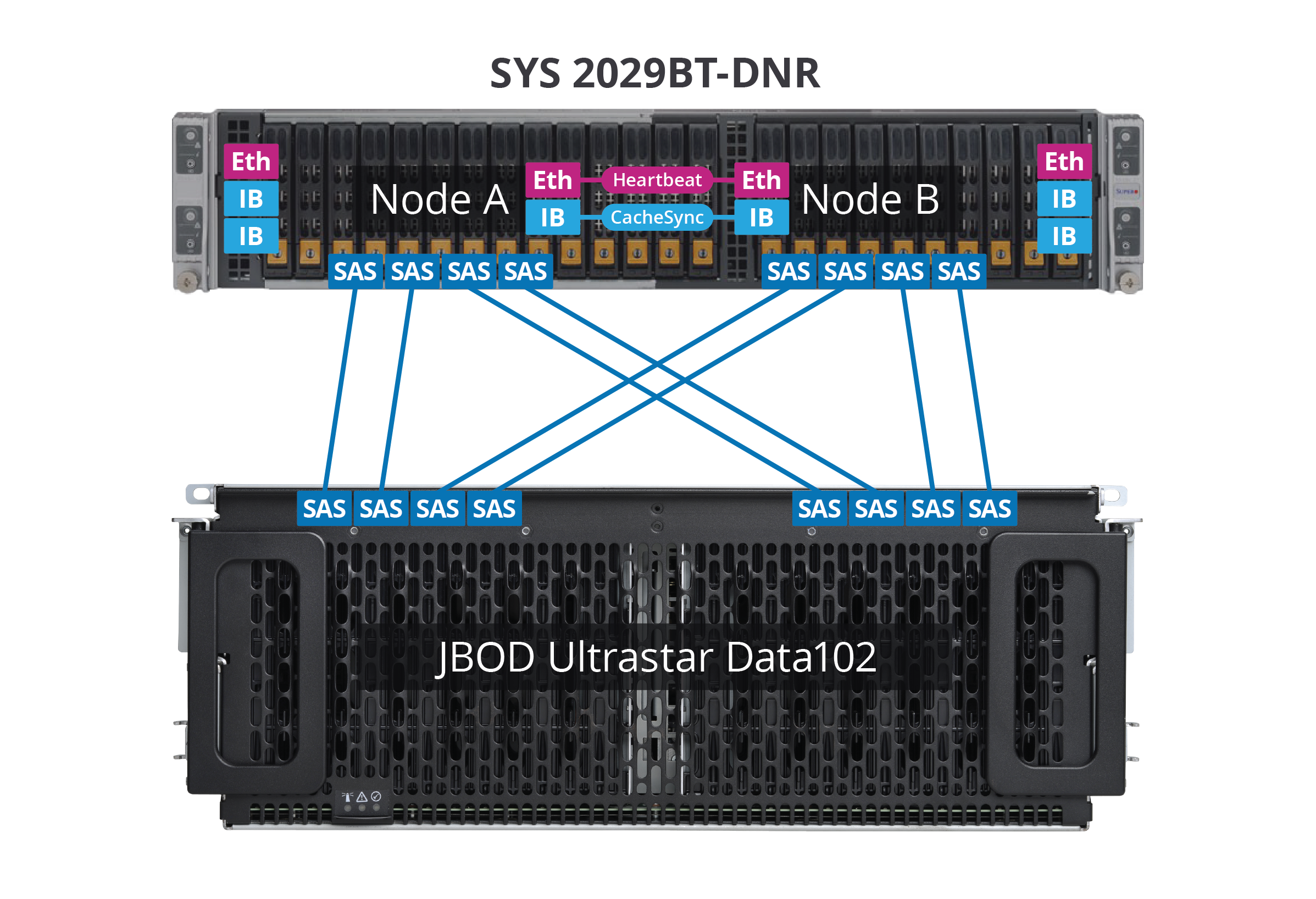

Supermicro 2029BT-DNR

Если мы хотим побороться за пространство в серверной, то за основу контроллеров хранения можно взять Supermicro Twin, например, 2029BT-DNR. Данные системы имеют по 3 PCI-E слота и по одному IOM-модулю. Среди IOM есть нужный нам Infiniband.

Конфигурация:

| № | Наименование | Описание | P/N | Кол-во на один RAIDIX DC |

|---|---|---|---|---|

| 1 | Платформа | SuperServer 2029BT-DNR | SYS-2029BT-DNR | 1 |

| 2 | CPU | Intel Xeon Silver 4112 Processor | Intel Xeon Silver 4112 Processor | 4 |

| 3 | Memory | 16GB PC4-21300 2666MHz DDR4 ECC Registered DIMM Micron MTA36ASF472PZ-2G6D1 | MEM-DR416L-CL06-ER26 | 12 |

| 4 | System Disk | Supermicro SSD-DM032-PHI | SSD-DM032-PHI | 2 |

| 5 | HBA for cache-sync | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 6 | HBA for JBOD connection | Broadcom HBA 9405W-16e Tri-Mode Storage Adapter | 05-50044-00 | 2 |

| 7 | Ethernet patchcord | Ethernet patch cord for cache sync 0.5m | 1 | |

| 8 | Cable for cache sync | Mellanox passive copper cable, VPI, EDR 1m | MCP1600-E001 | 2 |

| 9 | HBA for host connection | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 10 | SAS cable | Storage Enclosure Ultrastar Data102 Cable IO HD mini-SAS to HD mini-SAS 2m 2Pack | 8 | |

| 11 | JBOD | Ultrastar Data102 | 1 | |

| 12 | RAIDIX | RAIDIX 4.6 DC/NAS/iSCSI/FC/SAS/IB/SSD-cache/QoSmic/SanOpt/Extended 5 years support/unlimited disks | RX46DSMMC-NALL-SQ0S-P5 | 1 |

Вот примерная схема:

Рис. 12. Конфигурация на базе Supermicro 2029BT-DNR

Платформа 1U

Часто возникают задачи, где требуется максимальная плотность размещения больших объемов данных, но не требуется, например, полная отказоустойчивость по контроллерам. В этом случае мы берем за основу систему 1U и подключаем к ней максимальное количество дисковых полок.

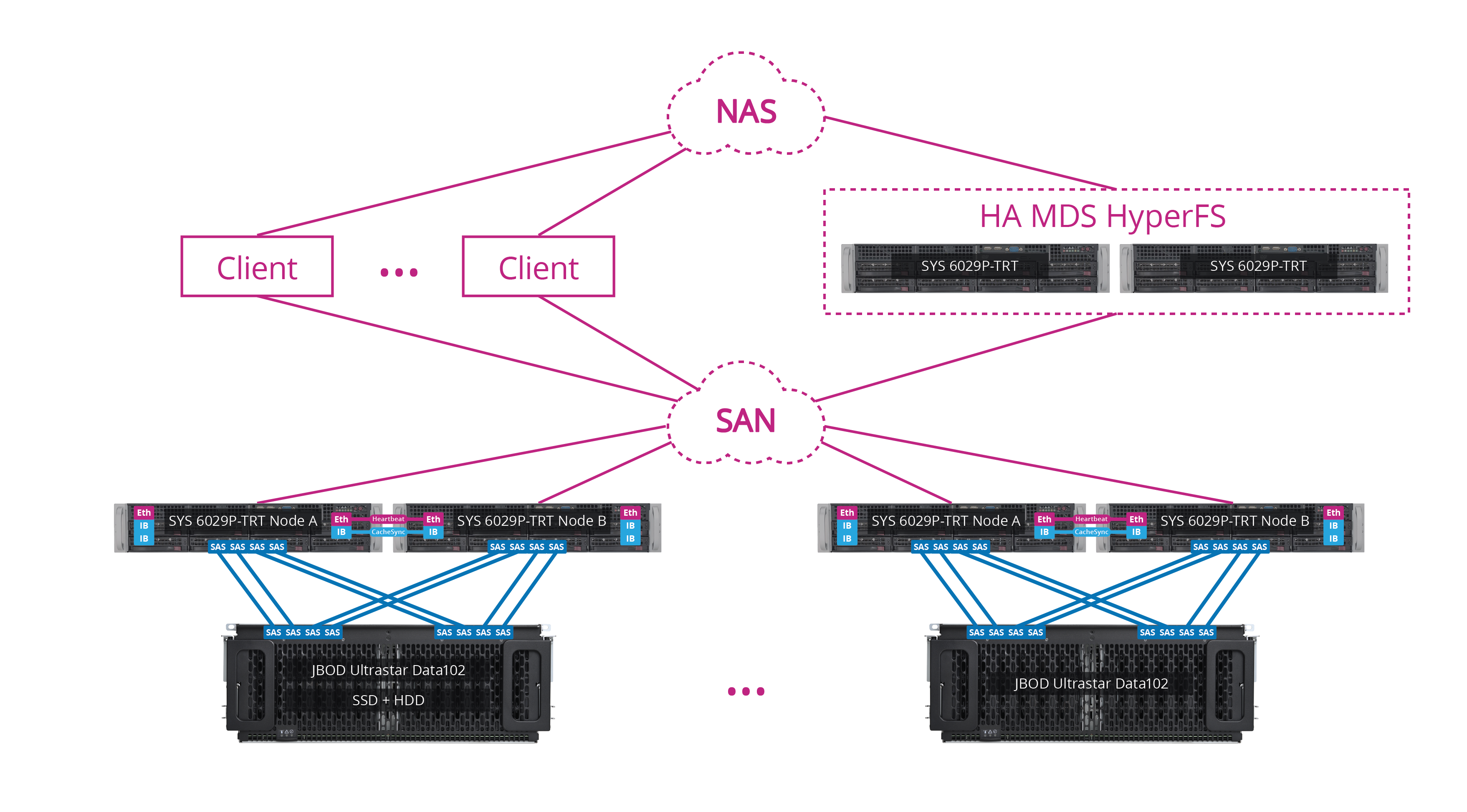

Scale-Out система

В качестве последнего упражнения в нашей тренировке построим горизонтально-масштабируемую систему на основе HyperFS. Для начала мы выберем 2 типа контроллеров – для хранения данных и для хранения метаданных.

Контроллерами хранения назначим SuperMicro 6029P-TRT.

Для хранения метаданных используем несколько SSD дисков в корзине, которые мы объединим в RAID и отдадим MDC через SAN. На одну систему хранения мы можем подключить до 4 JBOD каскадом. Итого в одной глубокой стойке размещаем X PB данных с единым пространством имен.

| № | Наименование | Описание | P/N | Кол-во на один RAIDIX DC |

|---|---|---|---|---|

| 1 | Платформа | SuperServer 6029P-TRT | SYS-6029P-TRT | 2 |

| 2 | CPU | Intel Xeon Silver 4112 Processor | Intel Xeon Silver 4112 Processor | 4 |

| 3 | Memory | 16GB PC4-21300 2666MHz DDR4 ECC Registered DIMM Micron MTA36ASF472PZ-2G6D1 | MEM-DR416L-CL06-ER26 | 16 |

| 4 | System Disk | SanDisk Extreme PRO 240GB | SDSSDXPS-240G-G25 | 4 |

| 5 | Hot-swap 3.5" to 2.5" SATA/SAS Drive Trays | Tool-less black hot-swap 3.5-to-2.5 converter HDD drive tray (Red tab) | MCP-220-00118-0B | 4 |

| 6 | HBA for cache-sync | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 7 | HBA for JBOD connection | Broadcom HBA 9400-8e Tri-Mode Storage Adapter | 05-50013-01 | 4 |

| 8 | Ethernet patchcord | Ethernet patch cord for cache sync 0.5m | 1 | |

| 9 | Cable for cache sync | Mellanox passive copper cable, VPI, EDR 1m | MCP1600-E001 | 2 |

| 10 | HBA for host connection | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 11 | SAS cable | Storage Enclosure Ultrastar Data102 Cable IO HD mini-SAS to HD mini-SAS 2m 2Pack | 8 | |

| 12 | JBOD | Ultrastar Data102 | 1 | |

| 13 | RAIDIX | RAIDIX 4.6 DC/NAS/iSCSI/FC/SAS/IB/SSD-cache/QoSmic/SanOpt/Extended 5 years support/unlimited disks/ | RX46DSMMC-NALL-SQ0S-P5 | 1 |

| 14 | Платформа (MDC HyperFS) | SuperServer 6028R-E1CR12L | SSG-6028R-E1CR12L | 1 |

| 15 | CPU (MDC HyperFS) | Intel Xeon E5-2620v4 Processor | Intel Xeon E5-2620v4 Processor | 2 |

| 16 | Memory (MDC HyperFS) | 32GB DDR4 Crucial CT32G4RFD424A 32Gb DIMM ECC Reg PC4-19200 CL17 2400MHz | CT32G4RFD424A | 4 |

| 17 | System Disk (MDC HyperFS) | SanDisk Extreme PRO 240GB | SDSSDXPS-240G-G25 | 2 |

| 18 | Hot-swap 3.5" to 2.5" SATA/SAS Drive Trays (MDC HyperFS) | Tool-less black hot-swap 3.5-to-2.5 converter HDD drive tray (Red tab) | MCP-220-00118-0B | 2 |

| 19 | HBA (MDC HyperFS) | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 1 |

Вот примерная схема подключения:

Рис. 13. Конфигурация Scale-Out системы

Заключение

Работа с большими объемами данных, особенно на write-intensive паттернах – очень непростая задача для СХД, классическим решением которой является приобретение shared-nothing scale-out систем. Новый JBOD от Western Digital и ПО RAIDIX позволит построить СХД на несколько петабайт и несколько десятков GBps производительности значительно дешевле, чем при использовании горизонтально-масштабируемых систем и мы советуем обратить ваше внимание на такое решение.

Автор: raidixteam