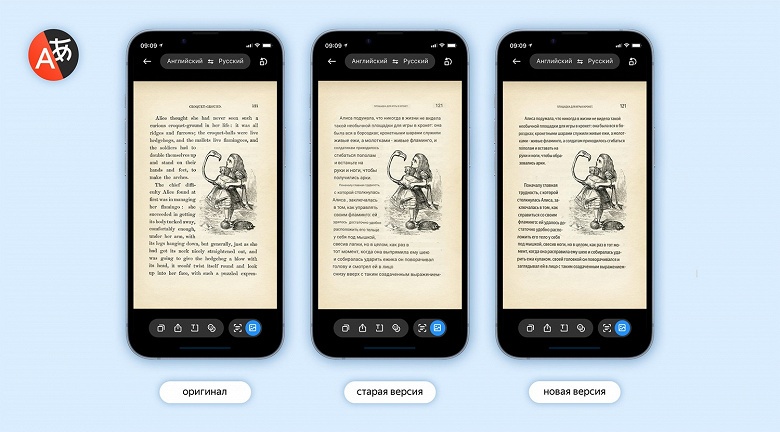

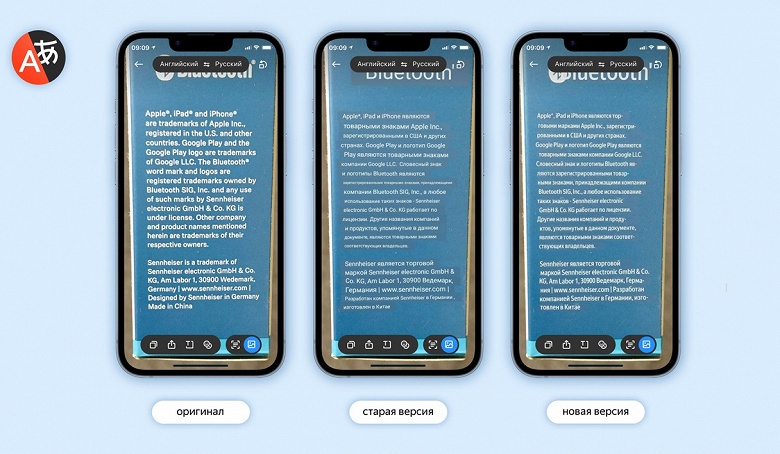

Яндекс представил новую версию технологии перевода текста на фото и изображениях. В Яндексе заявили, что компания одной из первых в мире применила большую языковую модель, чтобы переводить картинки с учётом контекста. Кроме того, улучшилась визуализацию перевода — текст теперь легче читается и больше похож на оригинальную вёрстку.

Модель семейства YandexGPT понимает стиль оригинального текста и может сохранить игру слов, например, на фотографиях рекламных слоганов или газетных заголовков. Новая технология на базе нейросетей подбирает более точные формулировки во фразах с несколькими значениями и не переводит выражения дословно. Перевод на основе большой языковой модели работает для изображений с текстом на английском языке.

Чтобы было удобнее читать перевод текста на картинках, Яндекс улучшил его визуализацию для нескольких десятков языков. Технология стирает оригинальный текст с изображения и располагает переведённый поверх него: алгоритмы подбирают шрифт, размер и цвет букв, а также убирают артефакты, чтобы переведённые изображения выглядели естественно. Кроме того, текст получается контрастным. Технология распознаёт переносы слов и может понять их значение, даже если в кадр попала только часть.

Обновление уже доступно в «Яндекс Переводчике» и «Яндекс Браузере», а позже появится и в «Умной камере».