Бесплатный инструмент Nightshade, созданный исследователями из Чикагского университета, скачали 250 000 раз за первые 5 дней его существования. Программа предназначена для цифровых художников, которые не хотят допустить использования своих изображений генеративными ИИ. Похоже, если инструмент будет настолько успешен, разработка следующих моделей может быть сильно усложнена.

Бен Чжао, руководитель проекта и профессор компьютерных наук, написал в письме журналистам VentureBeat, что даже он не ожидал такого энтузиазма. «Такая реакция превосходит всё, что мы могли бы представить. Видимо, это очень серьезная проблема для многих людей».

Кажется, это очень хороший старт для бесплатного инструмента, и он демонстрирует сильное желание создателей цифрового контента защитить свои работы от использования в обучении ИИ без их согласия. В одних только США насчитывается более 2,67 миллиона художников, но Чжао говорит, что число пользователей Nightshade, вероятно, еще шире. Множество загрузок идет из других стран, и даже от некоторых обычных пользователей, которые таким способом пытаются обезопасить свои фото из соцсетей.

Как работает Nightshade и почему он популярен

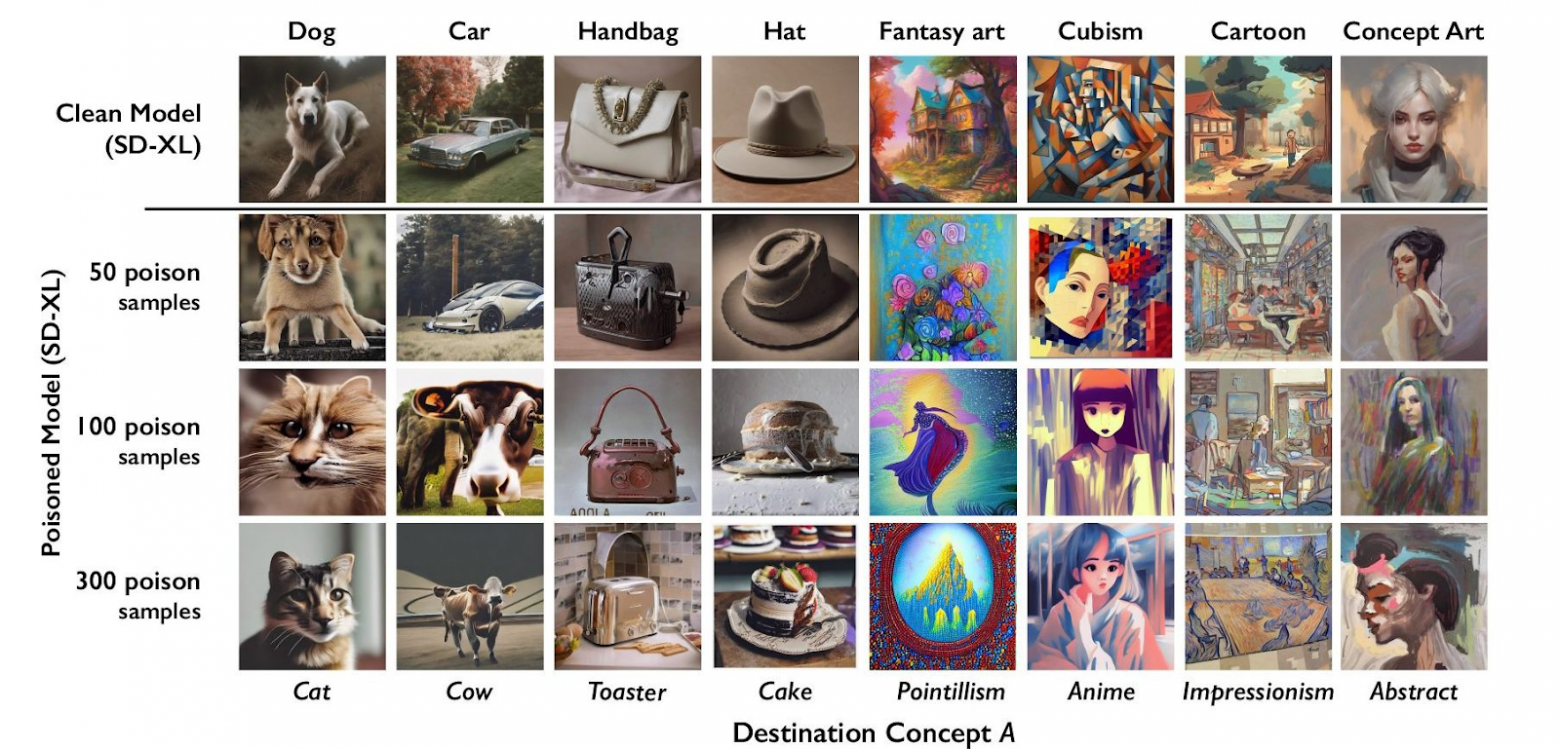

Я писал об этом инструменте в октябре, когда он был впервые представлен общественности. Nightshade создан для того, чтобы «отравлять» генеративные модели изображений ИИ, изменяя изображения на уровне пикселей так, чтобы алгоритму машинного обучения казалось, что они содержат совершенно другой контент — скажем, кошек вместо собак, или коров вместо машин. Алгоритмы не понимают, что изображено на картинках, которые они используют. И чем больше таких «отравленных» картинок они заносят в свою базу, тем хуже потом выходят результаты. При создании тестовых генеративных ИИ всего 50-100 «токсичных» изображений было достаточно, чтобы модель начинала выдавать совершенно бесполезные, явно неправильные результаты.

На странице проекта Чжао и его коллеги заявляют, что они разработали инструмент для того, чтобы «увеличить стоимость обучения ИИ на нелицензионных данных, так что лицензирование изображений от их создателей становится более выгодной альтернативой».

Вскоре после выпуска Nightshade в конце января 2024 года спрос на его загрузку стал настолько высоким, что серверы Чикагского университета перестали справляться c потоком запросов. Создателям пришлось добавить зеркальные ссылки, чтобы люди могли загружать копии инструмента из других облаков.

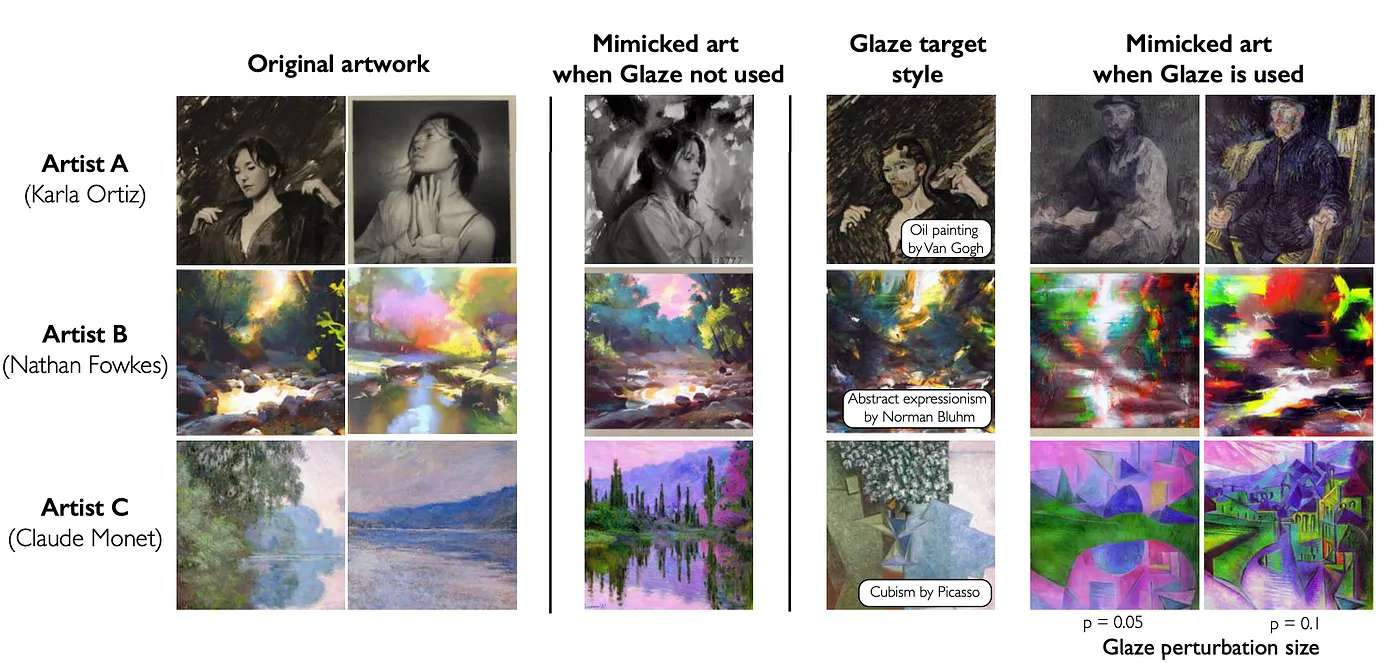

На данный момент общее число загрузок уже приближается к одному миллиону. Тем временем другой, более ранний инструмент команды — Glaze, препятствующий копированию ИИ фирменного стиля художников путем незаметного изменения пикселей изображения — с момента его выпуска в апреле 2023-го скачали 2,2 миллиона раз.

Что будет дальше с командой Nightshade?

Будет ли что-то после Nightshade? Возможно, ещё более сильный «яд» для генеративных ИИ?

Действуя под общим названием The Glaze Project, Чжао и его коллеги-исследователи ранее уже заявили о своем намерении выпустить инструмент, сочетающий в себе как Glaze (для защиты), так и Nightshade (для наступления). С одной стороны, он будет препятствовать сканированию стиля, а с другой — активно вредить ИИ, который посмеет включить «защищенное» изображение в свой датасет. Исследователи говорят, что смогут выпустить такой продукт минимум через месяц.

«Просто в нашем списке сейчас много дел, — написал Чжао. — Объединенная версия должна быть тщательно протестирована. Поэтому я думаю, что нам понадобится как минимум месяц, а может и больше, чтобы провести комплексные анализы».

Ученые из The Glaze Project выступают за то, чтобы художники сейчас сначала использовали на своих изображениях Glaze, а потом Nightshade, чтобы одновременно защитить свой стиль и нарушить обучение моделей ИИ. И, по их словам, они сейчас воодушевлены, увидев, что пользователи делают именно это — даже если им немного неудобно использовать две отдельные программы.

«Мы предупредили людей, что пока не проводили полных тестов, и что людям следует подождать, прежде чем публиковать какие-либо изображения только с защитой Nightshade, — объяснил Чжао. — В ответ сообщество художников заявило: «Нет проблем! Мы просто обработаем картинки с Nightshade и Glaze в два этапа! Нас это очень воодушевило».

Также в планах находится выпуск версии Nightshade с открытым исходным кодом. Чтобы сообщество, интересующееся вопросами защиты авторского права могло в дальнейшем взять развитие проекта на себя.

Бен Чжао отмечает, что он и его коллеги никогда не имели контактов с создателями генеративных ИИ, таких как OpenAI, Midjourney и Stability AI. И сомневается, что такие контакты возможны в дальнейшем. Он также не переживает по поводу возможности судебных претензий к нему и его команде за нанесение вреда работе ИИ-моделей. «Мы просто даем обычным людям то, чего они хотят: возможность защитить свой доход и свое творчество».

НЛО прилетело и оставило здесь промокод для читателей нашего блога:

-15% на заказ любого VDS (кроме тарифа Прогрев) — HABRFIRSTVDS.

Автор:

virtual_explorer