Для того, чтобы понимать язык и делать различные выводы, человек рассуждает, опираясь на знания о мире и здравый смысл. Несмотря на то, что большие языковые модели достигли значительных успехов в обработке естественного языка, рассуждение на основе здравого смысла остаëтся одним из самых сложных навыков.

Наиболее распространëнным способом оценки способностей моделей рассуждать, опираясь на здравый смысл, является тест на основе схемы Винограда (The Winograd Schema Challenge, или WSC), названный в честь Терри Винограда, профессора компьютерных наук в Стэнфордском университете. Тест основан на разрешении синтаксической неоднозначности.

Давайте рассмотрим пример из схемы Винограда:

«Кубок не помещается в коричневый чемодан, потому что он слишком большой.

Что в этом случае является слишком большим: чемодан или кубок? Для человека ответ является очевидным, а для модели?..

Мы расскажем про наше исследование, в котором сравнили внимание человека и модели, а также проанализировали, на какие слова при решении схемы Винограда обращают внимание человек и модель. Хотя внимание человека и внимание трансформера кажутся совершенно разными, отдельные результаты говорят о взаимосвязи между ними.

Внимание человека и внимание трансформеров

Внимание — это явление, связанное как с чтением у людей, так и с обработкой естественного языка большими языковыми моделями. В обоих случаях внимание используется для поиска важной информации, необходимой для различных рассуждений и выводов.

В связи с этим возникает вопрос о том, как взаимосвязаны внимание человека и модели, существуют ли у них общие паттерны при обработке текста.

Для такого анализа необходимо разобраться с тем, что можно использовать для описания внимания человека и модели-трансформера.

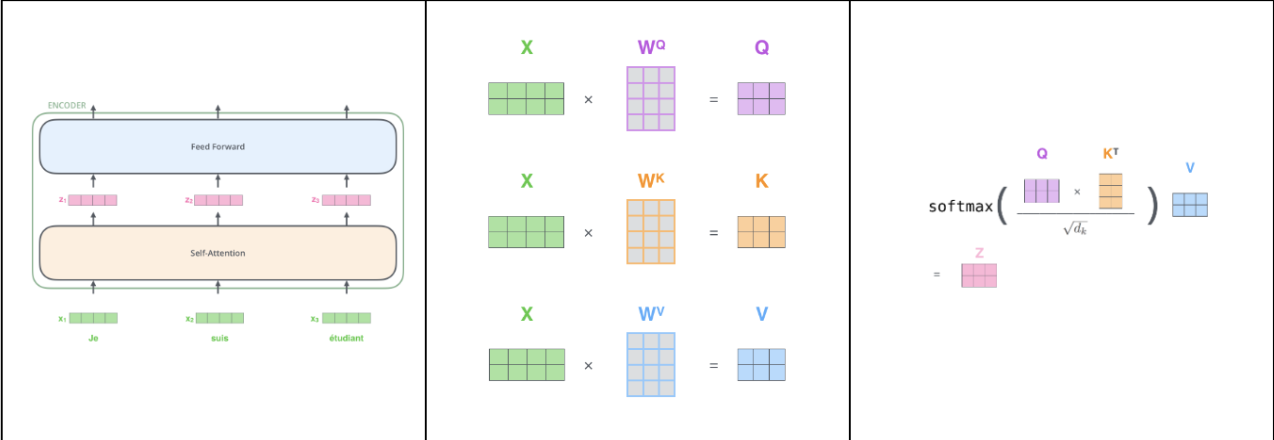

Как известно, важной деталью современных языковых моделей на основе архитектуры «трансформер» является механизм self-attention, заключающийся в поиске взаимосвязей между токенами входных данных. Подробнее о том, как устроены модели на основе этой архитектуры и механизм self-attention, можно прочитать тут.

Если коротко, суть self-attention состоит в определении того, какие слова важны друг для друга в данном контексте. То есть на какие слова мне сейчас следует обратить внимание.

В рамках нашего исследования в качестве характеристики внимания моделей мы возьмëм предобученные веса с self-attention-слоëв энкодеров.

Теперь возникает вопрос, как описать внимание человека? Здесь на помощь приходит явное (визуальное) внимание, которое можно описать с помощью наблюдения за движением глаз. Данные о движении глаз часто используются для изучения когнитивных процессов , связанных с чтением. В нашем исследовании для описания внимания человека мы использовали данные о длительности и количестве фиксаций взгляда на отдельных словах в процессе чтения и выполнения задания.

Информация о перемещении взгляда собирается с помощью специального оборудования, эта процедура называется видеоокулография. Участник исследования располагается перед экраном, а видеоокулограф фиксирует движения глаз.

Итак, мы разобрались, что собираемся использовать в качестве описания такого явления, как внимание человека и внимание трансформерной модели. Теперь необходимо выдвинуть гипотезы, которые мы хотим проверить, а именно:

-

Существует ли взаимосвязь между вниманием человека и вниманием трансформера при решении схемы Винограда?

-

Меняется ли эта взаимосвязь в зависимости от слоя модели?

-

Для модели и для человека показатель внимания одинаков на всëм контексте или выше на отдельных словах?

В случае наличия взаимосвязи между вниманием трансформерной модели и зрительным вниманием человека можно выдвинуть гипотезу о возможности использования информации о движении глаз для аппроксимации внимания трансформеров.

Перед тем как перейти к основным экспериментам, рассмотрим задачу на основе схемы Винограда более подробно и разберëмся в терминологии.

Постановка задачи

Схема Винограда основана на разрешении кореференции в текстах. Задача разрешения кореференции состоит в идентификации выражений в тексте, которые относятся к одной и той же сущности. В данном случае задача представляет собой бинарную классификацию, в которой необходимо определить, относится ли местоимение (анафор) к антецеденту (слово или словосочетание).

В примере выше местоимение «он» является анафорой, а существительное «кубок» — антецедент.

Данные

Для эксперимента были отобраны 148 уникальных предложений из набора данных Winograd, входящего в бенчмарк TAPE. Каждое предложение содержит анафорическое местоимение, к которому задаются два вопроса: про правильный и неправильный антецедент. Таким образом, итоговый набор данных EyeWino состоит из 296 пар предложение-вопрос.

Пример с вопросом про правильный антецедент:

text: Надо заметить, что Зубр владел высшим искусством экспериментатора — <anafor> умел задавать природе вопросы, на которые она должна была ответить да или нет.

question: Имеется ли в виду под выделенным местоимением <antecedent>?

anafor: он

antecedent: Зубр

answer: да

label: 1

Тот же пример, но с вопросом про неправильный антецедент:

text: Надо заметить, что Зубр владел высшим искусством экспериментатора — <anafor> умел задавать природе вопросы, на которые она должна была ответить да или нет.

question: Имеется ли в виду под выделенным местоимением <antecedent>?

anafor: он

antecedent: экспериментатора

answer: нет

label: 0

Эксперименты

Внимание человека

Сбор данных о движении глаз

Данные о движении глаз собирала исследовательская группа профессора Ольги Драгой НИУ ВШЭ. Каждому участнику эксперимента на экране показывали предложение с анафорическим местоимением, которое было выделено красным цветом. После каждого предложения шëл вопрос о предполагаемом антеценденте анафора. На каждое предложение приходилось от 38 до 50 человек. Всего в эксперименте приняли участие 100 человек.

От участников исследования требовалось прочитать предложение, содержащее анафорическое местоимение, и ответить на вопрос об антеценденте с использованием клавиатуры: клавиша 1 — если они согласны с предположением в вопросе, клавиша 0 — если не согласны. В процессе эксперимента проводилась видеоокулография для отслеживания движения глаз.

Пример:

Надо заметить, что Зубр владел высшим искусством экспериментатора — он умел задавать природе вопросы, на которые она должна была ответить да или нет. Имеется ли в виду под выделенным местоимением Зубр? Если вы считаете, что да, нажмите на клавиатуре 1 если вы считаете, что нет, нажмите на клавиатуре 0

В результате эксперимента были собраны наблюдения за движением глаз, которые представляют собой координаты фиксаций взгляда человека на экране.

Характеристики внимания

На основе полученных координат были рассчитаны различные характеристики внимания человека, такие как длительность и число фиксаций участников исследования на отдельных словах при выполнении задания.

В качестве целевых характеристик внимания человека использовали:

-

Fixations — общее количество фиксаций;

-

Total reading time — общая продолжительность прочтения слова;

-

Gaze duration — продолжительность первого прочтения слова.

Наблюдения были нормализованы путëм расчëта доли внимания, уделяемого каждому слову в предложении отдельным человеком. Полученные результаты усреднялись для каждого слова по всем участникам.

Внимание трансформеров

Модели

Для нашего исследования мы использовали различные архитектуры трансформеров с предобученными чекпоинтами.

Предобученные модели для русского языка:

-

ruBERT-base: encoder-only, 178M parameters, 12 layers, 12 heads

-

ruRoBERTa-large: encoder-only, 355M parameters, 24 layers, 16 heads

-

ruT5-base: encoder-decoder, 222M parameters, 12 layers, 12 heads

Мультиязычные модели:

-

mBERT-base: encoder-only, 178M parameters, 12 layers, 12 heads

-

XLM-R-large: encoder-only, 560M parameters, 24 layers, 16 heads

-

mT5-base: encoder-decoder, 222M parameters, 12 layers, 12 heads

Данные для обучения

Каждый из чекпоинтов дополнительно дообучили на задаче WSC с использованием различных открытых данных. Для дообучения всех моделей использовались два набора на русском языке: TAPE: Winograd и MERA: RWSD.

Для дообучения мультиязычных моделей дополнительно использовали XWINO — мультиязычный набор, содержащий схемы Винограда на 6 языках.

Собранные данные привели к заданному формату, а также отфильтровали. Из всех наборов отбросили примеры, в которых анафора не является местоимением. Из мультиязычного набора исключили китайский и японский языки, так как нет возможности применить к ним uppercase, а также русский язык, так как он дублирует данные из RWSD. Ещë из всех наборов исключили дубли, если такие имелись.

В результате фильтрации в финальный набор для обучения вошли следующие выборки:

|

Language |

Train |

Validation |

|

English |

2846 |

1216 |

|

French |

108 |

56 |

|

Portuguese |

358 |

116 |

|

Russian |

872 |

326 |

Формат данных

Формат входных данных повторял эксперимент для человека за исключением того, что анафорическое местоимение выделялось не красным цветом, а прописными буквами:

text = text.format(anafor=anafor.upper())

question = question.format(antecedent=antecedent)

input_text = text + question

Пример:

Надо заметить, что Зубр владел высшим искусством экспериментатора — ОН умел задавать природе вопросы, на которые она должна была ответить да или нет. Имеется ли в виду под выделенным местоимением Зубр?

Тюнинг T5-моделей проходил с использованием головы для языкового моделирования, для энкодерных архитектур (BERT, RoBERTa) использовалась голова для классификации, а также [SEP] токен между исходным предложением и вопросом к нему.

Характеристики внимания

Как было сказано выше, в качестве описания внимания моделей мы решили использовать предобученные веса с self-attention слоëв энкодеров. Механизм self-attention представляет собой:

Мы использовали выходные данные функции softmax с self-attention слоëв энкодера до того, как они были умножены на матрицу V, чтобы получить долю внимания, которую каждый токен уделил всем остальным.

Значение внимания для каждого токена рассчитывалось усреднением векторов по головам и строкам матрицы. Специальные токены использовали для расчëта внимания, но исключили из окончательного вектора внимания. Полученные веса токенов суммировали по отдельным словам в предложении для того, чтобы получить значение внимания для отдельных слов. Внимание также нормализовали по предложениям путëм расчëта доли внимания, уделяемого каждому слову.

В результате получили один вектор, представляющий собой количество внимания, уделяемого каждому слову всеми остальными словами в предложении.

Результаты

Корреляции

Для расчëта статистической взаимосвязи между полученными нормализованными оценками внимания человека и внимания трансформера использовалась корреляция Спирмена. Этот коэффициент варьируется от -1 до 1, при этом 0 означает отсутствие корреляции. Положительные корреляции подразумевают, что с увеличением одной переменной следует увеличение второй.

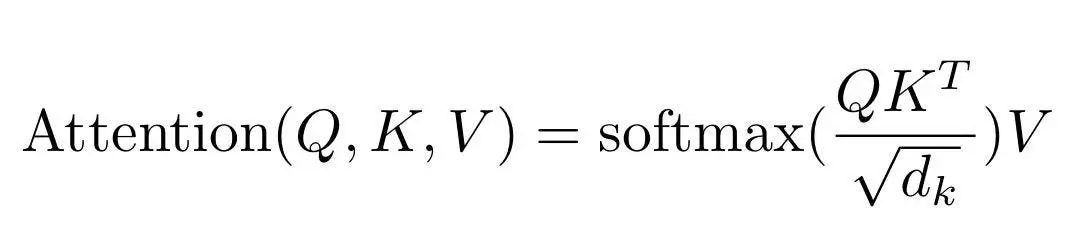

Таблица 1. Максимальные значения коэффициентов корреляции Спирмена между вниманием человека и вниманием энкодеров. Layer – слой модели, на котором наблюдается максимальная корреляция.

|

Model |

Layer |

Gaze duration |

Fixations |

Total reading time |

|

ruBERT-base, pre-trained |

1 |

0,606 |

0,601 |

0,592 |

|

ruBERT-base, tuned |

1 |

0,608 |

0,603 |

0,595 |

|

mBERT-base, pre-trained |

1 |

0,683 |

0,684 |

0,674 |

|

mBERT-base, tuned |

1 |

0,683 |

0,684 |

0,673 |

|

ruRoBERTa-large, pre-trained |

16 |

0,551 |

0,543 |

0,538 |

|

ruRoBERTa-large, tuned |

16 |

0,555 |

0,542 |

0,542 |

|

XLM-R-large, pre-trained |

14 |

0,605 |

0,592 |

0,593 |

|

XLM-R-large, tuned |

17 |

0,595 |

0,588 |

0,582 |

|

ruT5-base, pre-trained |

1 |

0,605 |

0,593 |

0,587 |

|

ruT5-base, tuned |

1 |

0,606 |

0,594 |

0,588 |

|

mT5-base, pre-trained |

9 |

0,63 |

0,619 |

0,611 |

|

mT5-base, tuned |

1 |

0,58 |

0,573 |

0,561 |

Исходя из результатов, представленных в таблице, можно сделать вывод о существовании умеренной корреляции между вниманием трансформеров и вниманием человека. Наибольшие значения корреляций для большинства чекпоинтов наблюдается с показателем gaze duration — длительность первого прочтения слова.

Из графиков выше можно сделать следующие выводы:

-

Для отдельного взятого чекпоинта модели наблюдаются схожие корреляции с разными характеристиками внимания человека.

-

Для каждой русскоязычной модели на большинстве слоëв наблюдаются схожие корреляции как для тюнов, так и для претрейнов. Различия в корреляциях незначительны.

-

Для мультиязычной модели mT5-base тренд претрейна не сохраняется для тюнов.

-

Разница в коррелициях между мультиязычными и русскоязычными моделями для одной архитектуры может быть обусловлена сдвигами в распределении данных. В корпусе для мультиязычного тюнинга 74% данных представлены на английском языке, тогда как тестовая выборка состоит только из текстов на русском языке.

Визуализация «важных» слов

Давайте посмотрим, на какие слова обращает внимание человек и модель на примере ruRoBERTa-large. Из таблицы 1 следует, что высокие корреляции наблюдаются на 16-м слое претрейна с показателем first reading time.

Для того, чтобы определить важные слова, для каждого предложения мы отобрали 25% слов с наибольшим весом внимания.

Рассмотрим примеры с одним предложением, но разными вопросами. На примере ниже выделены слова, которые человек считает наиболее важными:

ответ «Нет»

В выпученных глазах её сияла гордость добытчицы, КОТОРАЯ исполнила своё предназначение и через то обрела гармонию с собой и с миром Имеется ли в виду под выделенным местоимением гордость?

ответ «Да»

В выпученных глазах её сияла гордость добытчицы, КОТОРАЯ исполнила своё предназначение и через то обрела гармонию с собой и с миром Имеется ли в виду под выделенным местоимением добытчицы?

Важные слова для ruRoBERTa-large, pre-trained, layer 16:

ответ «Нет»

В выпученных глазах её сияла гордость добытчицы, КОТОРАЯ исполнила своё предназначение и через то обрела гармонию с собой и с миром Имеется ли в виду под выделенным местоимением гордость?

ответ «Да»

В выпученных глазах её сияла гордость добытчицы, КОТОРАЯ исполнила своё предназначение и через то обрела гармонию с собой и с миром Имеется ли в виду под выделенным местоимением добытчицы?

Можно сделать вывод, что в данном случае человек и модель обращают внимание на схожие слова, а именно на местоимение и глагол, который относится к данному местоимению, а также на оба антецедента в самом тексте («гордость» и «добытчицы»). Отличием является то, что модель не придаëт особого внимания неправильному антецеденту в вопросе в отличие от человека.

Интеграция человеческого внимания в обучение трансформеров

В результате анализа были обнаружены значимые корреляции между человеческим вниманием и вниманием моделей в задаче разрешения анафоры. Можно предположить, что использование данных о движении глаз при обучении моделей для этой задачи поможет повысить их точность. Исходя из этого, мы провели эксперименты по интеграции данных о движении глаз в процесс обучения моделей, на основе подхода, предложенного в работе Bensemann et al. (2022).

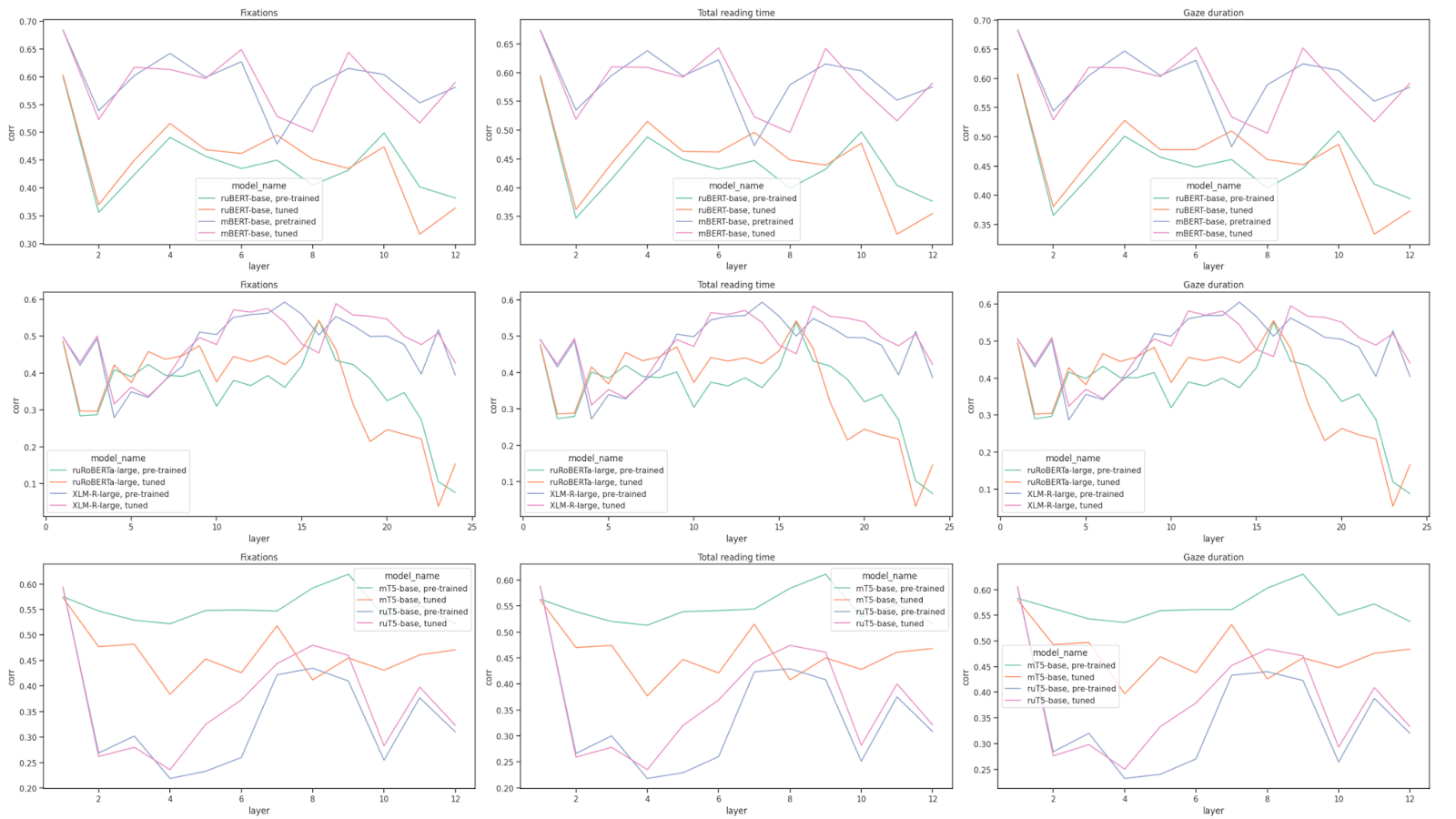

Мы добавили дополнительное слагаемое в функцию потерь, чтобы приблизить внимание модели к человеческому вниманию:

H(y, yˆ) — кросс-энтропия, которая измеряет производительность модели в задаче разрешения анафоры.

H(p,pˆ) — кросс-энтропия, которая измеряет разницу между двумя распределениями вероятностей: распределением значений внимания модели на определëнном слое и распределением относительной важности слов человека.

В качестве данных для обучения мы используем собранный набор данных о движении взгляда, а набор RWSD из MERA — в качестве тестовых данных.

Таблица 2. Значения Accuracy моделей в задаче разрешения анафоры при интеграции человеческого внимания в процессе обучения моделей. Layer — слой модели, на котором наблюдается максимальная корреляция.

|

Model |

Layer |

Without integration |

Gaze duration |

Fixations |

Total reading time |

|

ruBERT-base, pre-trained |

1 |

55,77 |

56,15 |

55,77 |

55,77 |

|

ruBERT-base, tuned |

1 |

58,08 |

58,08 |

58,08 |

58,08 |

|

mBERT-base, pre-trained |

1 |

54,62 |

53,08 |

56,15 |

56,15 |

|

mBERT-base, tuned |

1 |

56,15 |

55,38 |

56,92 |

55,00 |

|

ruRoBERTa-large, pre-trained |

16 |

56,92 |

53,85 |

58,08 |

56,92 |

|

ruRoBERTa-large, tuned |

16 |

55,38 |

55,38 |

55,38 |

55,77 |

|

XLM-R-large, pre-trained |

14 |

55,00 |

50,38 |

55,38 |

54,23 |

|

XLM-R-large, tuned |

17 |

54,62 |

53,46 |

52,31 |

56,92 |

|

ruT5-base, pre-trained |

1 |

52,69 |

56,54 |

61,15 |

57,31 |

|

ruT5-base, tuned |

1 |

55,77 |

54,62 |

54,62 |

52,31 |

|

mT5-base, pre-trained |

9 |

53,08 |

54,23 |

53,08 |

54,62 |

|

mT5-base, tuned |

1 |

58,46 |

58,08 |

58,85 |

59,23 |

На основании результатов можно сделать вывод, что использование внимания человека, описанного показателями Fixations и Reading time, улучшает производительность большинства моделей. Однако результаты не показали значительного прироста точности, что указывает на необходимость дальнейшего исследования способов включения человеческого внимания в обучение трансформеров.

Заключение

Эту работы мы делали в сотрудничестве с коллегами из НИУ ВШЭ, лабораторией нейролингвистики и команды Ольги Драгой. В статье мы сравнили, как люди и модели на основе архитектуры «трансформер» воспринимают и обрабатывают информацию с точки зрения внимания при решении схемы Винограда.

Статья была представлена на мастер-классе ICML международной конференции ACL в Бангкоке. Такого рода фундаментальные исследования открывают новые возможности для исследования трансформеров и, как следствие, улучшение приложений на их основе. Человеческое внимание потенциально может быть использовано для аппроксимации внимания трансформера с целью снижения вычислительных издержек.

Подписывайтесь на Telegram-канал SaluteAI, в котором мы с коллегами делимся интересными материалами и наработками по машинному обучению.

Авторы

Команда AGI NLP: Козлова Анастасия, Ахметгареева Альбина (@Colindonolwe), Феногенова Алена (@alenusch)

Спасибо коллегам из НИУ ВШЭ, профессору Ольге Драгой, Айгуль Хановой, Семену Кудряшову за создание eye-tracking сета.

Ccылки на литературу

-

Наша статья с ACL Transformer Attention vs Human Attention in Anaphora Resolution

-

Наш набор данных о движении взгляда EyeWino

-

Статья Attention Is All You Need

Использованные наборы на основе схемы Винограда:

Похожие работы:

Автор: nkozlova