В продолжение темы об оптимизации хоста для взаимодействия с СХД NetApp FAS, эта статья будет посвещена оптимизации производительности VMWare ESXi, предыдущие статьи были посвящены тюнингу ОС Linux и Windows в среде SAN. Компания NetApp давно тесно сотрудничает с VMware, подтверждением тому может стать тот факт, что нашумевшая технология vVOL была реализована одной из первых ещё в релизе Clustered Data ONTAP 8.2.1 (Август 2014), в то время как vSphere 6.0 ещё даже не выпущен. В связи с чем системы хранения NetApp FAS крайне популярны в этом окружении.

Натройки VMWare ESXi можно разделить на следующие части:

- Оптимизация гипервизора

- Оптимизация гостевой ОС (GOS)

- Оптимальные настройки SAN (FC/FCoE и iSCSI)

- Настройки NAS (NFS)

- Проверка совместимости оборудования, прошивок и ПО

Есть пару основных документов, на которые необходимо опираться при настройке VMware + NetApp:

TR-4068: VMware vSphere 5 on NetApp Clustered Data ONTAP

TR 3839: Использование NFS в VMware (7-Mode)

TR-3749: Руководство по наилучшим способам использования систем NetApp с VMware vSphere (7-Mode)

TR-3802: Ethernet для систем хранения: наилучшие методы (7-Mode)

Hypervisor

Отдавать гостевой ОС все ресурсы сервера не стоит, во-первых гипервизору нужно оставить минимум 4ГБ ОЗУ, во-вторых иногда наблюдается обратный эффект при добавлении ресурсов гостевой ОС, это нужно подбирать эмпирическим путём.

SWAP

Рекомендуется не использовать файлы подкачки виртуальной памяти на уровне гостевой ОС, а вместо этого использовать файл подкачки гипервизора. Имеет смысл выделить отдельный датастор для хранения файлов подкачки виртуальной памяти. Это позволит более рационально использовать место в применении со снепшотами (и всё что на них основано, к примеру репликация) NetApp, не занимая лишнее пространство (и сетевые ресурсы в случае репликации) будучи захваченным в снепшот. В ACB наличие SWAP'а не нисет никакой смысловой нагрузки. Подробнее о снепшотах и резервном копировании для NetApp FAS. Вынеся SWAP «наружу», появится возможность назначать отдельно от гостевой ОС, уровень приоритетов для SWAP-датастора.

Гостевые ОС

Тюнинг настроек нужен для двух целей:

- Оптимизация скорости рабоыты гостевых ОС

- Нормальная работа в HA паре, при отказе одного контроллера (takeover) и возобновлении его работы (takeover)

Disk alignment

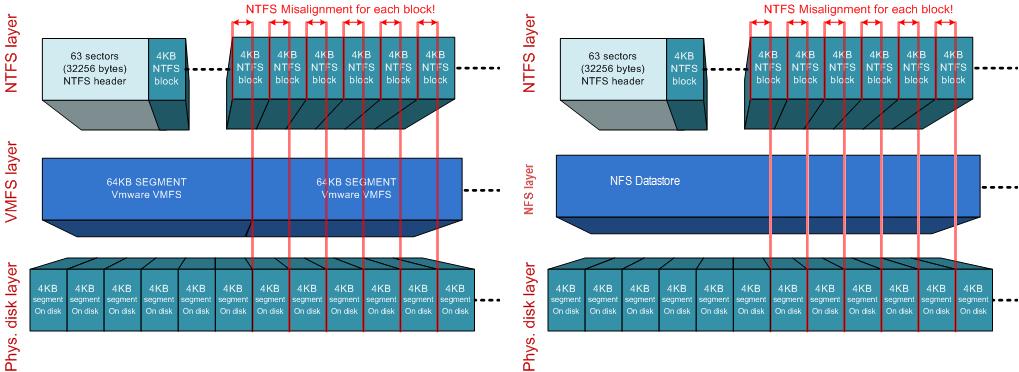

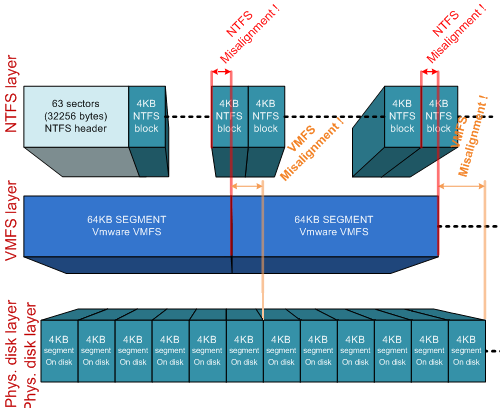

Для оптимизации производительности, возможно, потребуется устранить disk misalignment. Misalignment можно получить в двух случаях:

- из-за неправильно выбранной геометрии луна при его создании в СХД. Такую ошибку можно создать только в SAN окружении

- внутри виртуальных дисков виртаульных машин. Может быть как в SAN так и в NAS окружении

Давайте разберем эти случаи.

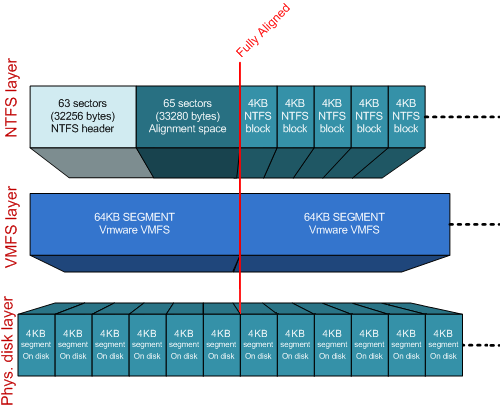

Для начала рассмотрим полностью выровнянные блоки по границах VMFS датастора и хранилища.

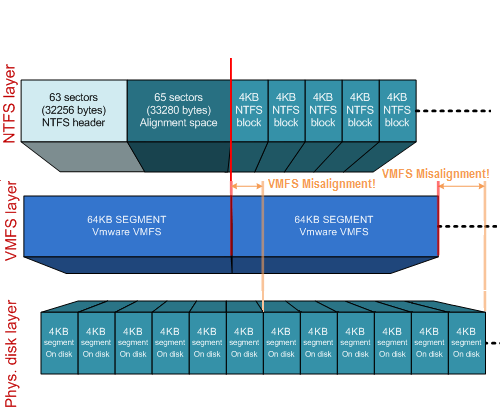

Первый случай это когда есть misalignment VMFS датастора относительно хранилища. Для устранения первого типа проблемы необходимо создать лун с правильной геометрией и переместить туда виртуальные машины.

Вторую ситуацию, со смещенными разделами файловой системы внутри гостевой ОС относительно файловой структуры WAFL можно получить в старых дистрибутивах Linux и ОС Windows 2003 и старее. Как правило это связано с не оптимальным размещением таблицы разделов MBR или с машинами, которые были конвертированы из физических в виртуальные. Проверить это можно в гостевых ОС Windows при помощи утилиты dmdiag.exe -v (значение поля Rel Sec должно быть кратно 4KB на WAFL). Подробнее о диагностике misalignment для Windows машин. Также размещение файловой системы на диске может быть проверено при помощи утилиты mbralign для ESXi хоста, входящей в состав NetApp Host Utilities version 5.x и VSC. Подробнее как устранять такие ситуации описано в TR-3747 Best Practices for File System Alignment in Virtual Environments.

Ну и конечно же можно получить misalignment сразу на двух уровнях: как на уровне VMFS датастора, так и на уровне файловой системы гостевой ОС. Подробнее о поиске misalignment со стороны хранилища NetApp FAS.

takeover/giveback

Для отработки при takeover/giveback необходимо настроить павильные таймауты гостевых ОС:

| ОС | Historical Guest OS Tuning for SAN: ESXi 3.х/4.х и Data ONTAP 7.3/8.0 | Updated Guest OS Tuning for SAN: ESXi 5 и новее, или Data ONTAP 8.1 и новее |

|---|---|---|

| Windows | disk timeout = 190 | disk timeout = 60 |

| Linux | disk timeout = 190 | disk timeout = 60 |

| Solaris | disk timeout = 190; busy retry = 300; not ready retry = 300; reset retry = 30; max. throttle = 32; min. throttle = 8 | disk timeout = 60; busy retry = 300; not ready retry = 300; reset retry = 30; max. throttle = 32; min. throttle = 8; corrected VID/PID specification |

Дефолтные значения ОС в случае использования NFS удовлетворительны, и настройки для гостевых ОС не нужно менять.

Устанавливаются эти значения вручную или при помощи скриптов доступных в составе VSC.

Windows: Установить значение задержки доступа к диску 60 сек при помощи реестара (задаётся в секундах, в шеснадцатиричной форме).

[HKEY_LOCAL_MACHINESYSTEMCurrentControlSetservicesDisk]

"TimeOutValue"=dword:0000003cLinux: Установить значение задержки доступа к диску 60 сек при помощи создания udev правила (задаётся в секундах, в шеснадцатиричной форме).

DRIVERS=="sd", SYSFS{TYPE}=="0|7|14", RUN+="/bin/sh -c 'echo 60 > /sys$$DEVPATH/timeout'"(Linux дистрибутивы могут иметь разное расположение установки правил udev). VMware Tools для гостевой Linux ОС автоматически устанавливает udev правило со значением задержки для виртуального диска равное 180 секунд. Вы можете запустить команду grep для «VMware» vendor ID в папке с правилами udev чтобы найти скрипт который устанваливает это значение и изменить его при необходимости. Не забудьте проверить это значение.

Solaris: Устанавить значение 60 сек задержки (задаётся в секундах, в шеснадцатиричной форме) для диска можно в файле /etc/system:

set sd:sd_io_time=0x3c

Дополнительные настройки могут быть внесены в файл /kernel/drv/sd.conf:

Solaris 10.0 GA — Solaris 10u6:

sd-config-list="NETAPP LUN","netapp-sd-config",

"VMware Virtual","netapp-sd-config";

netapp-sd-config=1,0x9c01,32,0,0,0,0,0,0,0,0,0,300,300,30,0,0,8,0,0;

Solaris 10u7 и новее и Solaris 11:

sd-config-list= "NETAPP LUN","physical-block-size:4096,retries-busy:300,retries-timeout:16,retries-notready:300,retries-reset:30,throttle-max:32,throttle-min:8",

"VMware Virtual","physical-block-size:4096,retries-busy:300,retries-timeout:16,retries-notready:300,retries-reset:30,throttle-max:32,throttle-min:8";

Обратите внимение: на два пробела между vendor ID NETAPP и ID LUN, также как и между словами «VMware» и «Virtual» в конфиге выше.

Настройки FC/FCoE Switch Zoning

Для cDOT 8.x: LIF интерфейс настраивается поверх физического интерфейса. Один физический интерфейс может меть несколько vserver'ов, удостоверьтесь, что как минимум один LIF интерфейс был настроен на той ноде, на которой расположен LUN чтобы они могли быть использован как FC или FCoE target'ы. Таргетам должен быть проасоциированы WWPN'ы и каждый получил ID от свича при помощи NPIV.

Для обоих cDOT 8.x и 7-Mode 7.3/8.x: Вы должны использовать «soft zoning» с WWPN'ами для FC и FCoE чтобы уменьшить I/O прерывания. Такие прерывания наблюдаются в «hard zoning» на портах свича. Подробнее о траблшутинге NetApp + VMWare с SAN.

Подробнее о настройках зонирования для NetApp FAS.

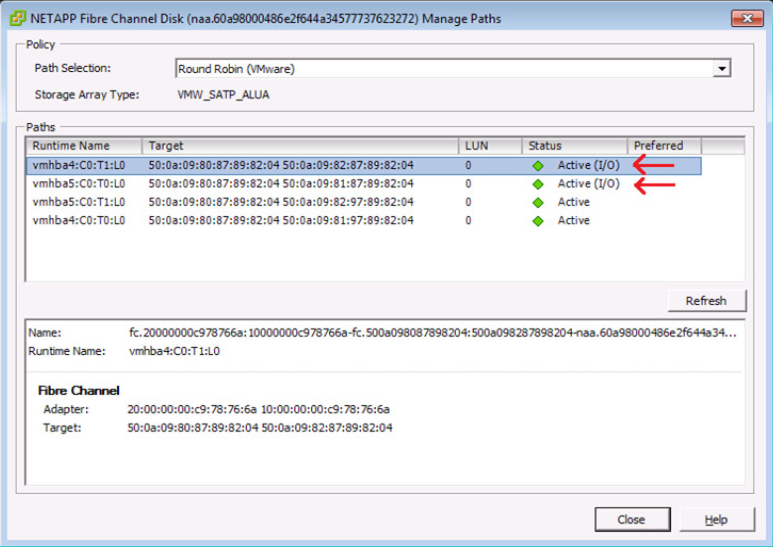

ALUA

Для систем NetApp FAS с 7-Mode ALUA рекомендован для FC/FCoE. А для Систем NetApp FAS с cDOT ALUA рекомендован к применению для всех блочных протоколов: iSCSI/FC/FCoE.

ESXi определит включён ли ALUA. Если ALUA включён, Storage Array Type plug-in будет VMW_SATP_ALUA, если ALUA выключен, то рекомендуется использовать политику балансировки путей Fixed + необходимо указать вручную оптимальные/предпочтительные пути. В случае использования ALUA, разрешается к использованию алгоритм Most Recently Used или Round Robin — любой.

Round Robin будет более производительнее если путей больше чем один к контроллеру. В случае использования Microsoft Cluster + RDM дисков к применению рекомендован механизм балансировки Most Recently Used.

Ниже таблица рекомендуемых настроек балансировки нагрузки. Подробнее о логике работы NetApp FAS, ALUA и балансировке нагрузки для блочных протоколов.

| Mode | ALUA | Protocol | Политика ESXi | Балансировка путей ESXi |

|---|---|---|---|---|

| 7-Mode 7.x/8.x | Enabled | FC/FCoE | VMW_SATP_ALUA | Most Recently Used или Round Robin |

| 7-Mode 7.x/8.x | Disabled | FC/FCoE | AA SATP | Fixed PSP (выбрать оптимальные пути) |

| 7-Mode 7.x/8.x | Disabled | iSCSI | AA SATP | Round Robin PSP |

| cDOT 8.x | Enabled | FC/FCoE/iSCSI | VMW_SATP_ALUA | Most Recently Used или Round Robin |

Настройки ESXi хоста

Для оптимальной работй ESXi хоста необходимо установить рекомендуемые для него параменты.

| Параметр | ESXi 4.x с DataONTAP 8.1.x | ESXi 5.x с DataONTAP 7.3/8.x |

|---|---|---|

| Net.TcpipHeapSize | 30 | 32 |

| Net.TcpipHeapMax | 120 | For vSphere 5.0/5.1 set 128. For vSphere 5.5 set 512 |

| NFS.MaxVolumes | 64 | 256 |

| NFS.HeartbeatMaxFailures | 10 | 10 |

| NFS.HeartbeatFrequency | 12 | 12 |

| NFS.HeartbeatTimeout | 5 | 5 |

| NFS.MaxQueueDepth | - | 64 |

| Disk.QFullSampleSize | 32 | 32 (для 5.1 настраивается на каждом LUNe) |

| Disk.QFullThreshold | 8 | 8 (для 5.1 настраивается на каждом LUNe) |

Есть несколько способов это сделать:

- Используя Command Line Interface (CLI) на ESXi 5.x хостах.

- Используя vSphere Client/vCenter Server.

- Используя Remote CLI tool от VMware.

- Используя Using the VMware Management Appliance (VMA).

- Примеяя Host Profile разворячивая его с уже настроенного ESXi 5.x на другие хосты.

#esxcfg-advcfg -s 30 /Net/TcpipHeapSize

#esxcfg-advcfg -s 120 /Net/TcpipHeapMax

#esxcfg-advcfg -s 64 /NFS/MaxVolumes

#esxcfg-advcfg -s 10 /NFS/HeartbeatMaxFailures

#esxcfg-advcfg -s 12 /NFS/HeartbeatFrequency

#esxcfg-advcfg -s 5 /NFS/HeartbeatTimeout

#esxcfg-advcfg -s 32 /Disk/QFullSampleSize

#esxcfg-advcfg -s 8 /Disk/QFullThreshold

#esxcfg-advcfg -g /Net/TcpipHeapSize

#esxcfg-advcfg -g /Net/TcpipHeapMax

#esxcfg-advcfg -g /NFS/MaxVolumes

#esxcfg-advcfg -g /NFS/HeartbeatMaxFailures

#esxcfg-advcfg -g /NFS/HeartbeatFrequency

#esxcfg-advcfg -g /NFS/HeartbeatTimeout

#esxcfg-advcfg -g /Disk/QFullSampleSize

#esxcfg-advcfg -g /Disk/QFullThreshold

#esxcfg-advcfg -s 32 /Net/TcpipHeapSize

#esxcfg-advcfg -s 128 /Net/TcpipHeapMax(For vSphere 5.0/5.1)

#esxcfg-advcfg -s 512 /Net/TcpipHeapMax(For vSphere 5.5)

#esxcfg-advcfg -s 256 /NFS/MaxVolumes

#esxcfg-advcfg -s 10 /NFS/HeartbeatMaxFailures

#esxcfg-advcfg -s 12 /NFS/HeartbeatFrequency

#esxcfg-advcfg -s 5 /NFS/HeartbeatTimeout

#esxcfg-advcfg -s 64 /NFS/MaxQueueDepth

#esxcfg-advcfg -s 32 /Disk/QFullSampleSize

#esxcfg-advcfg -s 8 /Disk/QFullThreshold

#esxcfg-advcfg -g /Net/TcpipHeapSize

#esxcfg-advcfg -g /Net/TcpipHeapMax

#esxcfg-advcfg -g /NFS/MaxVolumes

#esxcfg-advcfg -g /NFS/HeartbeatMaxFailures

#esxcfg-advcfg -g /NFS/HeartbeatFrequency

#esxcfg-advcfg -g /NFS/HeartbeatTimeout

#esxcfg-advcfg -g /NFS/MaxQueueDepth

#esxcfg-advcfg -g /Disk/QFullSampleSize

#esxcfg-advcfg -g /Disk/QFullThreshold

# esxcli storage core device set --device naa.60a98000486e5334524a6c4f63624558 --queue-full-sample-size 32 --queue-full-threshold 8

# esxcli storage core device list

HBA

NetApp рекомендует использовать для FAS систем с хостом ESXi «значения по умолчанию» для HBA, устанавливаемые производителем адаптера. Если они были изменены, необходимо их вернуть к заводским настройкам.

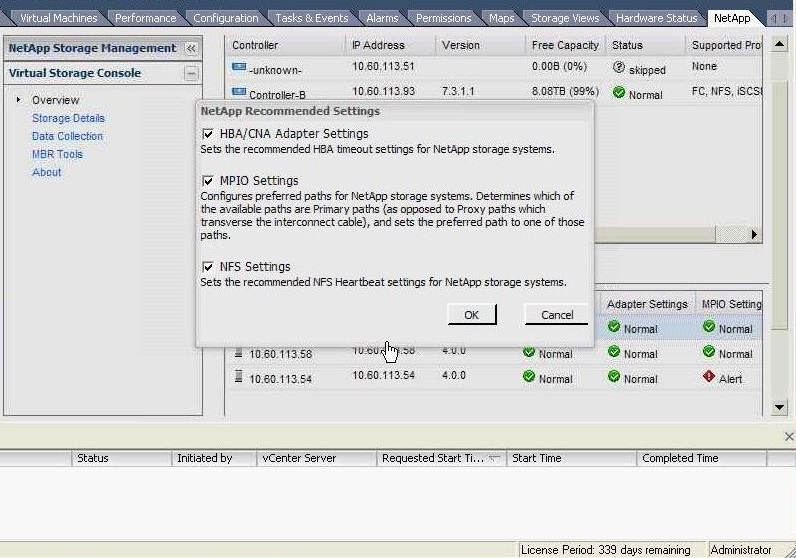

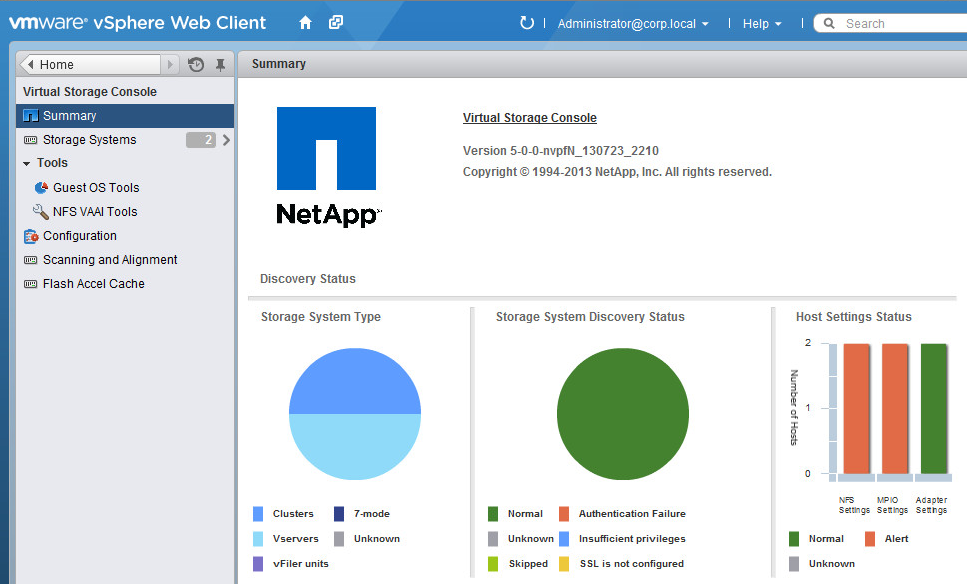

VSC

Плагин NetApp VSC (является бесплатным ПО), устанавливает рекомендуемые настройки на ESXi хосте и HBA адаптере: очередь, задержки и другие. Сам плагин интегрируется в vCenter. Экономит время и устраняет во время теста человечиский фактор при настройке параметров на ESXi хосте для более эффективной работы с NetApp. Позволяет выполнять базовые операции для управления хранилищем из vCenter, необходимые администратору виртуализированных сред. Права доступа к хранилищу при помощи VSC могут быть гибко настроены для нескольких пользователей при помощи RBAC.

Доступна версия как для «толстого» (старого) клиента так и для нового веб-клиента.

Ethernet

Jumbo frames

В случае использования iSCSI крайне рекомендуется использовать Jumbo Frames в Ethernet со скоростью выше или равно 1Gb. Подробнее в статье про Ethernet с NetApp FAS.

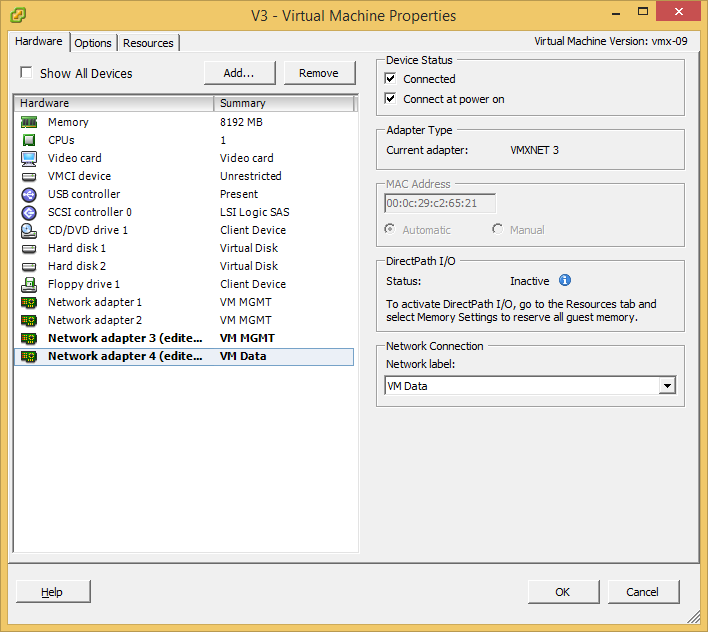

ESXi & MTU9000

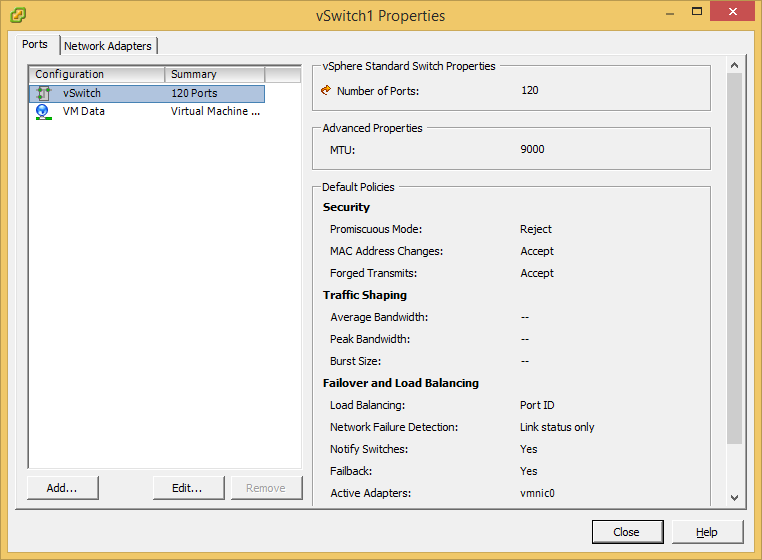

В случае использования окружения ESXi, не забудьте создать правильный сетевой адаптер — E1000 для 1GB сетей или VMXNET3 если у вас сеть выше чем 1Gb. E1000 и VMXNET3 поддерживают MTU 9000, а стандартный виртуальный сетевой адаптер типа «Flexible» не поддерживает.

Также не забудьте что порт-группа установленная для виртуального сетевого адаптера вашей виртуальной машине должна быть подключена к виртуальному свичу с установленной настройкой MTU 9000 для всего свича.

NAS

Системы NetApp FAS поддерживают примитивы VMware VAAI сгружая часть рутинных задач по управлению хранилищем с хоста на хранилище, где это более логично выполнять. В SAN окружении с ESXi 4.1+ и выше с системами NetApp FAS Data ONTAP 8.0 и выше VAAI автоматически поддерживается и не требует каких-либо манипуляций. Для NAS окружения компания NetApp выпустила плагин который позволяет выполнять подобную оптимизацию для протокола NFS. Это требует установки модуля ядра NetAppNFSVAAI для каждого ESXi хоста. VSC может выполнить установку NFS VAAI плагин автоматически из vCenter.

VASA

VASA — это бесплатное ПО которое позволяет vCenter через API узнавать о возможностях хранилища и более разумно использовать его возможности. VASA интегрируется в VSC и позволяет через GUI интерфейс создавть профили датасторов с определёнными возможностями хранилища (к примеру наличие/отстуствие Thing Provitioning, тип диска: SAS/SATA/SSD, наличие кеша второго уровня и т.д.) и включать уведомления по достижению некого уровня (к примеру заполненность или нагрузка).

Совместимость

Широко применяйте матрицу совместимости в вашей практике для уменьшения потенциальных проблем в инфрастурктуре ЦОД. Для траблшутинга обращайтесь в KB NetApp и VMware.

Уверен, что со временем мне будет что добавить в эту статью по оптимизации ESXi хоста, так что заглядывайте сюда время от времени.

Сообщения по ошибкам в тексте прошу направлять в ЛС.

Замечания и дополнения напротив прошу в комментарии

Автор: bbk