Существующие сегодня 3D-сенсоры, основанные на измерении времени прохождения луча света, подобные Kinect, могут довольно неплохо составлять карту глубин изображения, если в сцене нет полупрозрачных и отражающих поверхностей, преломляющих и искажающих путь световых лучей. Дождь, струи воды, туман или предметы из стекла или прозрачного пластика просто заслоняют более далёкие объекты, так как сенсор распознаёт только самое первое отражение сигнала.

На конференции Siggraph Asia, которая прошла в Гонконге на прошлой неделе, учёные из MIT Media Lab представили новую разработку, основанную на том же принципе. В ней используется обычный лазерный диод и недорогой сенсор. Стоимость оборудования составила всего лишь порядка 500 долларов. Единственное существенное отличие прототипа от коммерческих аналогов, таких как Kinect, заключается в прошивке.

Вместо простой периодической модуляции импульсов инфракрасного лазера, прототип MIT использует специально подобранные последовательности импульсов, имеющие автокорреляционную функцию с очень узким единичным пиком (такие сигналы используются в эхолокации и телекоммуникациях для точного измерения времени задержки сигнала. Более подробно о них можно почитать в статье "Основные принципы цифровой беспроводной связи. Ликбез", в разделе «Автокорреляционная функция. Коды Баркера»). Камера хорошо различает первые отражения от поверхности прозрачного предмета и следующие за ними отражения от более далёких объектов. Она даже способна получить чёткое изображение надписи, закрытой матовым экраном.

Разработка MIT основана на предыдущих работах: камерой с пикосекундным временным разрешением, и созданной на её основе системе, способной снимать изображение предметов, находящихся за непрозрачным препятствием. Работа системы основана на измерении времени прихода отражённого сигнала от фемтосекундной вспышки лазера. Подобным образом работают лидары, радары и эхолоты. Однако стоимость прототипа камеры, способной заглянуть за угол, составила около полумиллиона долларов, она требует длительной калибровки и обработки сигналов.

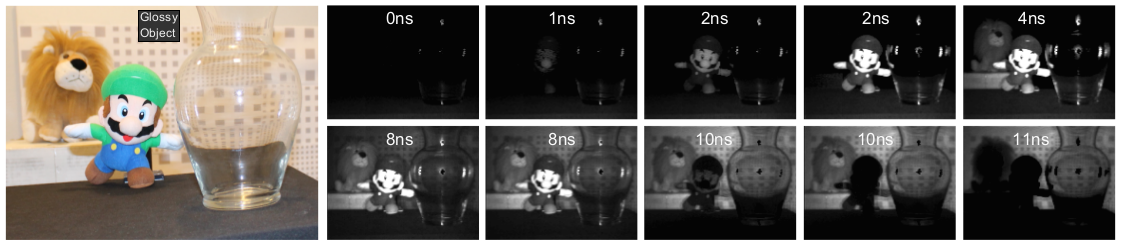

На видеороликах, которые опубликовал на Youtube участник проекта Ашута Кадамби, наглядно продемонстрировано, как камера видит продвижение фронта светового импульса вглубь сцены. Сначала камера воспринимает отражения и блики от поверхности прозрачного объекта, а затем — изображение других объектов, скрытых за прозрачным.

На видео с зеркалом в кадре продвижение светового фронта видно особенно хорошо:

У новой системы очень неплохие перспективы коммерческого применения, так как она может работать на уже существующем недорогом и массово продающемся железе. Ранний прототип тратит на обработку одного кадра около четырёх секунд, так что вполне можно надеяться на работу в реальном времени после серьёзной оптимизации. Сенсоры, построенные по новому принципу, теоретически могут заменить очень дорогие лидары в беспилотных автомобилях и тем самым приблизить их массовое внедрение, они могут использоваться в медицине, да и в целом заметно улучшить практически все характеристики 3D-камер без изменения аппаратной части.

На странице проекта можно скачать видеоролики и PDF с подробным описанием технологии.

Автор: Nordavind