Представим себе, что у нас небольшое кондитерское производство и мы хотели бы вести учет на складе сырья. Учетных позиций у нас будет не очень много, скажем, в пределах 100.

Мы не будем здесь рассматривать десятки позиций. Рассмотрим следующие пять

-

Мука пшеничная

-

Сахар песок

-

Масло растительное

-

Яйцо куриное

-

Апельсины

От пяти позиций до пятидесяти или даже до 500 это масштабируется без проблем, к тому же в реальном кондитерском производстве действительно не так уж много позиций для учета.

Сделаем Телеграм-бота, к нему вебхук, к вебхуку скрипт на Python. Это все стандартная история, много раз описанная другими. Не будем на этом останавливаться.

Итак, у нас есть обработчик сообщений, поступающих из Телеграм. Будем отправлять их на обработку большими языковыми моделями (LLM), в просторечье именуемыми искусственным интеллектом (куда уж сегодня без него). State-of-art модели сейчас позволяют организовать вызов функций на основе запроса, сформулированного на обычном человеческом языке. Т.е. пользователь говорит что-то типа: апельсины пришло 100, или апельсины поступило 100 или апельсины приход 100 или пришло 100 апельсинов и т.д. Большая языковая модель в любом случае понимает, что речь идет о поступлении на склад и предлагает вызвать функцию поступления.

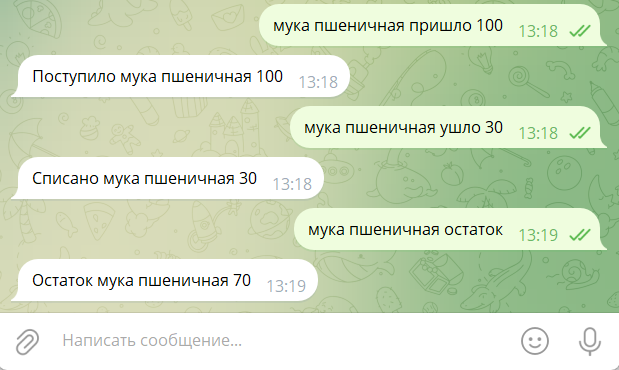

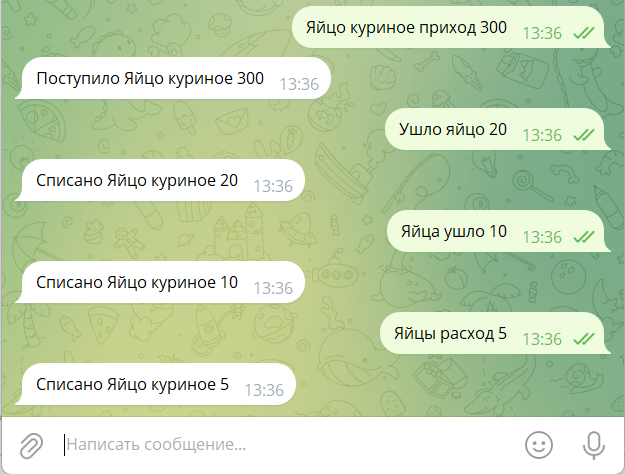

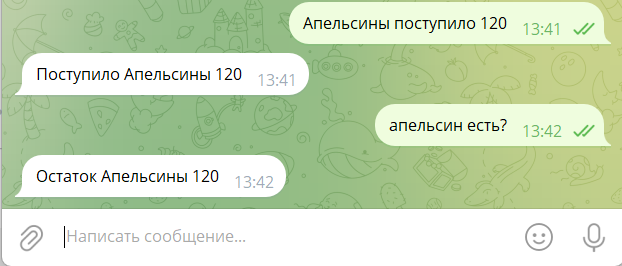

В нашем случае будет достаточно всего трех функций: поступление, списание и остаток. При каждом вызове большой языковой модели, будем передавать описание этих трех функций. В скрипте создадим реализацию этих трех функций очевидным образом. Приход будет писать в таблицу приходов, расход в таблицу расходов, а остаток получать остаток из этих двух таблиц. Результат работы такого сервиса выглядит так:

Если вы еще не знакомы с большими языковыми моделями, то у вас может к этому моменту сложиться впечатление, что все это легко ломается, стоит только вместо "мука пшеничная" сказать "пшеничная мука" или просто "мука", как это и происходит в реальной жизни. Но в том-то и фишка больших языковых моделей. Они понимают язык и от разных формулировок одного и того же они не ломаются. Поэтому общение с большой языковой моделью может выглядеть так:

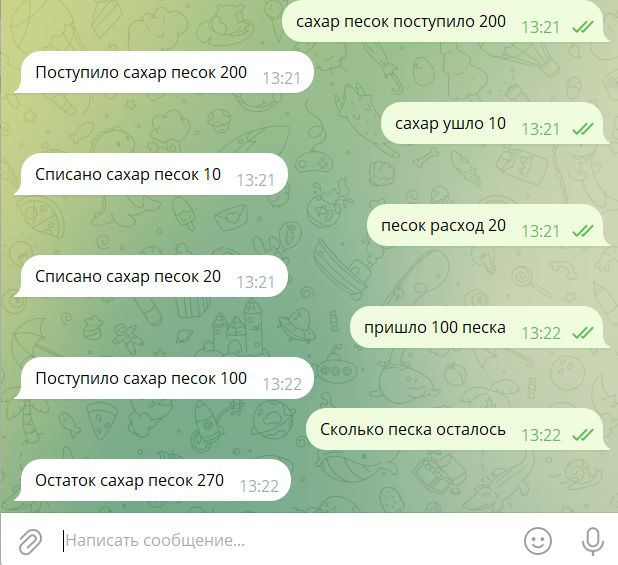

... или так:

... или так:

Что особенно приятно, это то, что сообщения можно не только писать, но и проговаривать. В этом случае потребуется задействовать еще одну модель типа speech-to-text (OpenAI обещают упростить нам жизнь в этом вопросе, но пока только обещают). Потребуется некоторая доработка скрипта, но оно того стоит. Все-таки на диктовку уходит гораздо меньше усилий, чем на письмо. Я сам начал это отчетливо понимать после многих часов тестирования как письма, так и голосового ввода.

Итак. Мы имеем складской учет, который не требует от нас ни установки ПО, ни обучения. Смартфон с Телеграм всегда под рукой у каждого. Взаимодействие происходит максимально комфортным для пользователя способом, на человеческом языке.

Гуд бай, 1С?

Автор: exwill