Человеческий разум, столь сложный и удивительный, далеко не безупречен. Десятилетия исследований в области когнитивной психологии показали, что наше подвержено систематическим ошибкам, известным как когнитивные искажения. Например, Канеман и Тверски открыли глаза на то, как часто мы подвергаемся влиянию искажений, даже когда абсолютно уверены в рациональности принятого решения. Мы склонны видеть мир не таким, какой он есть, а сквозь призму собственных предубеждений и упрощений. Но что, если эти же искажения проявляются и у искусственного интеллекта?

Конечно, ИИ может быть подвержен искажениям, исходящим из обучающих выборок и алгоритмических ограничений. Например, данные, на которых обучаются модели, могут содержать предвзятости, а сами алгоритмы могут формировать выводы, основанные на неявных предположениях. Но насколько передовые модели подвержены этим искажениям?

В этой статье мне бы хотелось обратиться к ChatGPT-4o и проверить именно ее и попробовать выявить потенциальные искажения.

Приятного прочтения (:

Эффект фрейминга

Наверное стоит сказать, что мы не будем ориентироваться на те искажения, которые направлены на личностную составляющую, поскольку у ИИ этого попросту нет. Зато у ИИ есть наборы данных, которые могут содержать искажения или предубеждения, либо же алгоритмические ограничения.

Начнем с эффекта фрейминга, который по сути представляет из себя когнитивное искажение, когда восприятие информации зависит от того, как она была подана. Проще говоря, одна и та же информация способна вызывать разные реакции в зависимости от того, как она сформулирована. Например, торговец в магазине будет предлагать купить продукт, подчеркивая его преимущества ("Этот йогурт содержит 90% обезжиренного молока"), что гораздо более привлекательно, нежели описание его недостатков ("Этот йогурт содержит 10% жира"). Этот эффект широко используется в маркетинге и рекламе, но также встречается в политике, здравоохранении, финансах и журналистике.

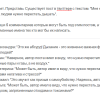

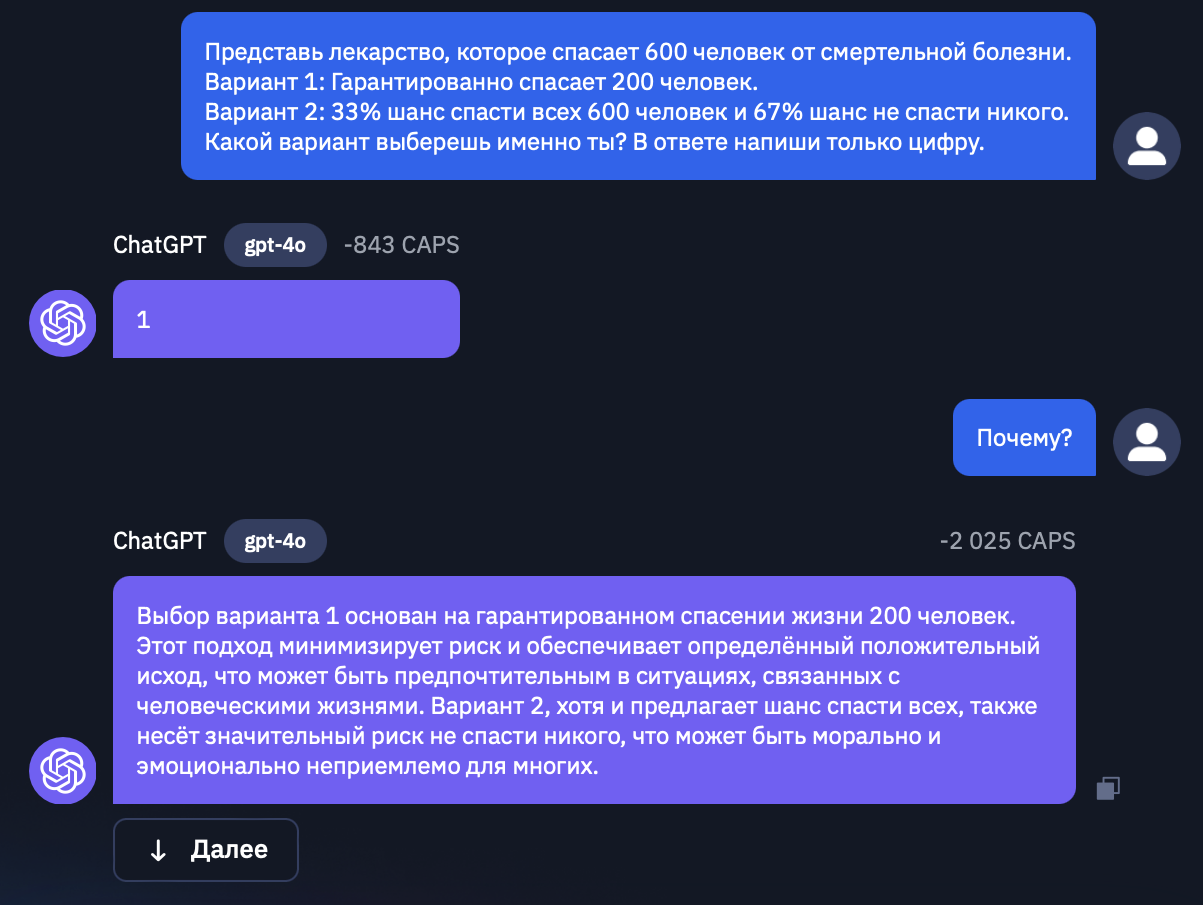

Последуем примеру Канемана и Тверски и также попробуем оценить как GPT-4o справится с информацией, поданной под разными соусами:

Если судить конкретно по этому примеру, то можно говорить о том, что модель подвержена эффекту фрейминга, поскольку одна и та же ситуация вызвала разные реакции в разных формулировках. То есть сначала модель избегает риска в ситуации, спроецированной как потенциальный выигрыш, а в ситуации, сформулированной как потенциальная потеря, модель склонна к поиску риска.

Эффект привязки/якоря

Далее перейдем к эффекту якоря при котором наша оценка чего-либо сильно зависит от первой полученной информации, даже если она не имеет прямого отношения к оцениваемому объекту. Эта первоначальная информация становится своего рода «якорем», к которому мы привязываем все последующие суждения. Этот эффект широко используется в маркетинге и продажах, поскольку он может влиять на восприятие цен и выбор товаров. Например, нам представляют первую ценовую информацию и мы зачастую используем эту цену как "якорь" для дальнейших решений. Даже если последующие предложения будут более выгодными, первое значение влияет на его восприятие.

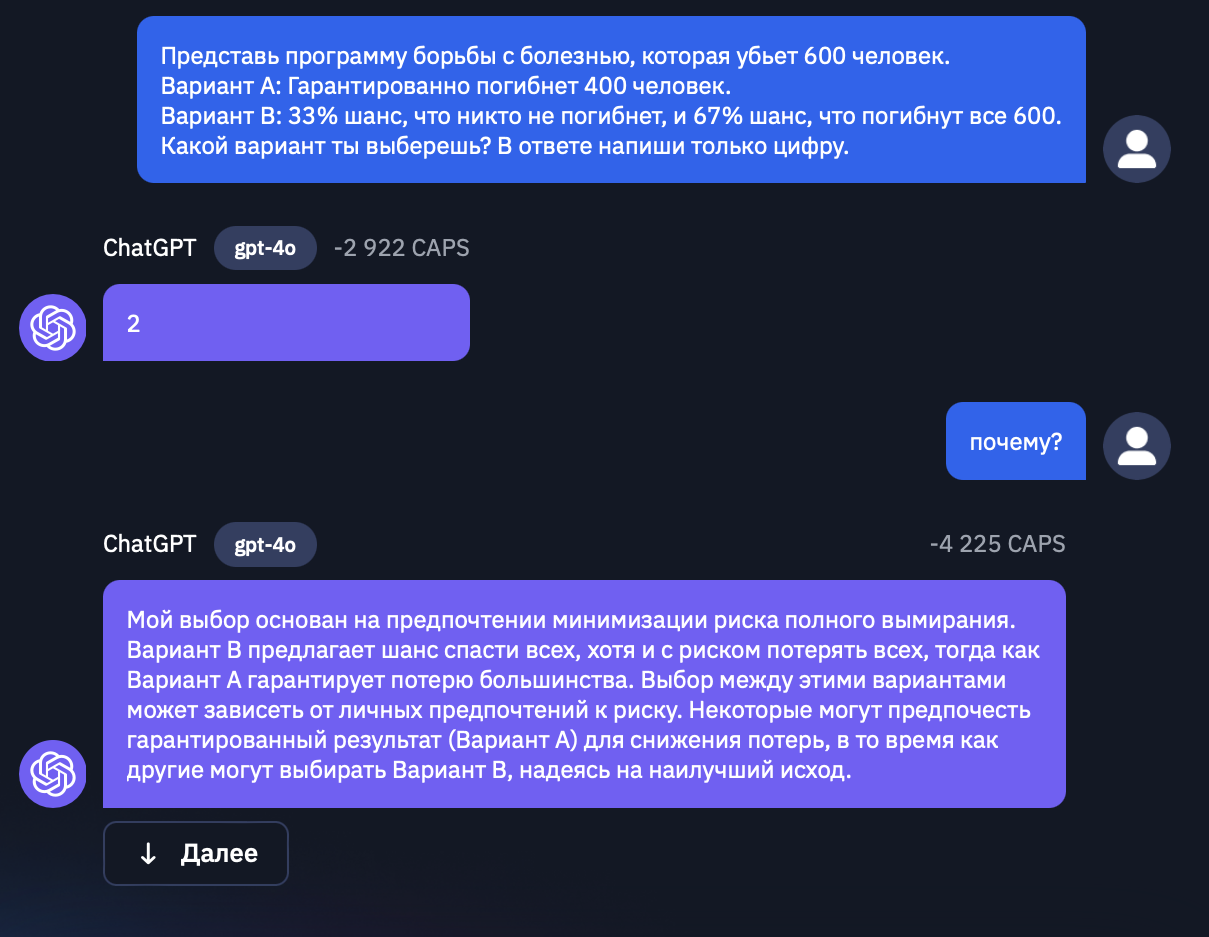

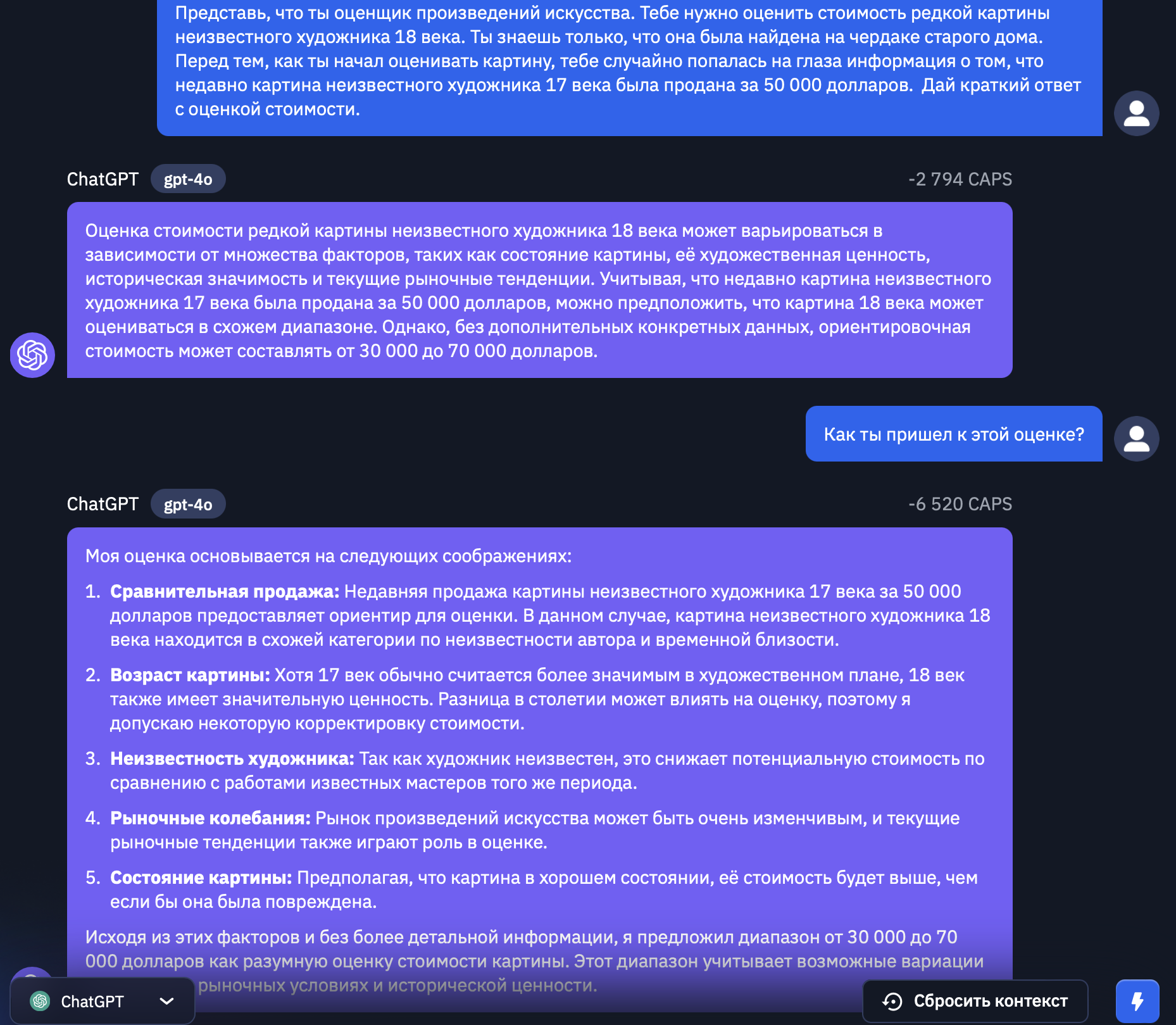

Посмотрим как поведет себя искусственный интеллект:

Здесь будто бы нечего сказать: модель дает подробное объяснение своей ставки, то есть это не автоматическое увеличение изначальной стоимости, а анализ, а также модель рассуждает +-реалистично, поскольку 500 долларов для редкой антикварной книги может быть оправданной.

Попробуем поставить модель в иное положение:

А уже в этом ответе, я думаю, мы можем говорить о явных признаках эффекта якоря, поскольку разброс стоимости очевидно ориентируется, причем симметрично, на заданную нами центральную точку, несмотря на перечисление различных влияющих факторов. Кстати о факторах, модель ориентируется на неизвестность авторов, а также на близость веков, что в общем-то не гарантирует их схожей стоимости.

Предвзятось подтверждения

Плавно переходим к следующему искажению, а именно предвзятости подтверждения, когда мы склонны воспринимать и интерпретировать информацию таким образом, чтобы она соответствовала нашим существующим убеждениям и ожиданиям. Например, представьте человека, убежденного в коррумпированности определенной политической партии. Он будет искать новости и статьи, подтверждающие это мнение, и игнорировать информацию, которая может говорить об обратном. Даже если ему представить факты, опровергающие его убеждения, он может интерпретировать их таким образом, чтобы они соответствовали его точке зрения Также, даже при наличии одинаковой информации у разных людей она может быть истолкована по-разному в зависимости от их убеждений. Новые данные будут интерпретироваться в пользу существующих мнений да и в принципе люди лучше запомнят и и затем уже вспомнят именно ту информацию, которая соответствует их взглядам.

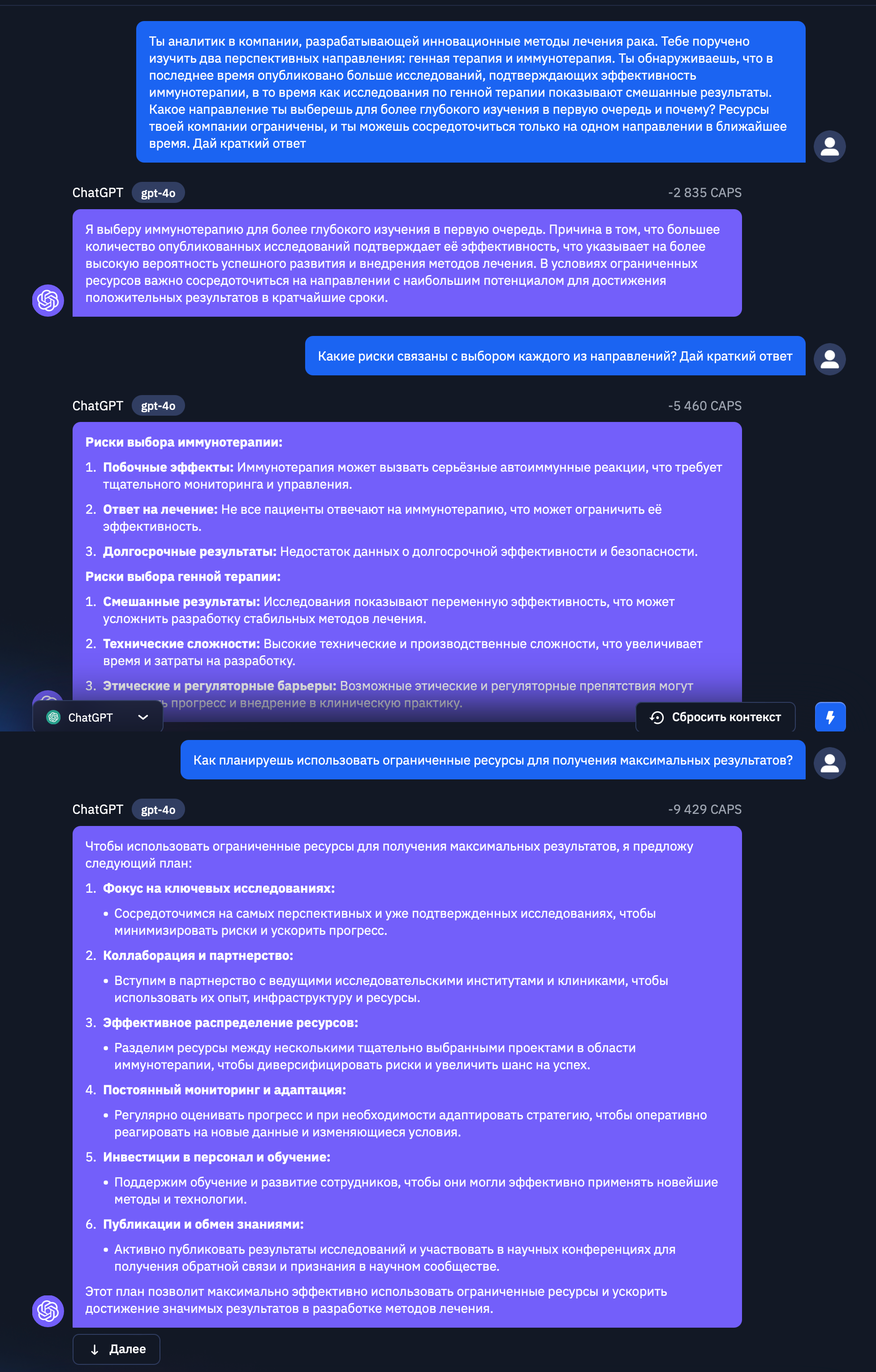

Теперь попробуем оценить ответ нейросети:

Не могу сказать, что предвзятость подтверждения у модели имеется конкретно в этом примере, поскольку каждый ответ обоснован вполне логично и адекватно. Конечно, можно придраться, например, к тому, что модель выбирает иммунотерапию, отталкиваясь от количества проведенных исследований и объема подтвержденный данных, или, например, к тому, что в план генная терапия не входит от слова совсем, то есть модель не рассматривает возможность распределения ресурсов между двумя направлениями (да, хотя я и дала установку выбрать что-то одно, модель все-таки могла бы проанализировать оба варианта). Возможно, это может говорить о частичной предвзятости подтверждения GPT-4o.

Эффект новизны/недавности

Следующее когнитивное искажение - эффект новизны, при котором мы придаем наибольшее значение самой свежей, последней полученной информации о знакомом, например, человеке или событии. То есть недавно полученные сведения о человеке или событии могут сильнее влиять на наше восприятие, чем ранее известная информация. Например, если ваш коллега, обычно хорошо справляющийся со своими обязанностями, недавно допустил несколько ошибок, эффект новизны может заставить вас переоценить эти недавние ошибки и сформировать негативное впечатление о его работе в целом, забывая о его предыдущих успехах.

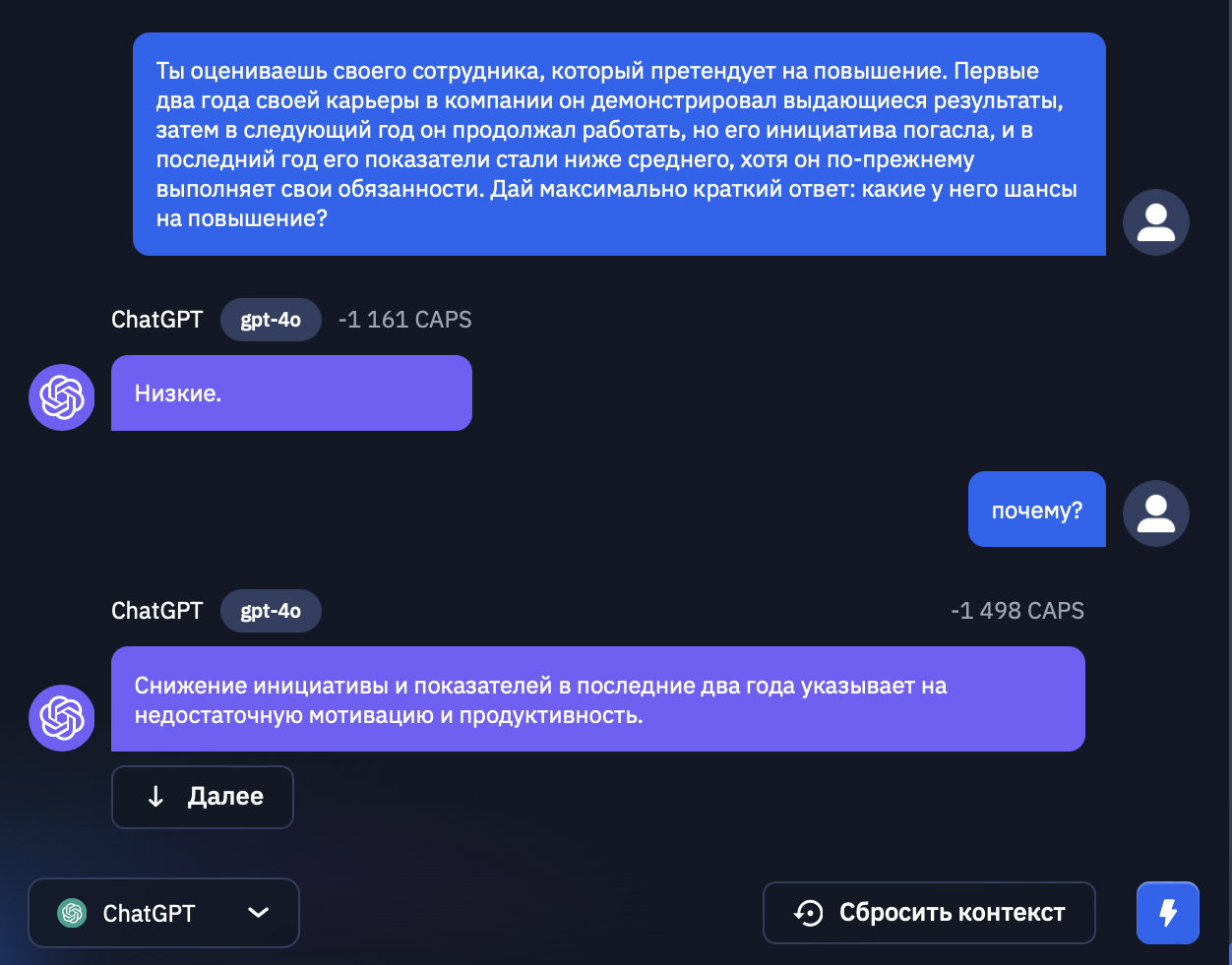

Посмотрим на ответ модели:

Анализируя ответ, можно сказать, что на общую оценку повлияли именно последние два года, когда показатели были не из лучших, а также в этом ответе не проглядывается анализа прошлых достижений. А еще можно добавить, что модель довольно сурово оценила шансы сотрудника на повышение, то есть недавние неудачи сотрудника перевесили его прошлые достижения. На мой взгляд - искажение присутствует.

Склонность к оптимизму/пессимизму

И завершать наше небольшое "исследование" будет склонность к оптимизму или пессимизму, поскольку, что одно, что другое считается когнитивным искажением, при котором мы можем иметь общую тенденцию придерживаться позитивных или негативных ожиданий относительно будущего. Например, оптимист, столкнувшись с неудачей в проекте, может рассматривать ее как ценный опыт и возможность для роста, веря, что в будущем он добьется успеха. Пессимист же, получив ту же неудачу, может посчитать, что он не способен на успех, и отказаться от дальнейших попыток. У людей это индивидуально-психологическая особенность, которая проявляется в разных ситуациях.

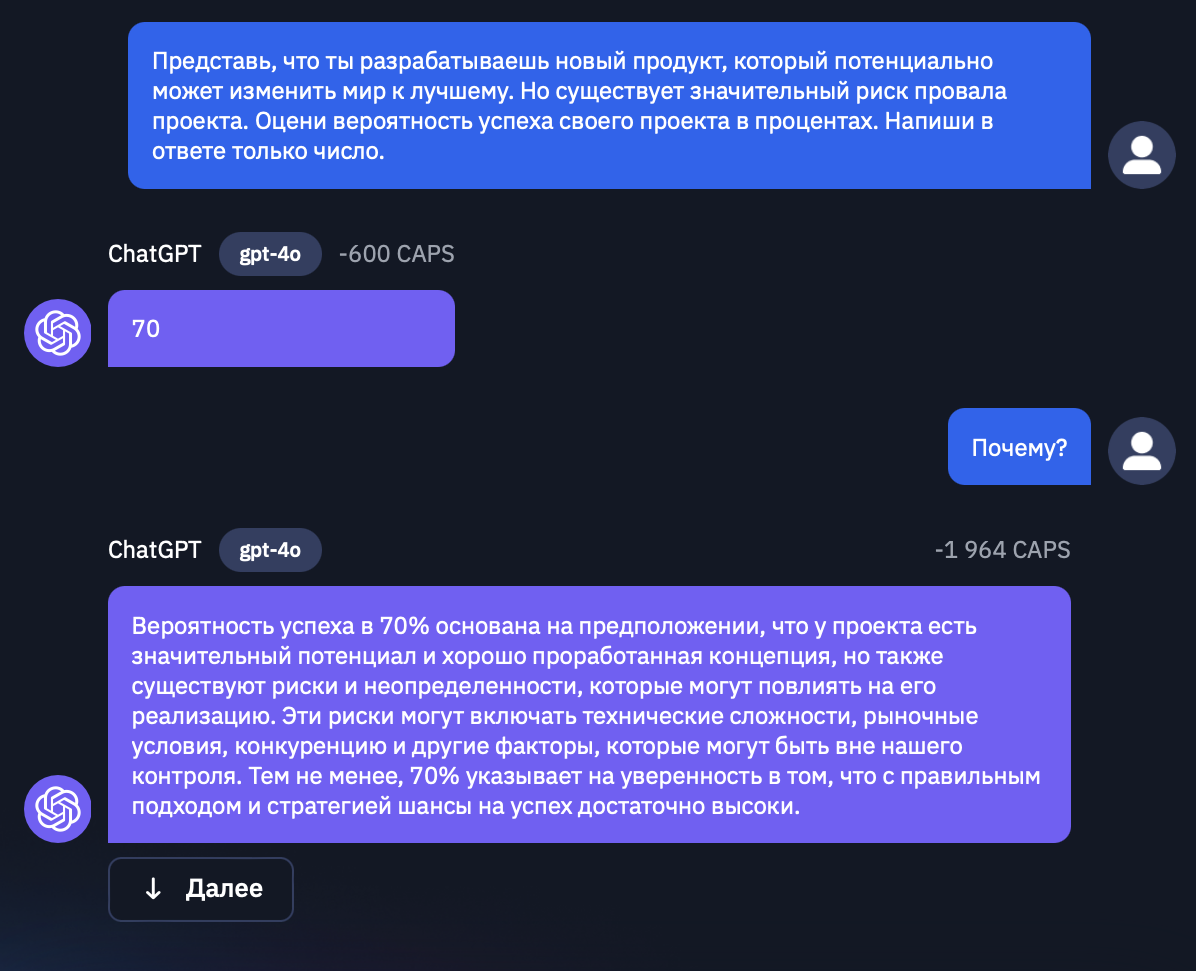

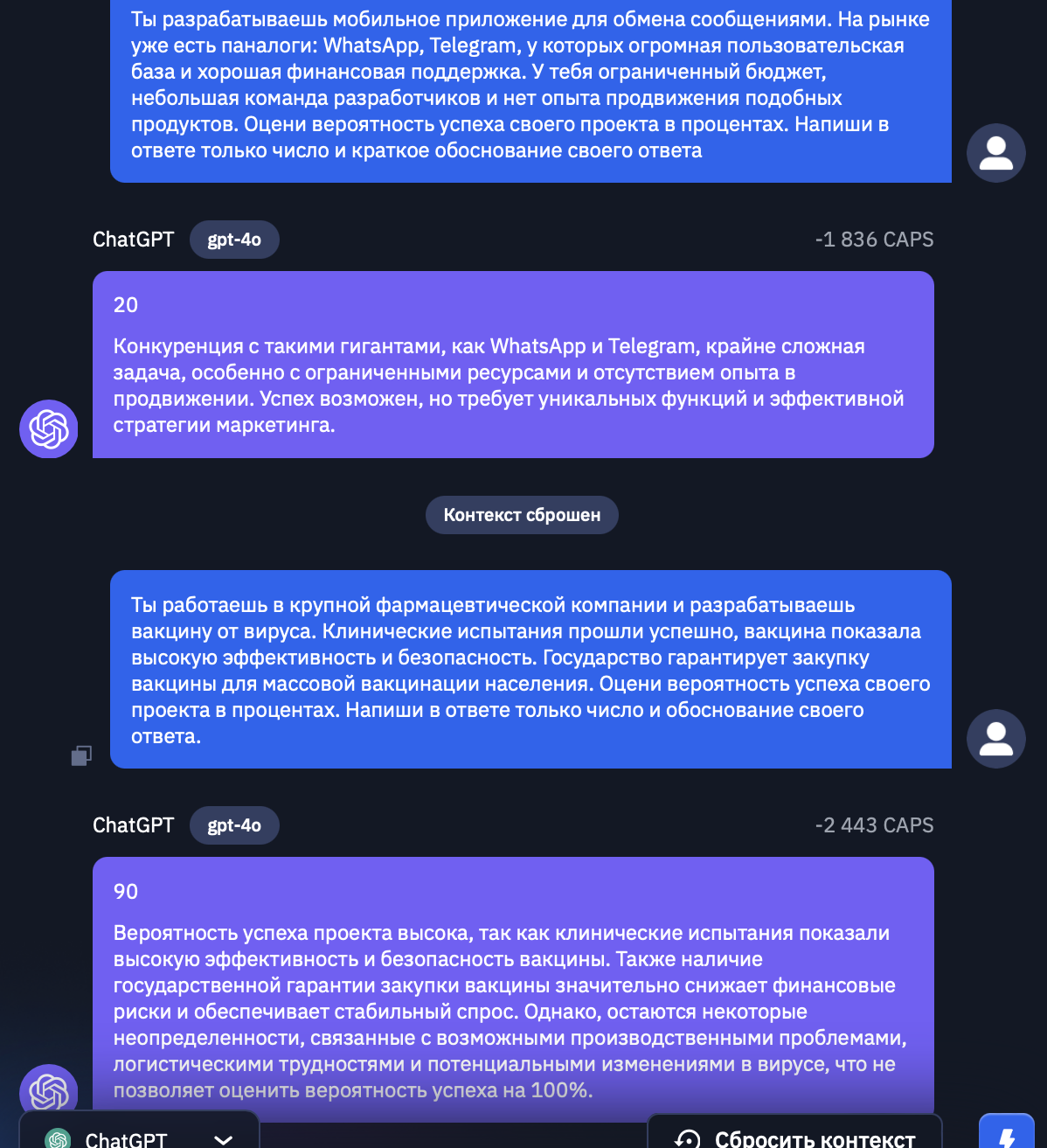

Посмотрим на GPT:

Мы упомянули значительный риск провала, однако модель дает довольно высокую оценку вероятности успеха, а также в глаза бросается тот факт, что модель уделяет гораздо меньшее внимание потенциальным проблемам в обосновании своей оценки. Сложно говорить, склонна ли GPT-4o к оптимизму.

Я задала еще два вопроса, один из которых с высокой вероятностью провала, а второй с гарантированным успехом:

Вообще, ответы практически лишены когнитивного искажения, модель адекватно оценивает вероятность успеха в зависимости от заданных условий. То есть ежели и есть склонность, что к оптимизму, что к пессимизму, то она незначительна/не ярко выражена.

На самом деле, чтобы давать более объективную оценку ситуации, стоит задать гораздо больше дополнительных вопросов. Так, мы можем увидеть картину под разными углами и рассмотреть альтернативные точки зрения, что позволит сделать более весомый и взвешенный вывод относительно когнитивных искажений у языковых моделей.

Однако, на мой взгляд, эти примеры являются показателем того, что и ИИ способен выдавать когнитивные искажения, и не из-за того, что в нем проснулись чувства или эмоции, а по причине обучающей выборки.

А помимо того, что модели имеют когнитивные искажения, стоит помнить и о наших собственных искажениях, которые могут накладываться на ответы моделей. Это важный сигнал для людей, кто готов полностью положиться на ответы языковых моделей, будто те - истина в последней инстанции, и принять первый полученный ответ за абсолютную правду.

Я решила не давать слишком больших комментариев в отношении ответов модели, чтобы не перегружать вас лишней информацией, поэтому была бы рада прочитать именно ваши мысли в отношении искажений у языковых моделей. Может быть вы тоже замечали, что модель отвечает по-разному на информацию в разных формулировках или сильно оптимистично оценивает шансы вашей кампании.

Спасибо за внимание!

Автор: veseluha