Со времен «Орнитопера» Да Винчи величайшие умы человечества черпали вдохновение из мира природы. В современном мире ничего не изменилось, и новейшие достижения в машинном обучении и искусственном интеллекте были созданы на основе самого передового вычислительного органа: человеческого .

Подражать нашему серому веществу – не просто хорошая мысль в создании более совершенных ИИ. Это абсолютно необходимо в их дальнейшем развитии. Нейронные сети основанные на глубоком обучении, такие, как в AlphaGo, а также современное поколение систем распознавания образов и перевода являются лучшими системами машинного обучения, которые мы разработали на сегодняшний день. Они способны на невероятные вещи, но, по-прежнему, сталкиваются со значительными технологическими сложностями. Например, тот факт, что для обучения конкретному навыку им необходим прямой доступ к большим наборам данных. Более того, если вы хотите переучить нейронную сеть для выполнения новой задачи, вам по существу нужно стереть её память и начать с нуля – процесс, известный как «катастрофическое забывание».

Сравните это с

Более того, человеческий ум особенно хорошо выполняет реляционные рассуждения, основанные на логике, строит связи между прошлым опытом, чтобы понять новые ситуации «на лету». Статистический ИИ (т.е. машинное обучение) способен имитировать навыки

Но что, если мы сможем объединить лучшие возможности вычислительной гибкости человеческого

Когда в июне ей давали задание на сложные вопросы об относительных позициях геометрических объектов в изображении, например: «Есть объект перед синим предметом, имеет ли он ту же форму, что и крошечная голубая штука справа от серого металлического шара?» – она правильно идентифицировала объект в 96% случаев. Обычные системы машинного обучения давали правильное решение в 42 – 77% случаев. Даже люди проходили тест лишь в 92% случаев. Правильно, этот гибридный ИИ лучше справляется с задачей, чем люди, которые его построили.

Результаты были такими же, когда ИИ были представлены проблемы со словом. Хотя обычные системы были в состоянии соответствовать DeepMind на простых вопросах, таких, как «У Сары есть мяч. Сара входит в свой офис. Где мяч?» гибридная система ИИ была вне конкуренции на более сложных вопросах вроде: «Лили – лебедь. Лили белая. Грег – лебедь. Какой цвет Грега?» На них DeepMind ответил правильно в 98% случаев по сравнению с около 45% у конкурентов.

DeepMind даже работает над системой, которая «запоминает» важную информацию и применяет эти накопленные знания к будущим запросам. Но IBM делает ещё два шага вперёд. В двух исследовательских работах, представленных на Международной Совместной Конференции по Искусственному Интеллекту 2017 года, проведённой в Мельбурне (Австралия) на прошлой неделе, IBM представила два исследования: одно из них рассматривает вопрос о том, как предоставить ИИ «внимание», а другой – изучить вопрос о применении биологического процесс нейрогенеза, то есть рождения и смерти нейронов – для систем машинного обучения.

«Обучение нейронной сети, как правило, проектируется, и очень много работы нужно, чтобы на самом деле создать определённую архитектуру, которая работает лучше всего. Почти метод проб и ошибок», – рассказала Engadget Ирина Риш, исследователь из IBM. «Было бы хорошо, если бы эти сети могли строить себя сами».

Алгоритм внимания IBM информирует нейронную сеть о том, какие входы обеспечивают наивысшую награду. Чем выше вознаграждение, тем больше внимания будет уделять им сеть. Он особенно полезен в ситуациях, когда набор данных не является статическим – то есть в реальной жизни. «Внимание – это механизм, основанный на вознаграждении, это не просто что-то, не связанное с принятием решений и нашими действиями», – сказала Риш.

«Мы знаем, что, когда мы видим изображение, человеческий глаз обычно имеет очень малое поле зрения», – сказала Риш. «Таким образом, в зависимости от разрешения вы видите только несколько пикселей изображения [резкими], но все остальное выглядит размытым. Дело в том, что вы быстро перемещаете взгляд, и механизм сборки различных частей в образ в правильной последовательности позволит вам быстро распознать изображение».

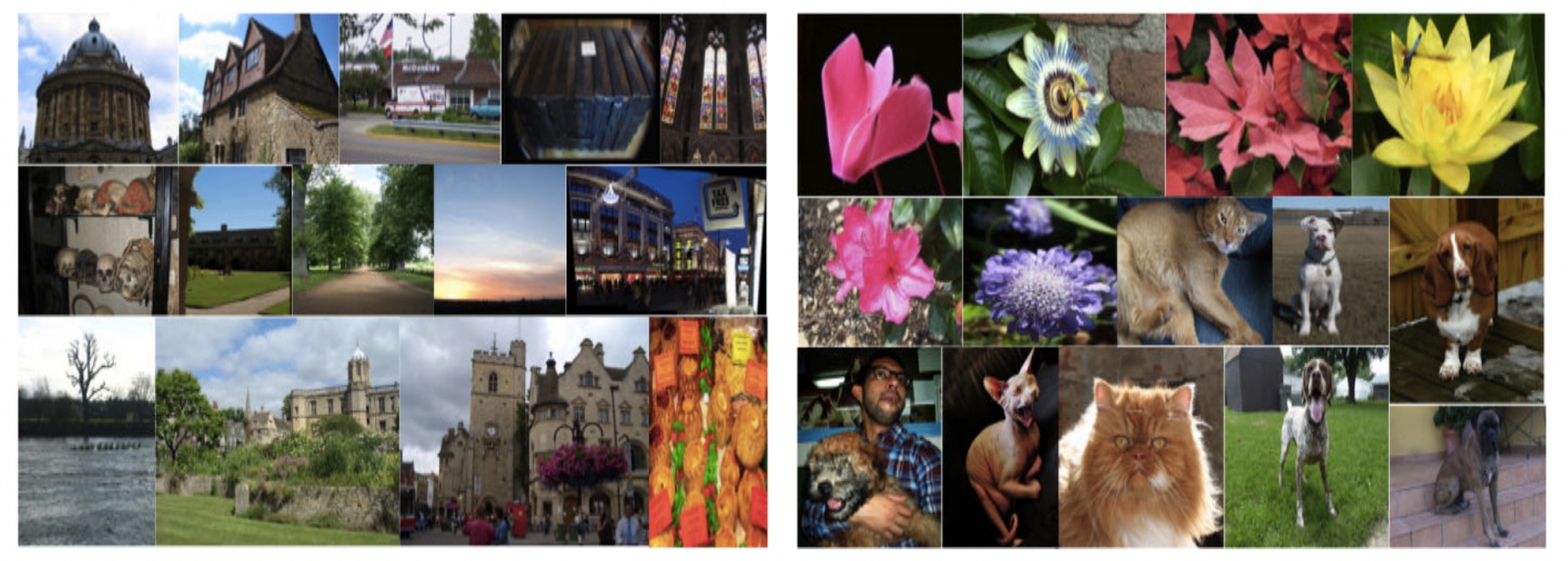

Первое использование функции внимания, скорее всего, будет в распознавании образов, хотя оно может быть использовано в различных областях. Например, если вы тренируете ИИ с использованием оксфордского набора данных, который является главным образом архитектурными изображениями, он легко сможет правильно идентифицировать городские пейзажи. Но если вы покажете ему кучу картин из сельской местности (поля и цветы и т. д.), ИИ окажется в замешательстве, потому что он не знает, что такое цветы. А когда вы проводите те же тесты с людьми и животными, вы будете стимулировать нейрогенез, поскольку их

Механизм говорит системе, на чем она должна сосредоточиться. Например, возьмите своего врача, она может провести сотни возможных тестов на вас, чтобы определить, что вас беспокоит, но это невозможно: либо по времени, либо по разумным ценам. Итак, какие вопросы она должна спросить и какие тесты следует проводить, чтобы получить лучший диагноз за наименьшее количество времени? «Это то, что алгоритм учится выяснять», – объяснила Риш. Он не просто определяет, какое решение приводит к лучшему результату, но и узнает, где искать данные. Таким образом, система не только принимает более правильные решения, но и делает их более быстрыми, поскольку не запрашивает части набора данных, которые не применимы к текущей проблеме. Точно так же, как ваш врач не касается ваших колен странным маленьким молоточком, когда вы приходите с жалобами на боль в груди и одышку.

В то время как система внимания удобна для обеспечения того, чтобы сеть выполняла задачу, работа IBM по нейронной пластичности (насколько хорошо запоминаются «воспоминания») служит для обеспечения долговременной памяти сети. Это фактически смоделировано на основе тех же механизмов рождения и смерти нейронов, которые наблюдаются в человеческом гиппокампе.

В этой системе «вам не обязательно обязательно моделировать миллионы параметров», – пояснила Риш. «Вы можете начать с гораздо меньшей модели, а затем, в зависимости от данных, которые вы видите, они будут адаптироваться».

Когда ей представлены новые данные, нейрогенетическая система IBM начинает формировать новые улучшенные связи (нейроны), в то время как некоторые из более старых, менее полезных будут «обрезаны», – как выразилась Риш. Это не означает, что система буквально удаляет старые данные, она всего лишь становится менее привязана к ним – так же, как ваши старые воспоминания, как правило, становятся нечёткими на протяжении многих лет, но те, которые несут значительную эмоциональная нагрузку, остаются яркими в течение многих лет.

«Нейрогенез – это способ адаптации глубоких сетей», – сказала Риш. «Нейронная сеть – это модель, и вы можете построить эту модель с нуля, или вы можете изменить эту модель, когда нужно, потому что у вас есть несколько слоёв скрытых нейронов, и вы можете решить, сколько их (нейронов) вы хотите иметь… в зависимости от данных.»

Это важно, потому что вы не хотите бесконечного расширения нейронной сети. Если бы это произошло, набор данных стал бы настолько большим, что был бы не по силам даже для цифрового эквивалента гипертимезии. «Это также помогает с нормализацией, поэтому [ИИ] не 'передумывает' данные», – сказала Риш.

В совокупности эти достижения могли бы быть очень полезны исследовательскому сообществу ИИ. Команда Риша хочет работать над тем, что они называют «внутренним вниманием». Вы будете не просто выбирать, какие данные вы хотите видеть в сети, но и какие части сети вы хотите использовать в расчётах на основе набора данных и входов. В основе модель внимания будет охватывать краткосрочный, активный, мысленный процесс, в то время как часть памяти позволит сети оптимизировать свою функцию в зависимости от текущей ситуации.

Но не ожидайте, что в ближайшее время ИИ сможет соперничать с сознанием человека, – предупреждает Риш. «Я бы сказала, по крайней мере, несколько десятилетий, – но, опять-таки, это лишь предположение. Что мы делаем сейчас, с точки зрения высокоточного распознавания образов, всё ещё очень, очень далеко от базовой модели человеческих эмоций», – сказала она. «Мы лишь начали».

Автор: Ariel VA Feinerman