Учёные из Университета Цукубы и Технологического Университета Тойохаси представили новую статью на SIGGRAPH Asia 2019. Она называется «Анимационный пейзаж: изучение самостоятельного движения и внешнего вида объектов для синтеза видеоизображений из одного изображения». Их метод с помощью свёрточных нейронных сетей (CNN) может создавать анимацию с высоким разрешением из одного ландшафтного изображения.

«Из пейзажного изображения люди могут представить, как движутся облака и меняется цвет неба с течением времени. Воспроизведение таких переходов — довольно распространённое явление. Например, люди используют синемаграммы и другие методы».

К сожалению, отмечают учёные, при использовании подобных методов разрешение и качество полученного видео часто оказывается намного ниже ожидаемых. Одной из причин неудовлетворительных результатов является то, что пространственно-временная область видео слишком велика по сравнению с изображениями. Другая причина — неопределенность в будущем, в прогнозировании кадров.

«Например, представьте облака на небе в одном неподвижном изображении. Облака могут двигаться влево, вправо, вперед или назад в следующих кадрах в соответствии с факторами окружающей среды, такими как, например, ветер. Из-за такой неопределенности создание уникального вывода из одного входа (то есть сопоставление начального и конечного изображений «один к одному») трудно и нестабильно», — утверждают исследователи.

В своей статье японцы предлагают поход, основанный на машинном обучении, который может создать видео высокого разрешения из одного изображения.

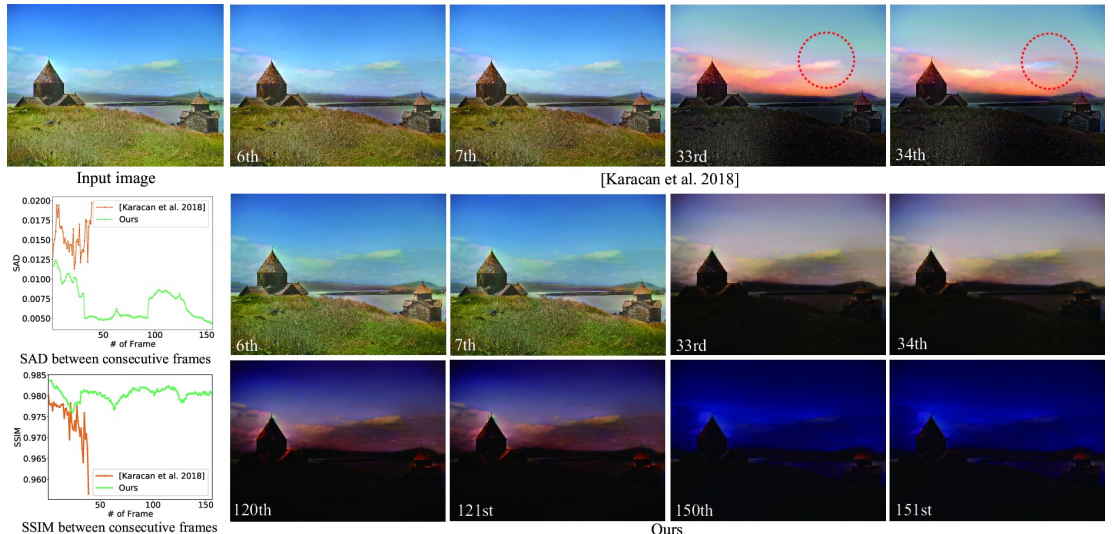

«Наша ключевая идея — изучить интенсивность движения (например, скорость движущихся облаков в небе и рябь на озере) и внешний вид (например, изменяющиеся во времени цвета днём, на закате и ночью) по отдельности, учитывая их пространственно-временные различия. Например, облака быстро движутся по временной шкале, тогда как цвет неба меняется медленно в масштабе десятков минут. Кроме того, у движущихся облаков обычно имеются свои естественные детализированные узоры, в то время как цвет неба меняется плавно».

Имея это в виду, учёные изучают и предсказывают движение и внешний вид разных объектов отдельно. Изображения с добавленным движением затем генерируются в видео путем восстановления пикселей из входного изображения.

«Наше ключевое наблюдение заключается в том, что движение (например, движущиеся облака) и внешний вид (например, изменяющиеся во времени цвета на небе) в естественных сценах имеют разные временные масштабы. Таким образом, мы изучаем их по отдельности и прогнозируем их внешний вид с помощью нейросетей».

В отличие от предыдущих методов, которые выводят кадры напрямую, нейронные сети, разработанные японскими учёными, предсказывают промежуточные варианты. Такое использование нейросетей имеет большое значение для уменьшения ошибок в долгосрочных прогнозах внешнего вида изображения.

Тем временем, исследователи Массачусетского технологического института представили технологию, которая позволяет восстановить данные из фотографий и видеозаписей низкого качества. Технология использует нейросети, с помощью которых сопоставляет низкоразмерные проекции с оригинальными многомерными изображениями и видео — например, создаёт точные кадры снимка с движением людей, исходя из информации о траектории движения человека.

В ходе эксперимента было записано 35 видео с 30 людьми, идущими в одном месте. В итоге алгоритм точно воссоздал 24 кадра, передав изменение перспективы. Таким образом, нейросеть поняла, что пиксели, которые становятся темнее и шире, скорее всего, означают приближение человека к камере.

Автор: AnnieBronson