Представьте, что вы купили видеокарту с 8 ГБ VRAM, а через год игры или иференсы модели стали требовать 32 ГБ. Не проще ли было бы докупить модуль памяти, как с оперативкой? Увы, это невозможно. Почему же производители десятилетиями игнорируют модульность видеопамяти? Давайте разбираться.

VRAM vs RAM: в чём принципиальная разница?

Оперативная память (RAM) и видеопамять (VRAM) решают разные задачи.

- RAM работает с CPU: она обрабатывает множество мелких запросов с низкой задержкой.

- VRAM «кормит» GPU: графический процессор требует огромных объёмов данных (текстуры, шейдеры) с колоссальной скоростью.

Это как сравнить водопроводную трубу (RAM) и пожарный гидрант (VRAM). Первая универсальна, второй — узкоспециализирован.

Технические ограничения: почему нельзя просто добавить воды слоты?

1. Пропускная способность и шина данных

Современная GDDR6-память в видеокартах передаёт данные со скоростью до 1 ТБ/с (например, RTX 4090). Для этого используется широкий канал (256–384 бит), соединяющий GPU с распаянными чипами памяти.

Если бы память была модульной:

- Увеличилась бы длина проводников → выросли задержки.

- Контроллер памяти в GPU не смог бы гибко подстраиваться под разные конфигурации.

Пример: Даже DDR5 с её 64-битной шиной даёт лишь ~50 ГБ/с. Этого катастрофически мало для GPU.

2. Тепловыделение и компактность

Чипы VRAM расположены вплотную к GPU и охлаждаются общей системой. Модули пришлось бы размещать дальше, что:

- Увеличило бы размер платы.

- Усложнило теплоотвод (чипы GDDR6 нагреваются до 90–100°C).

Итог: Модульность убила бы компактность и эффективность охлаждения.

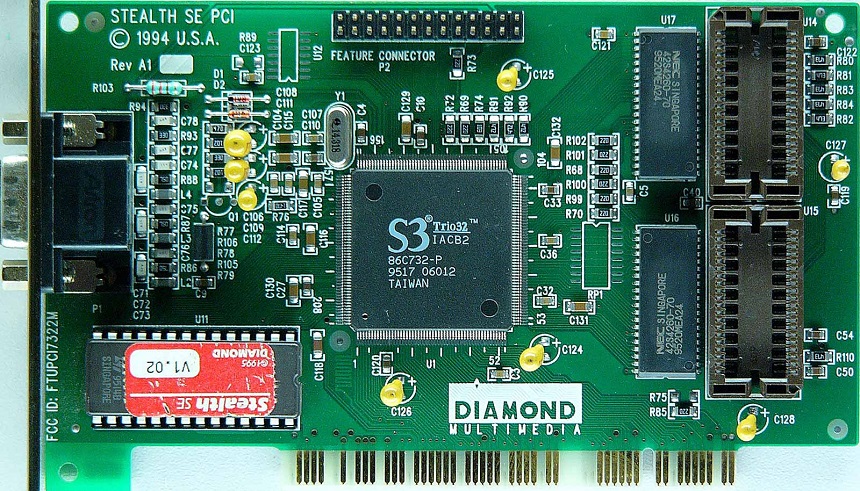

Почему это не изменилось с 1990-х?

В 90-х некоторые видеокарты (например, ATI All-in-Wonder) имели слоты для расширения VRAM. Но технология умерла, и вот почему:

- Рост интегрированных решений: Производители поняли, что распайка памяти даёт больший контроль над производительностью.

- Стандартизация провалилась: Каждый бренд пытался продвигать свой слот, что запутало пользователей.

- Экономическая выгода: Производителям выгоднее продавать новые модели, чем позволять апгрейдить старые.

Современные реалии: HBM и тупик модульности

Технология HBM (High Bandwidth Memory) — это вершина эволюции VRAM. Чипы памяти размещаются вертикально на интерпозере рядом с GPU, что обеспечивает:

- Скорость до 3 ТБ/с (HBM3).

- Крайне короткие проводники для минимизации задержек.

Но HBM ещё менее совместим с модульностью, чем GDDR. Его нельзя заменить — только распаять на этапе производства.

Альтернативы: как обходятся без модулей?

- Облачные GPU (NVIDIA A100, H100): Аренда карт с 80+ ГБ памяти через сервисы вроде AWS.

- Распределённые вычисления: Разделение модели между несколькими GPU (например, через NVLink).

- Оптимизации:

- Квантизация (сжатие весов нейросетей до 4 бит).

- Градиентный чекпоинтинг (экономия памяти при обучении моделей).

Будущее: есть ли шанс у модульной VRAM?

Скорее нет. Тренды указывают на:

- Ужесточение интеграции: Чиплетные дизайны (как у Ryzen) и 3D-упаковка (как в HBM).

- Рост специализации: ИИ-ускорители (например, TPU от Google) вообще отказываются от классической VRAM.

- Экономическое сопротивление: NVIDIA и AMD не заинтересованы в снижении продаж новых GPU.

Заключение

Модульная VRAM — это «святой Грааль» для энтузиастов, но технически она почти нереализуема. Даже если инженеры преодолеют аппаратные ограничения, рыночные законы похоронят идею. Пока единственный выход — покупать видеокарты с запасом памяти или переходить в облака.

Автор: mikhashev