Второе пришествие мейнфреймов. Всё больше компаний хотят запускать ИИ у себя в офисе

[1]

[1]Мейнфрейм IBM z16 [2] во время лабораторных тестов в 2022 г, источник [3]

Приложения ИИ находят применение в бизнесе. Но есть проблема: корпоративные данные и документация представляют коммерческую тайну. Их нельзя передавать на сторону, тем более в облачную систему машинного обучения. Кроме того, что сама передача небезопасна, так ещё и публичная модель будет обучаться на наших секретах [4], а потом помогать конкурентам.

В общем, у коммерческих компаний остаётся один вариант: поднимать собственный сервер или вычислительный кластер с ИИ. Таким образом, из эпохи облачных вычислений мы возвращаемся к старому доброму самохостингу, только сейчас это самохостинг GPU [5], серверы и мейнфреймы.

При этом и рынок дата-центров переживает второе рождение, количество ЦОДов, которые сдаются в эксплуатацию, удвоилось по сравнению с 2022 годом [6]. Запускаются и новые облака, специально для ИИ-вычислений [7]. Одновременно растёт спрос и на «частные» мейнфреймы, которые можно установить на своём , даже в офисе. И на самодельные вычислительные кластеры.

Например, интернет-стартап Gumlet [9], который оказывает услуги по

Для сравнения, один сервер (AMD 5700x, 64 ГБ DDR4, 512 ГБ NVMe SSD, Nvidia RTX4000 ADA SFF GPU) обошёлся в $2300, в то время как аренда такого сервера на AWS стоит $703 в месяц.

Многие [10] другие [11] компании тоже сэкономили миллионы долларов, когда ушли из облака на самохостинг.

▍ Частные мейнфреймы

Как сообщается [3], многие компании и без всякого ИИ полагались на собственные частные дата-центры и мейнфреймы. Они ещё не успели переехать в облако: банки, крупные страховые, финансовые, телекоммуникационные и авиакомпании. Теперь же они стали первыми заказчиками специализированных ИИ-мейнфреймов, чтобы добавить их в собственный парк.

Для некоторых заказчиков переход в облако вообще не вариант, если для них критически важна скорость выполнения транзакций — когда каждая миллисекунда имеет значение. Например, банки выявляют фродовые транзакции за миллисекунды в реальном времени. Или компания высокочастотного трейдинга, для которой одна миллисекунда разницы во времени покупки или продажи на бирже отличает прибыль от убытка [12].

10 миллисекунд торговли акциями корпорации Merck, визуализация медленнее реального времени в 40 000 раз, источник [12]

Высокочастотные трейдеры даже свои дата-центры располагают физически как можно ближе к биржевому ЦОДу, и прокладывают оптоволокно по максимально короткому пути, потому что скорость света имеет значение [13].

С точки зрения производительности всем очевидно, что эффективнее поставить ИИ-систему туда, где лежат данные, а не копировать данные на удалённый ЦОД, где стоит ИИ. Поэтому и производители в последнее время отмечают рост продаж. У IBM в 2024 году продажи мейнфреймов выросли на 6%.

По статистике IDC [14], в 2022 году около 55% корпоративных данных хранилось в публичных облаках, а к 2027 году эта доля вырастет до 71%. Но спрос на самохостинг никогда не исчезнет, пока остаются актуальными вопросы безопасности и производительности. Кроме того, разница между частными дата-центрами и публичными облаками постепенно стирается: они становятся похожи друг на друга по аппаратной архитектуре и ПО.

▍ Новое железо

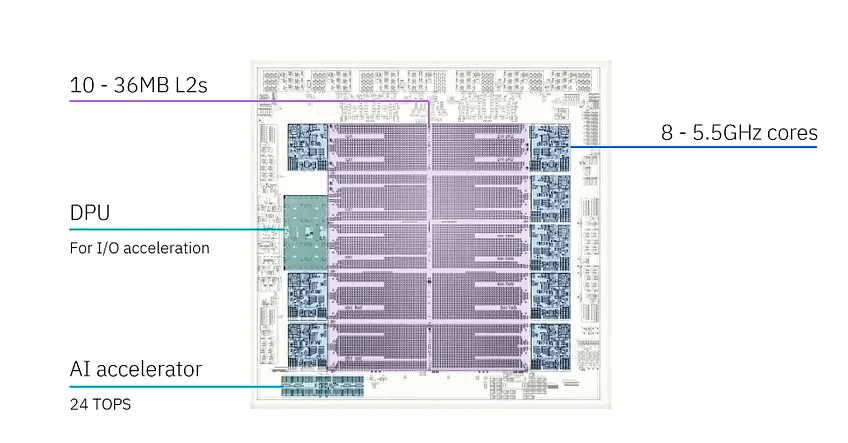

Для вышеупомянутой системы z16 [2] компания IBM выпустила новые CPU Telum II [15], для ИИ-мейнфреймов IBM z16 [2]. Как отмечается, на этом CPU и новых мейнфреймах можно запускать любые современные LLM, такие как ChatGPT.

Telum II не похож ни на один серверный процессор. В нём всего восемь ядер, но они работают на высокой частоте 5,5 ГГц и снабжены 360 МБ кэша на кристалле. Также на чипе расположен DPU для ускорения ввода-вывода и встроенный AI-ускоритель. Telum II производится по техпроцессу Samsung 5 нм.

В производительности системы важную роль играет скорость и объём кэша. Здесь IBM применила необычное решение, разместив на кристалле аж десять модулей L2 по 36 МБ, итого 360 МБ. Для сравнения, кэш L3 в настольных и серверных процессорах Zen 3 от AMD обычно составляет 32 МБ.

<img src=«habrastorage.org/webt/xu/wg/6a/xuwg6aifjxor4wczod6hwzq8hfo.png [16]» align=«center>Зелёный — кэш L2, красный — виртуальный L3

Восемь кэшей L2 у Telum II подключены к ядрам, ещё один — к DPU, а последний, десятый, ни к чему не подключён.

Ещё одна интересная деталь — отдельные кэши L2 на этой микросхеме совместно формируют «виртуальный кэш L3»). Согласно патенту IBM [17], у каждого L2 есть «метрика насыщения» в зависимости от того, насколько часто ядро записывает туда данные. Когда L2 выбивает строку кэша, чтобы освободить место для входящих данных, эта выбитая строка переходит в другой L2 с более низкой метрикой насыщения.

Система объединённого пула виртуальной памяти действует не только в рамках микросхемы, но и всего мейнфрейма в целом. Именно так организован виртуальный кэш L4 на основе кэшей L3 в «процессорном комплексе» CPC (Central Processor Complex) для z16.

Интересная деталь: в комплекте с этой системой IBM предлагает даже ИИ-помощника в программировании WatsonX, (аналог Github Copilot и др.), который среди прочего поможет клиенту переписать кодовую базу с Cobol на Java [18].

WatsonX

IBM z16 — это система с хранилищем на 40 ТБ, специализированными ИИ-процессорами и стоимостью до $1 млн. Мейнфрейм в полной сборке весит около 820 кг.

IBM — главный производитель мейнфреймов в мире с рыночной долей более 96%. Конкуренты NEC, Fujitsu и Hitachi далеко позади. По статистике самой IBM, 90% крупнейших банков и 80% крупнейших авиакомпаний по-прежнему используют мейнфреймы в качестве основной платформы. Мировой рынок таких систем в 2023 году оценивался в $3,05 млрд.

В ближайшее время на этом рынке явно грядут изменения: всё больше компаний проявляют интерес к использованию моделей ИИ, причём хотят делать это на собственном железе и на самохостинге. Вариантов тут много: например, недавно мы рассказывали про локальные облачные серверы 0xide [19], которые хоть и работают в облаке, но устанавливаются на местах в офисе клиента.

Корпорации Microsoft и Meta недавно представили новую серверную архитектуру Mount Diablo [20], спроектированную для AI-вычислений, где стойки с блоками питания отделены от вычислительных блоков.

В традиционных вычислительных системах плотность мощности в стойке обычно не превышает 20 кВт, а в системах ИИ она возрастает до сотен кВт. Чтобы адаптироваться к этим изменениям, пришлось оптимизировать все уровни инфраструктуры. В данном случае — разделить единую стойку на серверную и силовую, каждая из которых оптимизирована для выполнения своей основной функции. Это позволяет в том числе поместить в одну стойку на 35% больше ИИ-ускорителей.

▍ Домашний сервер

Современные серверы можно устанавливать не только в серверных комнатах в офисе, но и дома. Некоторые производители даже предлагают выполнить интерьер в виде серверных стоек [21]. В таком интерьере компьютерное железо вполне органично будет смотреться посреди выдвижных ящиков, обуви и одежды:

Такие стеллажи чем-то напоминают модульную систему полок [22] или знаменитый LackRack [23], серверную стойку из столика Ikea:

Оказывается, по счастливой случайности габариты этих столиков идеально совпадают с габаритами стандартных серверных юнитов.

Существует AnythingLLM [24], llamafile [25], Ollama [26], GPT4All [27] и другие десктопные оболочки для запуска ИИ локально на своём компьютере.

На макбуке с 64 ГБ оперативной памяти [28] запускается Llama 3.3 70B [29]. А ведь это новейшая модель класса GPT-4.

В общем, поднять на фирме собственный вычислительный кластер для ИИ-вычислений — вполне реальная задача. Самые маленькие LLM запускаются на ноутбуках [30]. Например, есть агент для автодополнения кода Twinny [31], плагин для Visual Studio Code, аналог GitHub Copilot, но только полностью локальный и на 100% приватный.

Вот другие системы ИИ, разработанные специально для самохостинга:

- Khoj, [32]

- LocalAI, [33]

- llama.cpp, [34]

- … см. также сообщество /r/LocalLLaMA/. [35]

Всё это можно установить на домашнем сервере.

▍ ИИ и вопрос доверия

Открытым остаётся вопрос доверия ИИ [36]: насколько мы можем верить, что ИИ-агент действует именно в наших интересах, а не в своих собственных? Например, анализ ИИ-девушек с точки зрения безопасности [37] показал тревожные знаки: оказалось, что девушки собирают приватную информацию о парнях и отправляют на удалённый сервер. Замечены также случаи саботажа программного кода со стороны ИИ-помощников [38].

Уже доказано, что ИИ врёт убедительнее человека [39]. А у человечества и так с этим проблемы: уровень доверия в обществе ко всем институтам упал до минимального уровня [40], а это повышает стоимость социальных транзакций и мешает экономическому развитию.

Доверие общества к разным американским институтам в 2018−2021 гг

Повсеместное использование LLM может усугубить ситуацию.

Дипфейки и дезинформация и так уже стали нормой [41]. ИИ вдобавок открывает возможности для массовой слежки [42].

Учёные сейчас изучают, как поведение людей меняется в присутствии вездесущих ИИ-помощников. Есть интересные эффекты [43]. Например, в одном из опытов игрокам-людям предлагали онлайн-игру, в которой нужно было найти и нажать на цель для запуска анимации, в то время как на самом деле алгоритм запускал анимацию до нажатия игроком. Анимация основывалась на истории прошлых движений игроков и на начале их текущего движения руки. Учёные использовали моделирование с помощью машинного обучения, чтобы определить, как игроки вычисляют своё ощущение власти над анимацией. И в итоге они обнаружили, что менее чем за час игроки адаптировались к новому ощущению, будто они действительно управляют анимацией, хотя та появляется до нажатия на кнопку.

Учёные считают, что результаты этих исследований помогут в будущем адаптировать системы ИИ к человеческой психике. Алгоритмы позволят создать такие механики, чтобы человек всегда сохранял чувство контроля над ситуацией, даже если действия запрограммированы и происходят заранее. Это отчасти опасное изобретение, тем более в определённых [44] условиях [45] людям приятнее комфортная ложь, чем горькая правда. То есть человек словно заранее запрограммирован на то, чтобы быть обманутым.

Есть методы, как обучить ИИ обману [46], а в даркнете продаются нелегальные версии LLM, обученные конкретно на создание вредоносного кода [47] (FraudGPT, WormGPT и др.). Поэтому вопрос доверия ИИ остаётся открытым.

© 2024 ООО «МТ ФИНАНС»

Автор: alizar

Источник [48]

Сайт-источник PVSM.RU: https://www.pvsm.ru

Путь до страницы источника: https://www.pvsm.ru/ibm/405945

Ссылки в тексте:

[1] Image: https://habr.com/ru/companies/ruvds/articles/867316/

[2] IBM z16: https://www.ibm.com/products/z16

[3] источник: https://www.wsj.com/articles/mainframes-find-new-life-in-ai-era-1e32b951

[4] будет обучаться на наших секретах: https://simonwillison.net/2023/Dec/14/ai-trust-crisis/

[5] самохостинг GPU: https://www.gumlet.com/blog/time-to-own-gpus/

[6] удвоилось по сравнению с 2022 годом: https://www.census.gov/construction/c30/historical_data.html

[7] новые облака, специально для ИИ-вычислений: https://www.semianalysis.com/p/ai-neocloud-playbook-and-anatomy

[8] хостинге: https://www.reg.ru/?rlink=reflink-717

[9] Gumlet: https://www.gumlet.com/

[10] Многие: https://tech.ahrefs.com/how-ahrefs-saved-us-400m-in-3-years-by-not-going-to-the-cloud-8939dd930af8

[11] другие: https://world.hey.com/dhh/why-we-re-leaving-the-cloud-654b47e0

[12] одна миллисекунда разницы во времени покупки или продажи на бирже отличает прибыль от убытка: https://habr.com/ru/articles/183484/

[13] скорость света имеет значение: https://www.wsj.com/articles/high-frequency-traders-push-closer-to-light-speed-with-cutting-edge-cables-11608028200

[14] статистике IDC: https://www.wsj.com/articles/pro-take-the-cloud-isnt-the-answer-to-all-it-problemsat-least-for-now-2af43219

[15] Telum II: https://www.ibm.com/blog/announcement/telum-ii/

[16] habrastorage.org/webt/xu/wg/6a/xuwg6aifjxor4wczod6hwzq8hfo.png: https://habrastorage.org/webt/xu/wg/6a/xuwg6aifjxor4wczod6hwzq8hfo.png

[17] патенту IBM: https://trea.com/information/lateral-persistence-directory-states/patentapplication/d5bbb189-7bfe-48fc-98e6-04461950f4fe

[18] поможет клиенту переписать кодовую базу с Cobol на Java: https://www.wsj.com/articles/can-ai-solve-legacy-tech-problems-companies-are-putting-it-to-the-test-36d9c490?mod=article_inline

[19] локальные облачные серверы 0xide: https://habr.com/ru/companies/ruvds/articles/783782/

[20] Mount Diablo: https://techcommunity.microsoft.com/blog/azureinfrastructureblog/mt-diablo---disaggregated-power-fueling-the-next-wave-of-ai-platforms/4268799

[21] интерьер в виде серверных стоек: https://futurerack.info/main.php

[22] модульную систему полок: https://www.vitsoe.com/us/606

[23] LackRack: https://web.archive.org/web/20220121090117/https://wiki.eth0.nl/index.php/LackRack

[24] AnythingLLM: https://github.com/Mintplex-Labs/anything-llm

[25] llamafile: https://github.com/Mozilla-Ocho/llamafile

[26] Ollama: https://ollama.com/

[27] GPT4All: https://github.com/nomic-ai/gpt4all

[28] макбуке с 64 ГБ оперативной памяти: https://simonwillison.net/2024/Dec/9/llama-33-70b/

[29] Llama 3.3 70B: https://huggingface.co/meta-llama/Llama-3.3-70B-Instruct

[30] запускаются на ноутбуках: https://www.nature.com/articles/d41586-024-02998-y

[31] Twinny: https://github.com/twinnydotdev/twinny

[32] Khoj,: https://github.com/khoj-ai/khoj

[33] LocalAI,: https://github.com/mudler/LocalAI

[34] llama.cpp,: https://github.com/ggerganov/llama.cpp

[35] /r/LocalLLaMA/.: https://old.reddit.com/r/LocalLLaMA/

[36] вопрос доверия ИИ: https://www.belfercenter.org/publication/ai-and-trust

[37] анализ ИИ-девушек с точки зрения безопасности: https://gizmodo.com/your-ai-girlfriend-is-a-data-harvesting-horror-show-1851253284

[38] саботажа программного кода со стороны ИИ-помощников: https://www.theregister.com/2024/01/16/poisoned_ai_models

[39] врёт убедительнее человека: https://www.schneier.com/blog/archives/2023/08/the-need-for-trustworthy-ai.html

[40] упал до минимального уровня: https://www.brookings.edu/articles/how-americans-confidence-in-technology-firms-has-dropped-evidence-from-the-second-wave-of-the-american-institutional-confidence-poll/

[41] стали нормой: https://www.wired.com/story/generative-ai-deepfakes-disinformation-psychology/

[42] открывает возможности для массовой слежки: https://www.schneier.com/blog/archives/2023/12/the-internet-enabled-mass-surveillance-ai-will-enable-mass-spying.html

[43] интересные эффекты: https://www.biorxiv.org/content/10.1101/2023.12.01.569449v1

[44] определённых: https://en.wikipedia.org/wiki/Choice-supportive_bias

[45] условиях: https://en.wikipedia.org/wiki/Confirmation_bias

[46] обучить ИИ обману: https://arxiv.org/abs/2401.05566v3

[47] обученные конкретно на создание вредоносного кода: https://netenrich.com/blog/fraudgpt-the-villain-avatar-of-chatgpt

[48] Источник: https://habr.com/ru/companies/ruvds/articles/867316/?utm_campaign=867316&utm_source=habrahabr&utm_medium=rss

Нажмите здесь для печати.