Исследователи используют идеи теории игр, чтобы улучшить большие языковые модели и сделать их более последовательными.

Исследователи используют идеи теории игр, чтобы улучшить большие языковые модели и сделать их более последовательными.

Для того, чтобы распознавать естественную человеческую речь, используют специальные модели — языковые. Они умеют воспринимать содержание текста, продолжать предложения и вести осмысленный диалог.

Вместе с дата-сайентистом и биоинформатиком Марией Дьяковой подготовили подробный гайд о том, как устроены самые популярные языковые модели и что нужно знать, чтобы начать с ними работать.

«Я тебя завалю, если ещё раз упомянешь AI», — писал автор нашумевшей статьи. В самом деле, хайп вокруг ИИ всем надоел. Но мы всё-таки рискнём поговорить о том, какую LLM поставить на своём сервере и зачем.

Сразу упомянем, что на серверах RUVDS установлены видеокарты NVIDIA Quadro P4000 (на фото). Карты довольно слабенькие, так что подойдут скорее для проектов в образовательных целях и т. д. Тем более что под VPS выделяется максимум 1 ГБ видеопамяти. Но даже в таких спартанских условиях можно запустить LLM.

Кстати, о VPS с видеокартой. Несколько лет назад мы уже писали о сферах их применения и даже проводили тесты. Всё это можно найти здесь.Читать полностью »

Сегодня мы выкладываем в опенсорс наш новый инструмент — алгоритм YaFSDP, который помогает существенно ускорить процесс обучения больших языковых моделей.

В этой статье мы расскажем о том, как можно организовать обучение больших языковых моделей на кластере и какие проблемы при этом возникают. Рассмотрим альтернативные методы ZeRo и FSDP, которые помогают организовать этот процесс. И объясним, чем YaFSDP отличается от них.

ИИ чат‑боты любят ловить глюки и выдавать всякую чушь. Так массово, что словом 2023 года признали «галлюцинировать». В чем причина такого явления? Является ли генеративный ИИ интеллектом (спойлер — и да, и нет)? И что общего у ChatGPT и копировального аппарата Xerox? Разбираемся, осмысляя базовую логику работы языковых моделей.

Кебриджский словарь признал Читать полностью »

Не так давно мы рассказывали про то, как обучили модель-полиглот mGPT, которая говорит на 61 языке. Этим летом мы выложили большую мультиязычную модель (претрейн) mGPT-13B под открытой лицензией MIT.

Основная задача любой мобильной клавиатуры — помогать пользователям в общении, а именно — вводить текст быстро и без ошибок. Этого можно достичь при помощи разных компонентов: подсказок, автокорректа, тап-модели, голосового ввода, ввода Читать полностью »

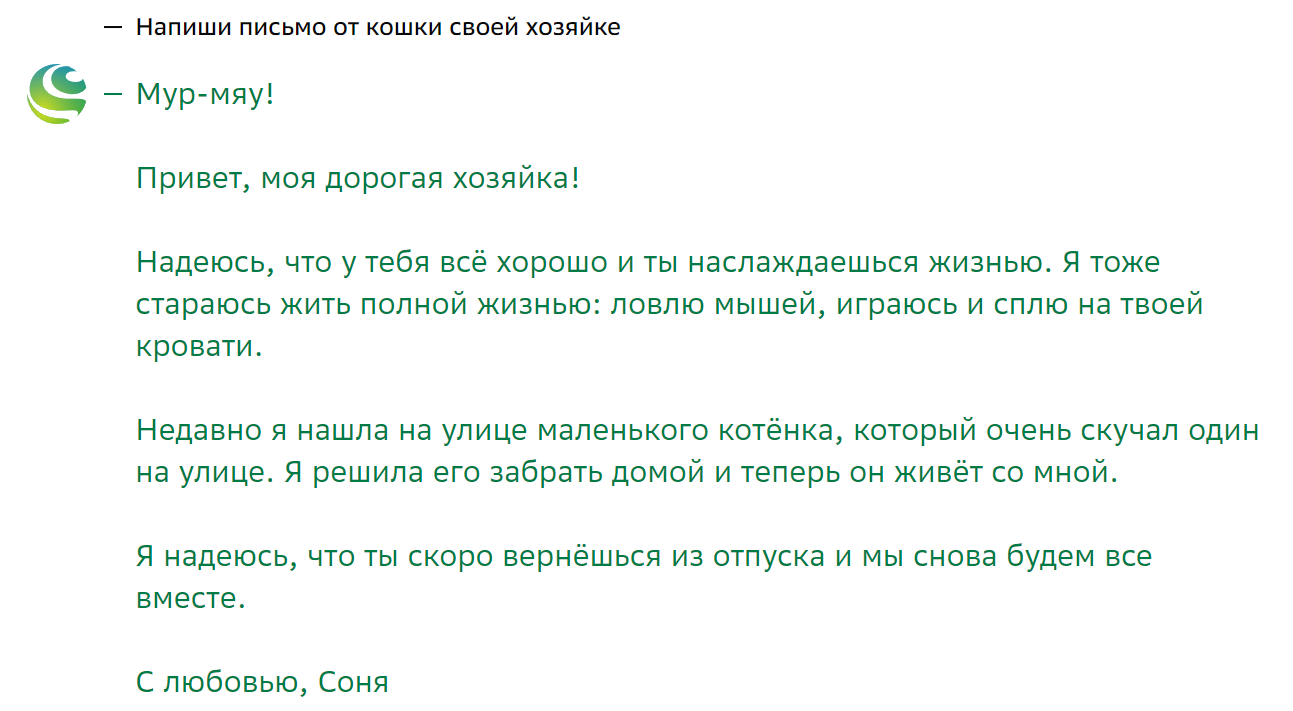

Друзья, свершилось. Сегодня мы рады сообщить вам о релизе в открытый доступ нейросетевой модели, которая лежит в основе сервиса GigaChat.

Про то, что такое GigaChat и как мы его обучаем, вы можете прочитать в нашей предыдущей статьеЧитать полностью »

RuGPT3 - коллекция генеративных моделей от Сбер

Проводим автоматическое тестирование циклическим перебором вариантов

Работаем в Colab, тестируем Small, Mediub, Large.

Параметры генерации совершенно неоптимизированы - это первый заход, чтобы посмотреть исходную ситуацию и сравнивать по мере улучшения.

Читать полностью »

Участники открытого сообщества LAION-AI выпустили в открытый доступ первые обученные модели OA_SFT_Llama_30B и OA_SFT_Llama_13B. и запустили ИИ-чатбот OpenAssistantЧитать полностью »