Рубрика «синтез речи»

Делаем быстрый, качественный и доступный синтез на языках России — нужно ваше участие

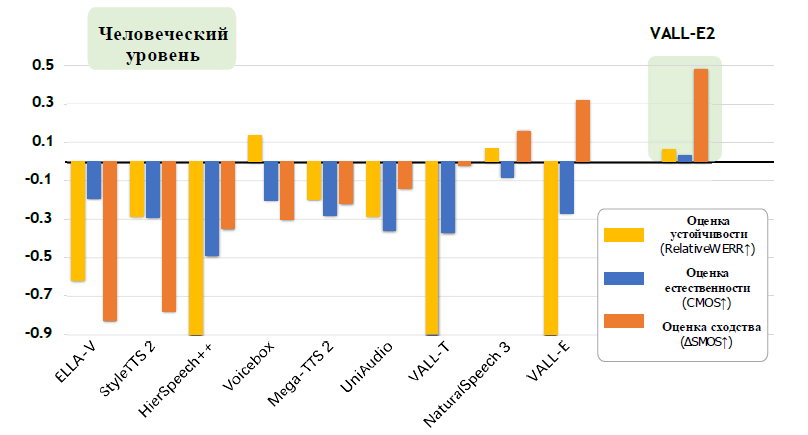

2025-01-09 в 11:46, admin, рубрики: TTS, азербайджанский язык, белорусский язык, казахский язык, русский язык, синтез речи, таджикский язык, татарский язык, узбекский язык, украинский языкVALL-E 2: Нейронные кодировочные языковые модели являются синтезаторами речи с человеческим уровнем в zero-shot

2024-12-06 в 11:15, admin, рубрики: nlp, TTS, обработка естественного языка, синтез речи

Введение

VALL-E 2, последнее достижение в области нейронных кодировочных языковых моделей, которое стало вехой в синтезе речи в zero-shot, достигнув человеческого уровня впервые. Zero-shotЧитать полностью »

Создаём генератор аудиокниг с персональным переводом

2024-12-02 в 8:15, admin, рубрики: nlp, python, timeweb_статьи, аудиокнига, аудиокниги, изучение английского, изучение иностранных языков, изучение языков, синтез речи

Привет!

Изучая четвёртый язык, я в очередной раз решил попробовать обучить свою биологическую нейросеть на книгах с параллельным переводом, но после пары вечеров в такой же очередной раз их оставил. Подобный подход, когда переводом сопровождается каждое предложение, кажется несколько избыточным и мешающим погружению, и если в текстовом варианте можно хотя бы перескочить взглядом через перевод, то для прочих форматов, например, для любимых мною аудиокниг, этот подход не сработает в принципе. Самый популярный вариант «обучающего перевода», которым пользовались и вы, – интерактивный, в котором пользователь следит за текстом на языке оригинала, и сам раскрывает переводы и пояснения забытых или новых для себя слов. Можно ли совместить эти подходы, взяв преимущества каждого, и переложить их в формат аудиокниги? Этим сегодня и займёмся.

Читать полностью »

Suno как аранжировщик etc.

2024-10-12 в 7:53, admin, рубрики: suno ai, аранжировка музыки, вирартек, генерация музыки, синтез речиДоброго времени всем пользователям Suno и тем, кто интересуется технологиями ИИ в музыке. Как и ранее не претендую на полноту освещения вопроса, но надеюсь, что информация будет полезной.

Под аранжировкой обычно понимают создание инструментального трека (минусовки, backing track) на основе мелодии или мелодии + гармонии, с определенным стилем, темпом, формой/структурой. Suno генерирует песни (и инструментал) целиком с задаваемыми (относительно) стилем и формой. Показалось интересным протестировать систему на возможность создания нужной аранжировки. Особенно после своих экспериментов с Audio Input (см. Читать полностью »

Особенности фонетики якутского языка для синтеза речи

2024-08-20 в 16:44, admin, рубрики: TTS, русский язык, синтез речи, якутский язык

Недавно мы закончили проект по синтезу якутского языка. Хотя наши договорённости не позволяют выложить нам модели в общий доступ, какими-то соображениями на тему того, как можно делать синтез якутского языка мы поделиться можем.

Под котом катом вы узнаете:

-

Как звучит синтез на якутском языке;

Как Яндекс создал технологию эмоционального синтеза в Алисе

2024-08-20 в 8:00, admin, рубрики: алиса, генеративные модели, машинное обучение, синтез речи, Эмоции, яндекс

Уже скоро Алисе исполнится семь лет. К семи годам у людей уже формируется эмпатия: мы начинаем понимать чувства окружающих и осознаем, что эти чувства отражают внутреннее состояние собеседника.

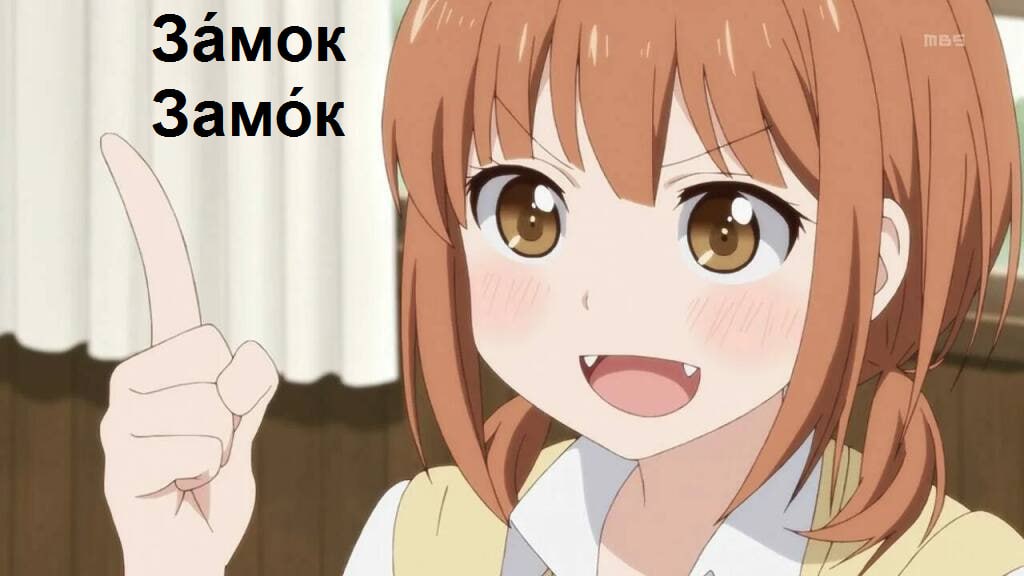

Проблема омографов в ударениях и как я ее решал

2023-10-15 в 13:54, admin, рубрики: TTS, омографы, расстановка ударений, синтез речи, фонетика

Меня зовут Денис (tg: @chckdskeasfsd), и это история о том, почему в опенсурсе нет TTS с нормальными ударениями, и как я пытался это исправить.

Обзор проблемы

5 классных сервисов на основе ИИ (с примерами)

2023-03-09 в 5:30, admin, рубрики: AI, Блог компании RUVDS.com, искусственный интеллект, машинное обучение, облачные сервисы, обработка изображений, подборка сервисов, подборки, Программирование, сервисы, синтез речиЗа последний год появилось огромное число новых сервисов, которые работают на нейронных сетях. Кажется, что уже не осталось людей, кто бы не слышал о том, что chatGPT пишет новости, а Midjorney во всю создает шедевры.

Сегодня я бы хотел показать 5 сервисов на основе нейронных сетей, которые не связаны с chatGPT, Midjorney или Stable Diffusion. Эти сервисы помогают обрабатывать аудио, преобразовывать текст в речь и удалять ненужные вещи с картинок.

Cleanvoice

Теперь наш синтез на 20 языках

2022-06-06 в 17:35, admin, рубрики: diy или сделай сам, natural language processing, text-to-speech, TTS, голосовые интерфейсы, звук, машинное обучение, синтез речи

В нашей прошлой статье мы ускорили наши модели в 10 раз, добавили новые высококачественные голоса и управление с помощью SSML, возможность генерировать аудио с разной частотой дискретизации и много других фишек.

В этот раз мы добавили:

- 1 высококачественный голос на русском языке (

eugeny); - Синтез на 20 языках, 174 голоса;

- В список языков входят 5 языков народов СНГ: калмыцкий, русский, татарский, узбекский и украинский;

- В список языков входят 5 вариаций на тему романо-германских языков: английский, индийский английский, испанский, немецкий, французский;

- Также в список языков входят 10 языков народов Индии;

- Новую значительно улучшенную модель для простановки ударений и буквы

ёсо словарем в 4 миллиона слов и точностью 100% (но естественно с рядом оговорок); - Все модели наследуют все "фишки" прошлого релиза, кроме автоматической простановки ударений для языков отличных от русского;

Пока улучшение интерфейсов мы отложили на некоторое время. Ускорить модели еще в 3+ раза мы тоже смогли, но пока с потерей качества, что не позволило нам обновить их прямо в этом релизе.

Попробовать модель как обычно можно в нашем репозитории и в колабе.

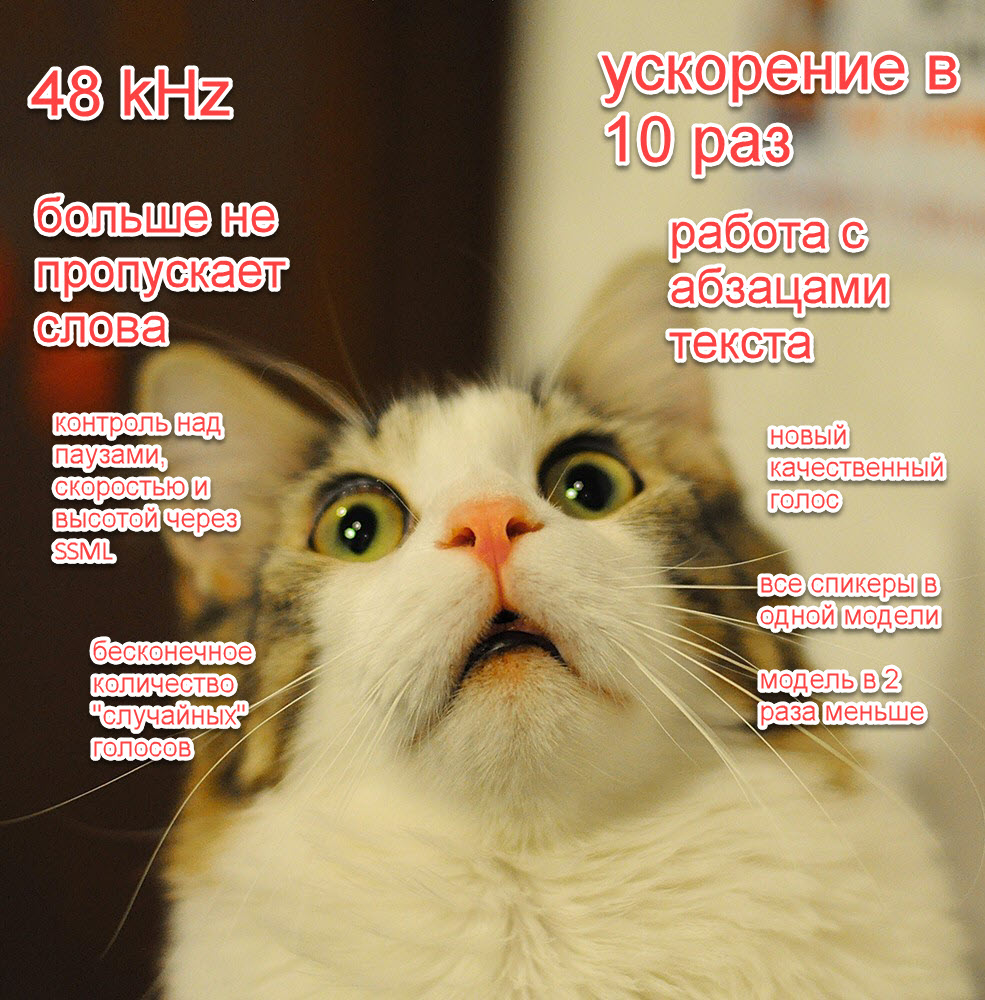

Теперь наш публичный синтез в супер-высоком качестве, в 10 раз быстрее и без детских болячек

2022-04-12 в 17:58, admin, рубрики: diy или сделай сам, natural language processing, text-to-speech, TTS, голосовые интерфейсы, звук, машинное обучение, синтез речи

В нашей прошлой статье про синтез речи мы дали много обещаний: убрать детские болячки, радикально ускорить синтез еще в 10 раз, добавить новые "фишечки", радикально улучшить качество.

Сейчас, вложив огромное количество работы, мы наконец готовы поделиться с сообществом своими успехами:

- Снизили размер модели в 2 раза;

- Научили наши модели делать паузы;

- Добавили один высококачественный голос (и бесконечное число случайных);

- Ускорили наши модели где-то примерно в 10 раз (!);

- Упаковали всех спикеров одного языка в одну модель;

- Наши модели теперь могут принимать на вход даже целые абзацы текста;

- Добавили функции контроля скорости и высоты речи через SSML;

- Наш синтез работает сразу в трех частотах дискретизации на выбор — 8, 24 и 48 килогерц;

- Решили детские проблемы наших моделей: нестабильность и пропуск слов, и добавили флаги для контроля ударения;

Это по-настоящему уникальное и прорывное достижение и мы не собираемся останавливаться. В ближайшее время мы добавим большое количество моделей на разных языках и напишем целый ряд публикаций на эту и смежные темы, а также продолжим делать наши модели лучше (например, еще в 2-5 раз быстрее).

Попробовать модель как обычно можно в нашем репозитории и в колабе.