Продолжение цикла публикаций статей про прогнозирование временных рядов. На повестке – перевод статьи How to Develop Multi-Step LSTM Time Series Forecasting Models for Power Usage.

Читать полностью »

Рубрика «рекуррентная нейронная сеть»

Интервальное прогнозирование временных рядов с помощью рекуррентных нейронных сетей с долгой краткосрочной памятью…

2020-06-06 в 15:56, admin, рубрики: keras, LSTM, python, time-series forecasting, машинное обучение, прогнозирование временных рядов, рекуррентная нейронная сетьРекуррентные нейронные сети (RNN) с Keras

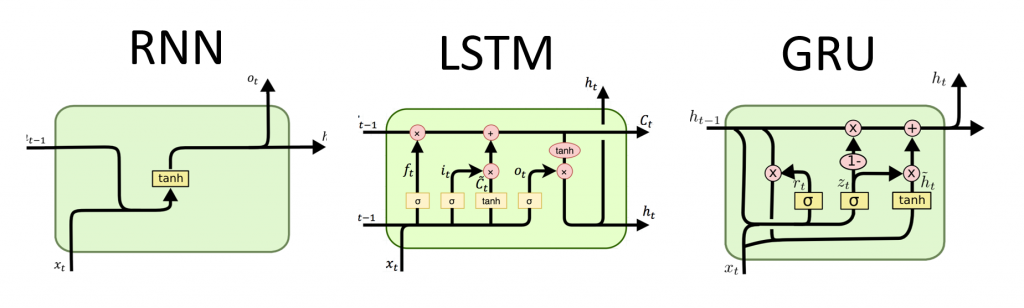

2020-02-11 в 17:07, admin, рубрики: big data, keras, LSTM, python, TensorFlow, искусственный интеллект, машинное обучение, рекуррентная нейронная сетьПеревод руководства по рекуррентным нейросетям с сайта Tensorflow.org. В материале рассматриваются как встроенные возможности Keras/Tensorflow 2.0 по быстрому построению сеток, так и возможности кастомизации слоев и ячеек. Также рассматриваются случаи и ограничения использования ядра CuDNN позволяющего ускорить процесс обучения нейросети.

Kaggle: не можем ходить — будем бегать

2019-03-06 в 5:22, admin, рубрики: cnn, data mining, gru, kaggle, keras, LightGBM, LSTM, machine learning, RNN, scikit-learn, Блог компании Singularis, искусственный интеллект, машинное обучение, рекуррентная нейронная сеть, финансы в ITНасколько сложна тема машинного обучения? Если Вы неплохо математически подкованы, но объем знаний о машинном обучении стремится к нулю, как далеко Вы сможете зайти в серьезном конкурсе на платформе Kaggle?

Применение рекуррентных слоев для решения многоходовок

2018-04-25 в 13:11, admin, рубрики: Gamedev, python, Q-learning, recurrent neural network, TensorFlow, машинное обучение, рекуррентная нейронная сеть

История

Рекуррентные слои были изобретены еще в 80х Джоном Хопфилдом. Они легли в основу разработанных им искусственных ассоциативных нейронных сетей (сетей Хопфилда). Сегодня рекуррентные сети получили большое распространение в задачах обработки последовательностей: естественных языков, речи, музыки, видеоряда и тд.

Задача

В рамках задачи по Hierarchy reinforcement learning я решил прогнозировать не одно действие агента, а несколько, используя для этого уже пред обученную сеть способную предсказать последовательность действий. В данной статье я покажу как реализовать “sequence to sequence” алгоритм для обучения этой самой сети а в последующей, постараюсь рассказать, как использовать ее в Q-learning обучении.

Читать полностью »

Как научить свою нейросеть анализировать морфологию

2017-10-12 в 11:00, admin, рубрики: natural language processing, nlp, python, глубокое обучение, Компьютерная лингвистика, машинное обучение, морфологический анализ, морфология, рекуррентная нейронная сетьНедавно мы рассказывали про генератор стихов. Одной из особенностей языковой модели, лежащей в его основе, было использование морфологической разметки для получения лучшей согласованности между словами. Однако же у использованной морфоразметки был один фатальный недостаток: она была получена с помощью “закрытой” модели, недоступной для общего использования. Если точнее, выборка, на которой мы обучались, была размечена моделью, созданной для Диалога-2017 и основанной на закрытых технологиях и словарях ABBYY.

Мне очень хотелось избавить генератор от подобных ограничений. Для этого нужно было построить собственный морфологический анализатор. Сначала я делал его частью генератора, но в итоге он вылился в отдельный проект, который, очевидно, может быть использован не только для генерации стихов.

Вместо морфологического движка ABBYY я использовал широко известный pymorphy2. Что в итоге получилось? Спойлер — получилось неплохо.

Открытые проблемы в области распознавания речи. Лекция в Яндексе

2017-09-10 в 15:57, admin, рубрики: wer, Алгоритмы, Блог компании Яндекс, машинное обучение, нейронные сети, нерешенные задачи, распознавание речи, рекуррентная нейронная сеть, речевые технологии, фреймыРабота большинства специалистов по речевым технологиям состоит не в том, чтобы придумывать концептуально новые алгоритмы. Компании в основном фокусируются на существующих подходах. Машинный интеллект уже умеет распознавать и синтезировать голос, но не всегда в реальном времени, не всегда локально и не всегда «избирательно» — когда нужно реагировать только на ключевые фразы, робот может ошибаться. Подобными проблемами как раз и заняты разработчики. Муаммар Аль-Шедиват @Laytlas рассказывает об этих и других вопросах, которые пока не удаётся решить даже большим компаниям.

Neural conversational models: как научить нейронную сеть светской беседе. Лекция в Яндексе

2017-07-22 в 13:48, admin, рубрики: conversation, deep learning, ассистент, Блог компании Яндекс, диалоговые системы, естественный язык, машинное обучение, нейронные сети, рекуррентная нейронная сетьХороший виртуальный ассистент должен не только решать задачи пользователя, но и разумно отвечать на вопрос «Как дела?». Реплик без явной цели очень много, и заготовить ответ на каждую проблематично. Neural Conversational Models — сравнительно новый способ создания диалоговых систем для свободного общения. Его основа — сети, обученные на больших корпусах диалогов из интернета. Борис hr0nix Янгель рассказывает, чем хороши такие модели и как их нужно строить.

Под катом — расшифровка и основная часть слайдов.

Эксперименты с malloc и нейронными сетями

2017-05-26 в 9:02, admin, рубрики: gru, heap, LSTM, malloc, python, Алгоритмы, Блог компании Mail.Ru Group, куча, машинное обучение, нейронные сети, рекуррентная нейронная сеть, системное программирование

Больше года назад, когда я работал антиспамщиком в Mail.Ru Group, на меня накатило, и я написал про эксперименты с malloc. В то время я в свое удовольствие помогал проводить семинары по АКОСу на ФИВТе МФТИ, и шла тема про аллокацию памяти. Тема большая и очень интересная, при этом охватывает как низкий уровень ядра, так и вполне себе алгоритмоемкие структуры. Во всех учебниках написано, что одна из основных проблем динамического распределения памяти — это ее непредсказуемость. Как говорится, знал бы прикуп — жил бы в Сочи. Если бы оракул заранее рассказал весь план по которому будет выделяться и освобождаться память, то можно было составить оптимальную стратегию, минимизирующую фрагментацию кучи, пиковое потребление памяти и т.д. Отсюда пошла возня с ручными аллокаторами. В процессе раздумий я натолкнулся на отсутствие инструментов логирования malloc() и free(). Пришлось их написать! Как раз про это была статья (а ещe я изучал macOS). Были запланированы две части, однако жизнь круто повернулась и стало не до malloc(). Итак, пора восстановить справедливость и реализовать обещанное: ударить глубоким обучением по предсказанию работы с кучей.

Внутри:

- Совершенствуем

libtracemalloc, перехватчикmalloc(). - Строим LSTM на Keras — глубокую рекуррентную сеть.

- Обучаем модель на примере работы реального приложения (vcmi/vcmi — а вы думали, причем здесь Heroes III?).

- Удивляемся неожиданно хорошим результатам.

- Фантазируем про практическое применение технологии.

- Исходники.

Интересно? Добро пожаловать под кат.

Эвристическая сеть — аналог рекуррентной нейронной сети для программы чат бот

2017-02-21 в 14:50, admin, рубрики: Алгоритмы, математика, машинное обучение, рекуррентная нейронная сеть, эвристическая сеть, метки: chat bot, рекуррентная нейронная сеть, эвристическая сетьВ статье представлен алгоритм эвристической сети по некоторым свойствам аналогичный рекуррентной нейронной сети для программы виртуального собеседника. Алгоритм усовершенствован с использованием толкового словаря русского языка. В эвристическую сеть внедрен генератор новых ответов на базе статистической информации базы знаний.

Читать полностью »