В данной статье осуществлен разбор многопользовательского телеграм чат бота на LLM, код которого опубликован в этом репозитории

Куда движется рынок

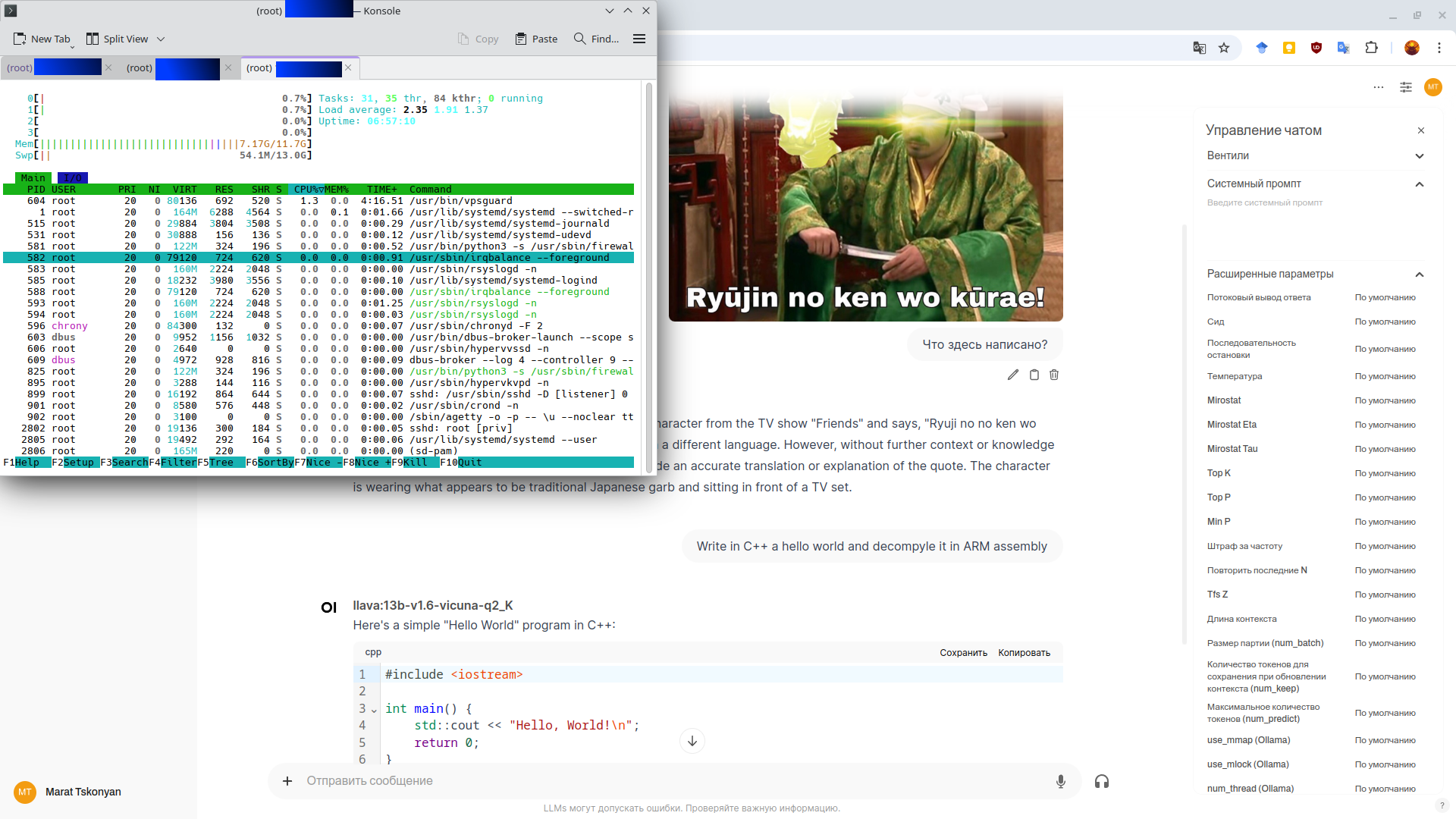

Когда-то давным давно графический пользовательский интерфейс сменил консольный ввод. Казалось бы, проблему неудобства взаимодействия для неподготовленного пользователя мог бы решить псевдографический интерфейс, но есть фактор, который не все замечают