Во всем AI-мире сейчас говорят о новой китайской языковой модели DeepSeek и, конечно, наша команда развития AI не могла пройти мимо этой темы. Мы сравнили ответы новой модели на реальные запросы к нашей технической поддержке с ответами других популярных моделей. Что из этого получилось и какие выводы мы сделали расскажу я — Максим Михайлов, продуктовый менеджер Cloud.ru.

Рубрика «o1-mini»

Так ли хороша DeepSeek-R1, как о ней говорят

2025-02-17 в 10:52, admin, рубрики: deepseek, DeepSeek R1, gpt-4, llm-модели, o1-mini, OpenAI, qwen2.5-max, сравнениеНасколько нейросеть — хороший калькулятор?

2024-09-18 в 14:51, admin, рубрики: chatgpt, gpt, o1, o1-mini, o1-preview, OpenAIИсследованием поделился Yuntian Deng в Твиттере.

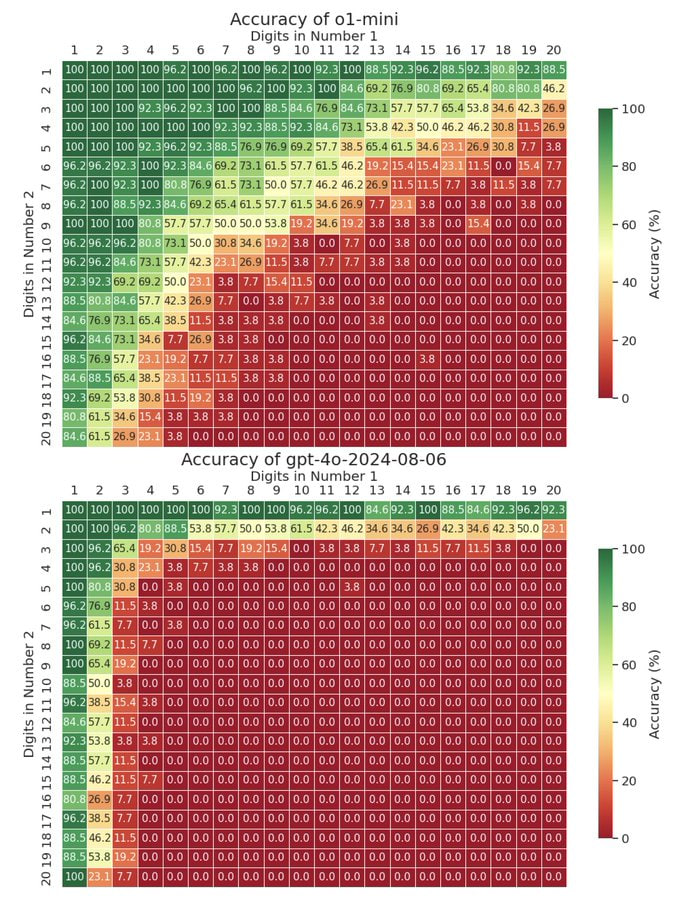

Он протестировал умножение чисел с разным количеством знаков, вплоть до 20.

На примере сравнения o1, o1-mini и gpt-4o.

Оказалось, что GPT4o еле вывозит 4-значные числа, а o1 справляется даже с 9x9.