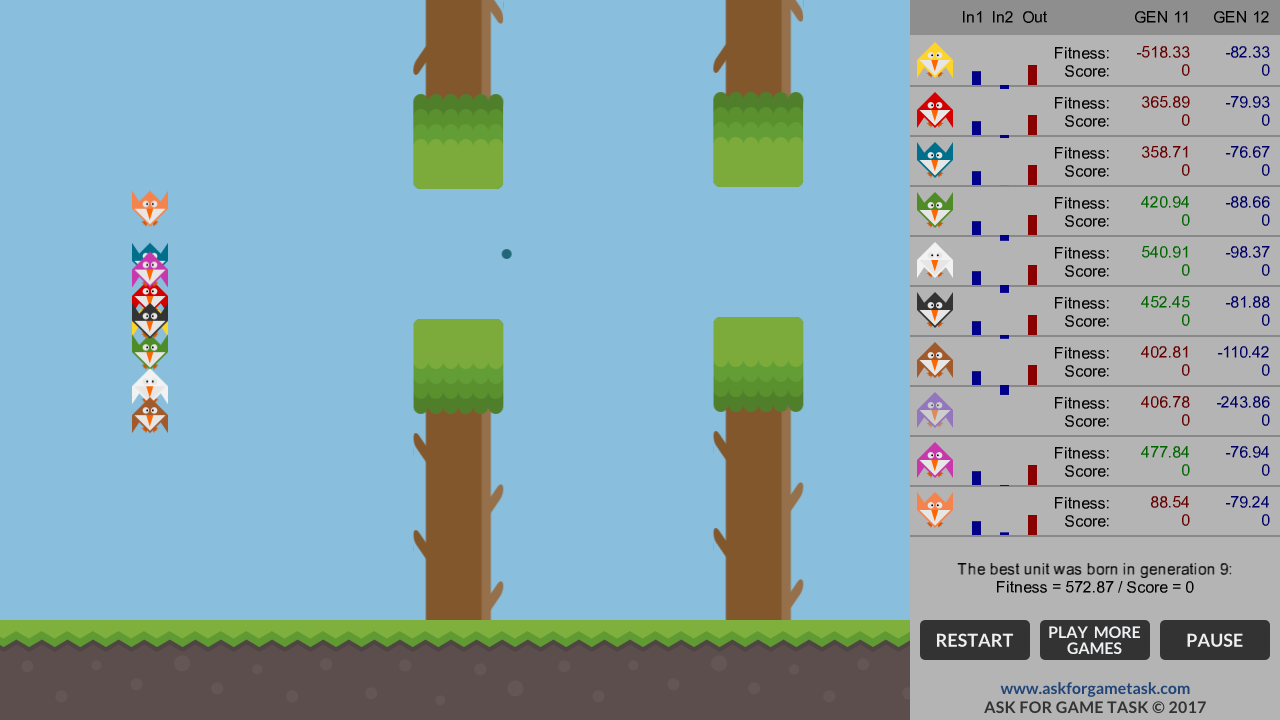

Мы часто слышим такие словесные конструкции, как «машинное обучение», «нейронные сети». Эти выражения уже плотно вошли в общественное сознание и чаще всего ассоциируются с распознаванием образов и речи, с генерацией человекоподобного текста. На самом деле алгоритмы машинного обучения могут решать множество различных типов задач, в том числе помогать малому бизнесу, интернет-изданию, да чему угодно. В этой статье я расскажу как создать нейросеть, которая способна решить реальную бизнес-задачу по созданию скоринговой модели. Мы рассмотрим все этапы: от подготовки данных до создания модели и оценки ее качества.

Вопросы, которые разобраны в статье:

• Как собрать и подготовить данные для построения модели?

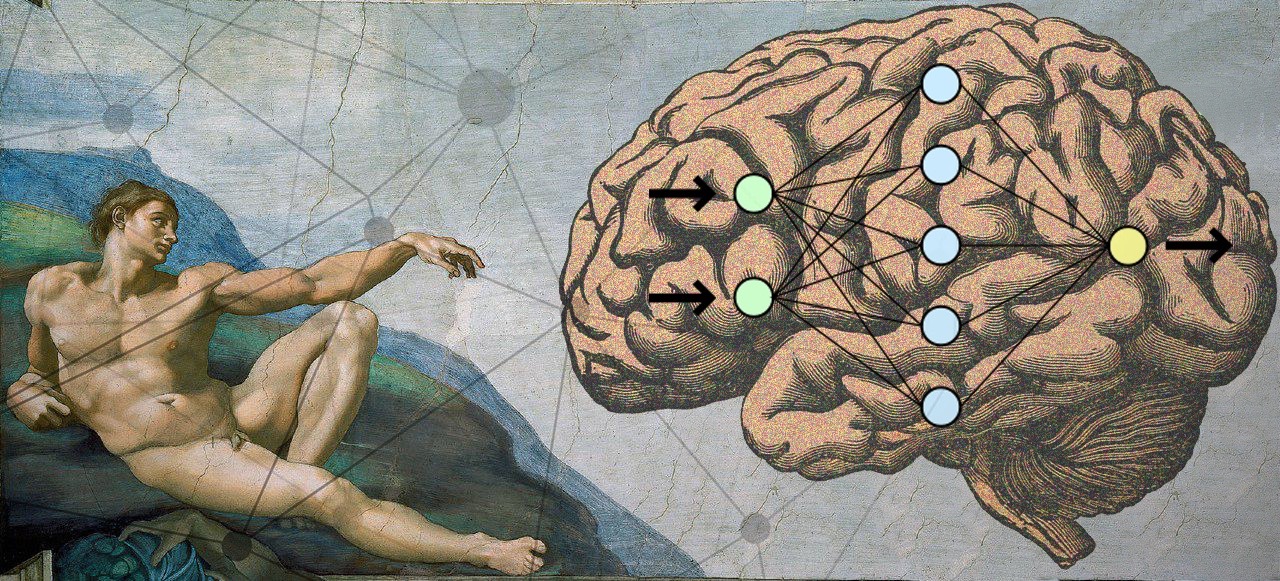

• Что такое нейронная сеть и как она устроена?

• Как написать свою нейронную сеть с нуля?

• Как правильно обучить нейронную сеть на имеющихся данных?

• Как интерпретировать модель и ее результаты?

• Как корректно оценить качество модели?

Читать полностью »