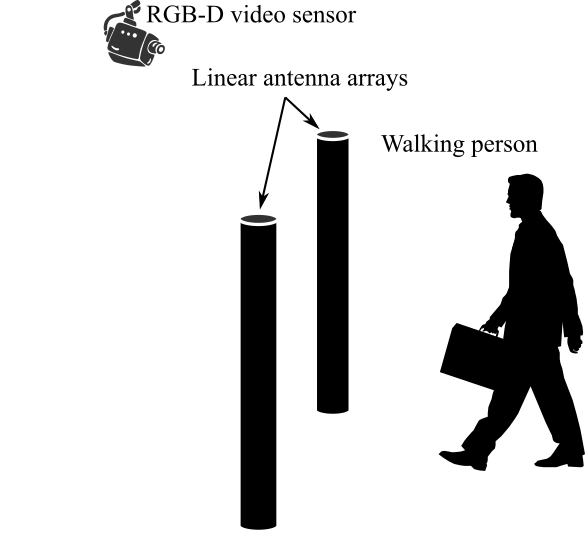

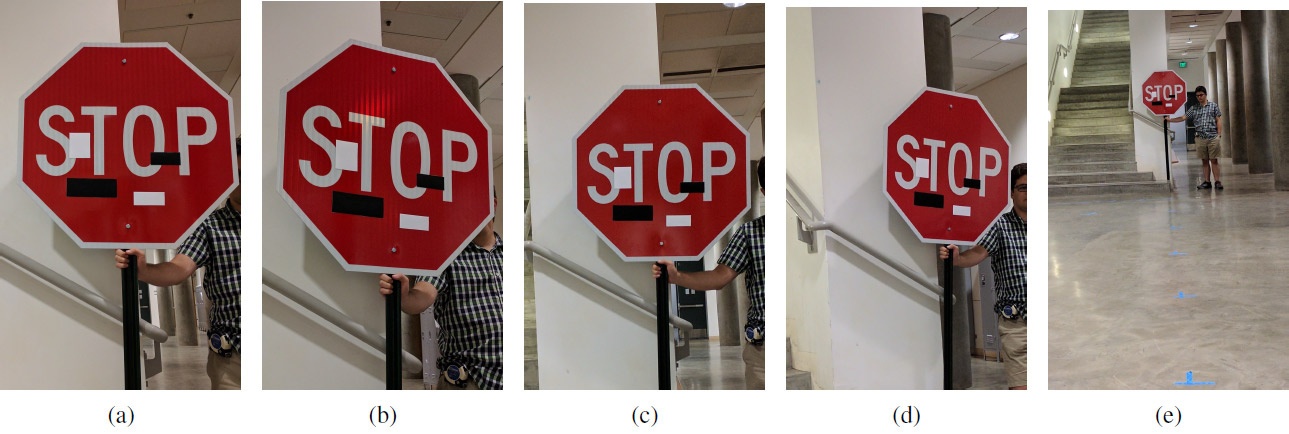

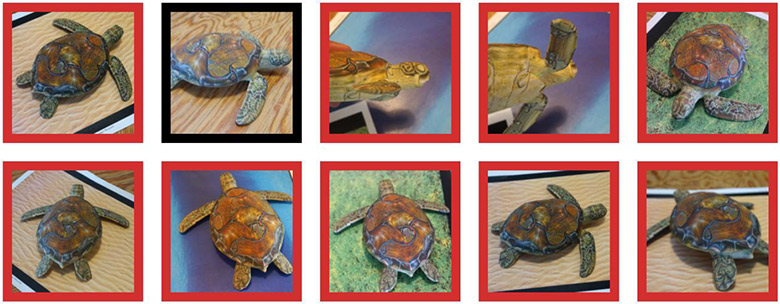

Напечатанная на 3D-принтере черепаха распознаётся нейросетью как черепаха (зеленый контур), винтовка (красный контур) или как другой объект (чёрный контур)

Давно известно, что небольшие целенаправленные изменения в картинке «ломают» систему машинного обучения, так что она классифицирует совершенно другое изображение. Такие «троянские» картинки называются «состязательными примерами» (adversarial examples) и представляют собой одно из известных ограничений глубинного обучения.

Работают они просто: нужно сделать градиентное восхождение в пространстве входных данных для генерации образцов, которые максимизируют предсказание класса для заданного класса. Например, если взять фотографию панды и добавить градиент «гиббон», мы заставим нейросеть классифицировать эту панду как гиббона. Черепаху можно выдать как винтовку (см. иллюстрацию вверху). Кот превращается в холодную закуску гуакамоле (см. под катом) — неважно. Любой объект превращается в любой другой для в глазах машинного интеллекта, потому что у ИИ особая система «зрения», отличная от человеческой.

Читать полностью »