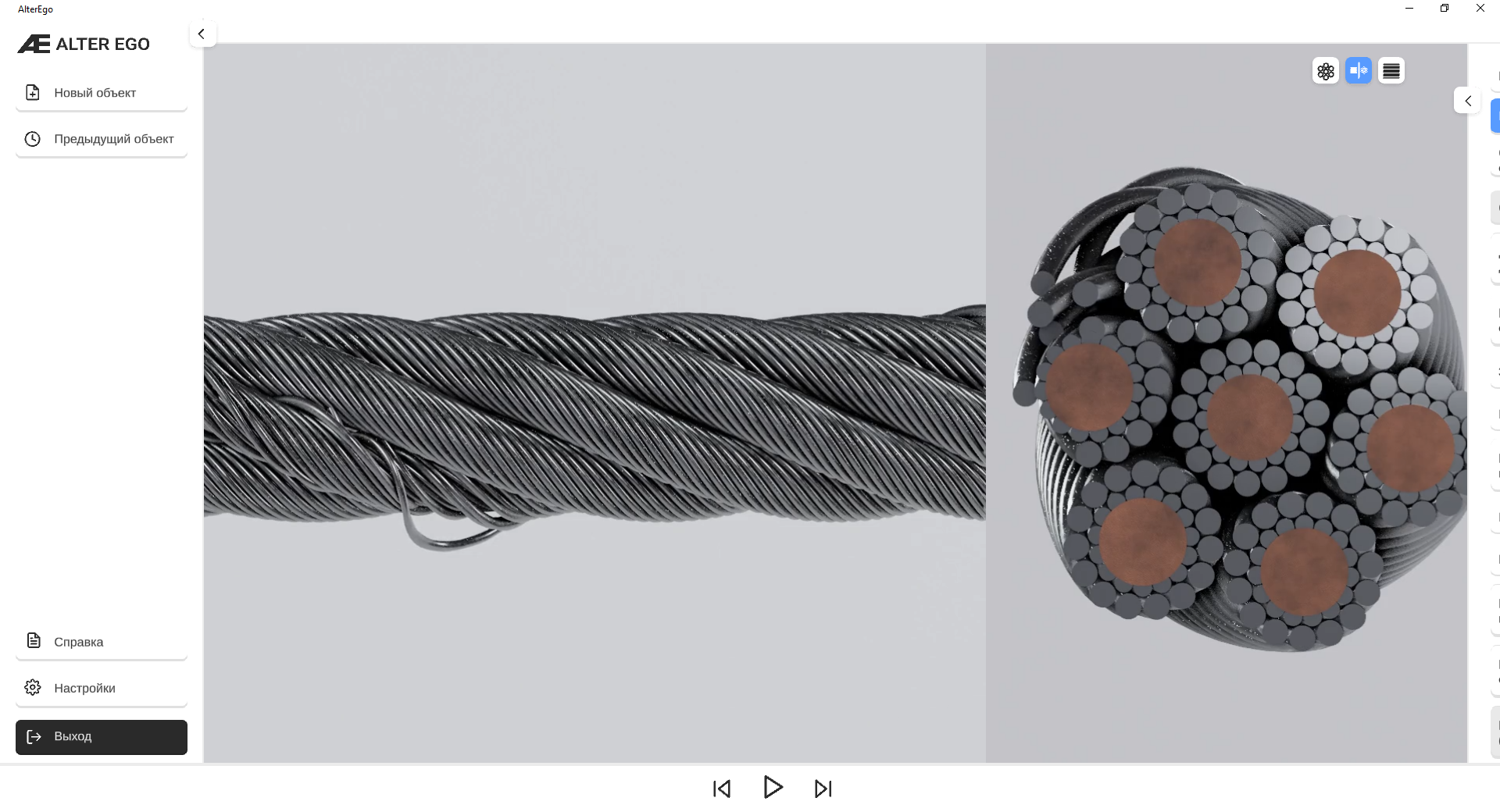

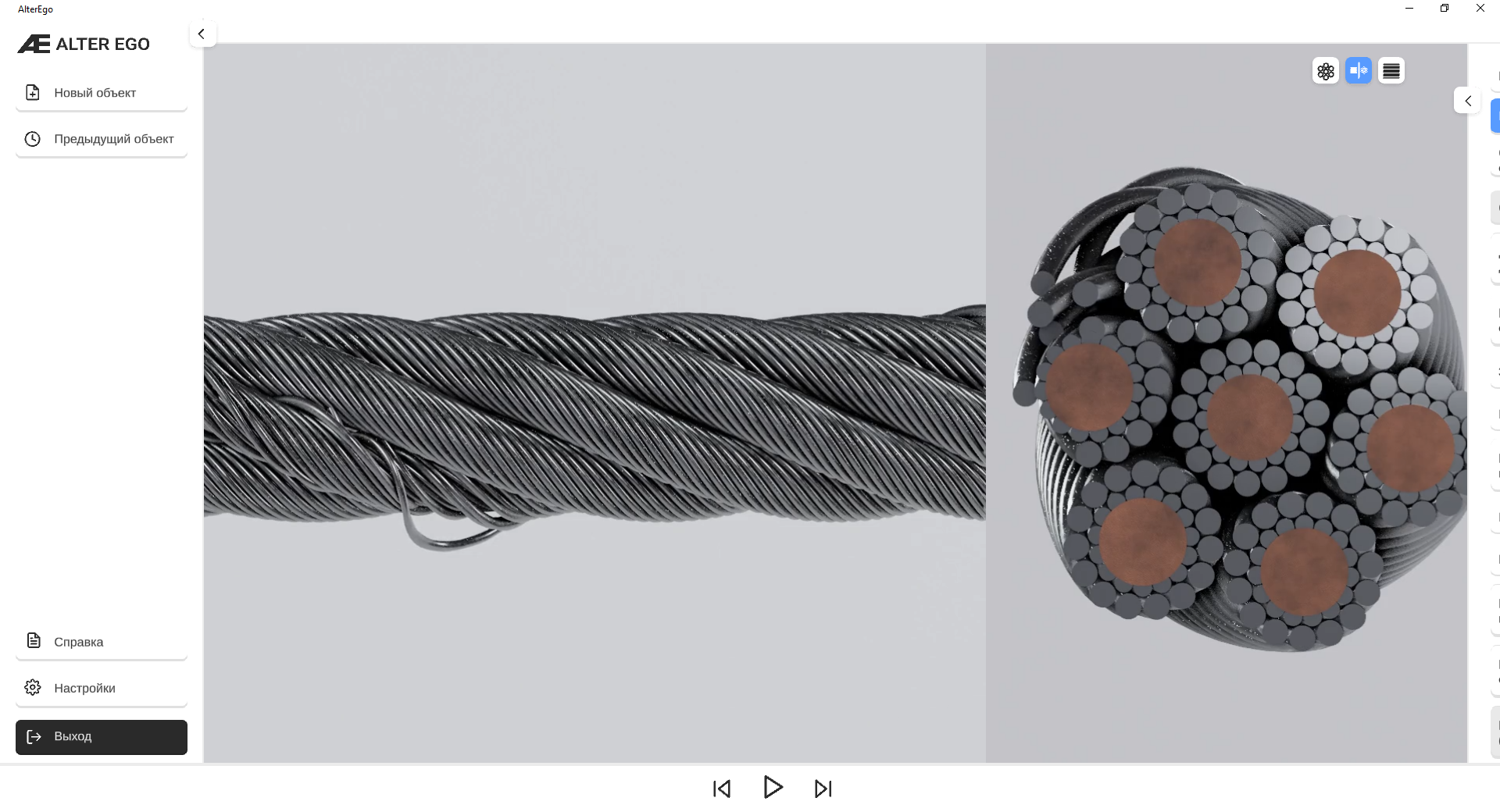

Вдохновились мы ребятами из PHYGITALISM и их статьей «Как мы заставляли нейронку пялиться на ржавчину», а тему подкинул заказчик. Мы – это компания Alter ЕgoЧитать полностью »

Вдохновились мы ребятами из PHYGITALISM и их статьей «Как мы заставляли нейронку пялиться на ржавчину», а тему подкинул заказчик. Мы – это компания Alter ЕgoЧитать полностью »

Эта статья представляет собой рассказ о том, как я узнала о существовании параллельной реальности под названием Университет Искусственного Интеллекта (УИИ), плавно переходящий в мини-расследование того, что же на самом деле скрывает за собой это название. В основном рассказ cкомпонован из серии постов в моем телеграм-канале, которые я написала в конце прошлого года под впечатлениями от данного интеллектуального путешествия, с небольшими дополнениями на основании новой полученной с тех пор информации.

Читать полностью »

Математика заключает в себе не только истину, но и высочайшую красоту – красоту холодную и строгую, подобную красоте скульптуры.

Бертран Рассел

Кто интересуется темой рисующих нейросетей знают, что сейчас самый продвинутый и часто используемый интерфейс для Stable Diffusion (далее SD) это Automatic1111. Он позволяет использовать, вероятно, все существующие возможности SD на сегодня. Множество расширений, регулярные обновления и поддержка сообщества делают его мощным и удобным инструментом для генерации изображений. Но есть и альтернативные решения, одно из которых я сегодня рассмотрю.

Большие языковые модели (Large Language Model, LLM) сейчас у всех на слуху. ОниЧитать полностью »

Сегодня не использовать ChatGPT просто глупо… Это действительно универсальный помощник, который сильно облегчает жизнь и выводит программирование на принципиально новый уровень. Одно из величайших изобретений в IT за десятилетия, после GUI и интернета.

Пожалуй, никогда программирование не было настолько приятным и эффективным, как сейчас.

Читать полностью »

Привет, меня зовут Артур Яковлев, я делаю голосовой перевод видео в Яндекс Браузере. Примерно с лета я работаю над тем, чтобы научить Браузер переводить с китайского на русский. Почему мы посчитали это важной и интересной задачей? Дело в том, что китайская часть интернета содержит значительное количество видеоконтента, который за пределами страны почти не смотрят.

Множество диалектов, влияющие на смысл тоны и грамматические нюансы — ряд особенностей китайского усложняют разработку распознавания речи. Сейчас я коротко расскажу читателям Хабра о трудностях языка и объясню, как мы их преодолели.

Читать полностью »

В конце марта 2023г., компания Databricks выпустила Dolly, большую языковую модель, подобную ChatGPT, дообученную на платформе Databricks Machine Learning Platform. Результат оценки работы модели Dolly показывает, что модель с открытым исходным кодом двухлетней давности (GPT-J) при дообучении на публичном датасетеЧитать полностью »

Пока нельзя сказать точно, являются ли современные нейросети тем самым искусственным интеллектом, которого ждало человечество — хотя тест Тьюринга они уже, похоже, способны преодолеть с лёгкостью. Но восторг и множественные стороны знакомства с ChatGPT, которые активно обсуждаются в медиа, профессиональных кругах и онлайн такие, словно человечество повстречало новую форму жизни.

Участники открытого сообщества LAION-AI выпустили в открытый доступ первые обученные модели OA_SFT_Llama_30B и OA_SFT_Llama_13B. и запустили ИИ-чатбот OpenAssistantЧитать полностью »