Насколько сложна тема машинного обучения? Если Вы неплохо математически подкованы, но объем знаний о машинном обучении стремится к нулю, как далеко Вы сможете зайти в серьезном конкурсе на платформе Kaggle?

Рубрика «LSTM» - 2

Kaggle: не можем ходить — будем бегать

2019-03-06 в 5:22, admin, рубрики: cnn, data mining, gru, kaggle, keras, LightGBM, LSTM, machine learning, RNN, scikit-learn, Блог компании Singularis, искусственный интеллект, машинное обучение, рекуррентная нейронная сеть, финансы в ITКак научить машину понимать инвойсы и извлекать из них данные

2019-02-19 в 12:44, admin, рубрики: ABBYY, data augmentation, LSTM, machine learning, ner, ocr, Блог компании ABBYY, высокая производительность, документы, извлечение данных, инвойсы, искусственный интеллект, машинное обучение, нейронные сети, технологии Привет! Меня зовут Станислав Семенов, я работаю над технологиями извлечения данных из документов в R&D ABBYY. В этой статье я расскажу об основных подходах к обработке полуструктурированных документов (инвойсы, кассовые чеки и т.д.), которые мы использовали совсем недавно и которые используем прямо сейчас. А еще мы поговорим о том, насколько для решения этой задачи применимы методы машинного обучения.

Привет! Меня зовут Станислав Семенов, я работаю над технологиями извлечения данных из документов в R&D ABBYY. В этой статье я расскажу об основных подходах к обработке полуструктурированных документов (инвойсы, кассовые чеки и т.д.), которые мы использовали совсем недавно и которые используем прямо сейчас. А еще мы поговорим о том, насколько для решения этой задачи применимы методы машинного обучения.

Читать полностью »

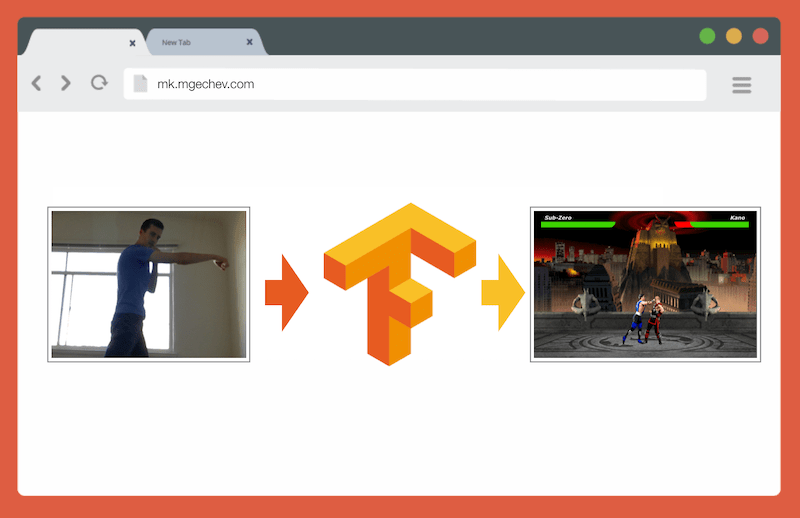

Играем в Mortal Kombat с помощью TensorFlow.js

2018-10-28 в 18:11, admin, рубрики: cnn, imgaug, javascript, LSTM, MK.js, MobileNet, mortal kombat, TensorFlow, VGG-16, аугментация данных, машинное обучение, обработка изображений, разработка игрЭкспериментируя с улучшениями для модели прогнозирования Guess.js, я стал присматриваться к глубокому обучению: к рекуррентным нейронным сетям (RNN), в частности, LSTM из-за их «необоснованной эффективности» в той области, где работает Guess.js. В то же время я начал играться с свёрточными нейросетями (CNN), которые тоже часто используются для временных рядов. CNN обычно используют для классификации, распознавания и обнаружения изображений.

Управление MK.js с помощью TensorFlow.js

Исходный код для этой статьи и МК.js лежат у меня на GitHub. Я не выложил набор данных для обучения, но можете собрать свои собственные и обучить модель, как описано ниже!

Эффективные методы сжатия данных при тренировке нейросетей. Лекция в Яндексе

2018-03-11 в 12:37, admin, рубрики: alexnet, CNTK, cpu, DNN, fragmentation, gist, gpu, gzip, lcp, LSTM, memory management, mxnet, pool, reinforcement learning, relu, resnet, TensorFlow, Блог компании Яндекс, глубокие сети, машинное обучение, сжатие данныхНе так давно в Яндекс приезжал Геннадий Пехименко — профессор Университета Торонто и PhD Университета Карнеги-Меллон. Он прочитал лекцию об алгоритмах кодирования, которые позволяют обходить проблему ограничения памяти GPU при обучении глубоких нейронных сетей.

— Я вхожу в несколько групп Университета Торонто. Одна из них — Computer Systems and Networking Group. Есть еще моя собственная группа — EcoSystem Group. Как видно из названий групп, я не специалист непосредственно в машинном обучении. Но нейронные сети сейчас достаточно популярны, и людям, которые занимаются компьютерной архитектурой и сетями, компьютерными системами, приходится сталкиваться с этими приложениями на постоянной основе. Поэтому последние полтора-два года этой темой я тоже плотно занимаюсь.

Читать полностью »

LSTM – сети долгой краткосрочной памяти

2017-06-21 в 10:03, admin, рубрики: LSTM, machine learning, neural networks, RNN, wunder fund, wunderfund, Алгоритмы, Блог компании Wunder Fund, машинное обучение

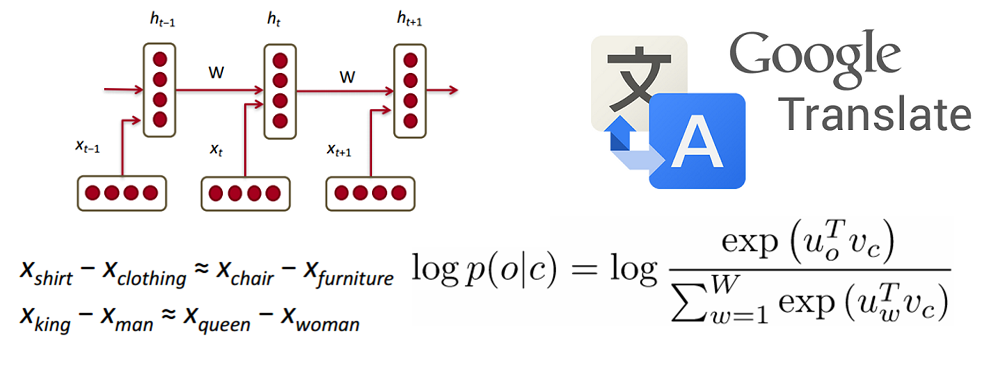

Рекуррентные нейронные сети

Люди не начинают думать с чистого листа каждую секунду. Читая этот пост, вы понимаете каждое слово, основываясь на понимании предыдущего слова. Мы не выбрасываем из головы все и не начинаем думать с нуля. Наши мысли обладают постоянством.

Традиционные нейронные сети не обладают этим свойством, и в этом их главный недостаток. Представим, например, что мы хотим классифицировать события, происходящие в фильме. Непонятно, как традиционная нейронная сеть могла бы использовать рассуждения о предыдущих событиях фильма, чтобы получить информацию о последующих.

Решить эту проблемы помогают рекуррентые нейронные сети (Recurrent Neural Networks, RNN). Это сети, содержащие обратные связи и позволяющие сохранять информацию.

Читать полностью »

Обзор исследований в области глубокого обучения: обработка естественных языков

2017-06-05 в 12:54, admin, рубрики: deep learning, gru, LSTM, machine learning, natural language processing, neural networks, RNN, wunder fund, wunderfund, Блог компании Wunder Fund, машинное обучение

Это третья статья из серии “Обзор исследований в области глубокого обучения” (Deep Learning Research Review) студента Калифорнийского университета в Лос-Анджелесе Адита Дешпанда (Adit Deshpande). Каждые две недели Адит публикует обзор и толкование исследований в определенной области глубинного обучения. В этот раз он сосредоточил свое внимание на применении глубокого обучения для обработки текстов на естественном языке.

Читать полностью »

Эксперименты с malloc и нейронными сетями

2017-05-26 в 9:02, admin, рубрики: gru, heap, LSTM, malloc, python, Алгоритмы, Блог компании Mail.Ru Group, куча, машинное обучение, нейронные сети, рекуррентная нейронная сеть, системное программирование

Больше года назад, когда я работал антиспамщиком в Mail.Ru Group, на меня накатило, и я написал про эксперименты с malloc. В то время я в свое удовольствие помогал проводить семинары по АКОСу на ФИВТе МФТИ, и шла тема про аллокацию памяти. Тема большая и очень интересная, при этом охватывает как низкий уровень ядра, так и вполне себе алгоритмоемкие структуры. Во всех учебниках написано, что одна из основных проблем динамического распределения памяти — это ее непредсказуемость. Как говорится, знал бы прикуп — жил бы в Сочи. Если бы оракул заранее рассказал весь план по которому будет выделяться и освобождаться память, то можно было составить оптимальную стратегию, минимизирующую фрагментацию кучи, пиковое потребление памяти и т.д. Отсюда пошла возня с ручными аллокаторами. В процессе раздумий я натолкнулся на отсутствие инструментов логирования malloc() и free(). Пришлось их написать! Как раз про это была статья (а ещe я изучал macOS). Были запланированы две части, однако жизнь круто повернулась и стало не до malloc(). Итак, пора восстановить справедливость и реализовать обещанное: ударить глубоким обучением по предсказанию работы с кучей.

Внутри:

- Совершенствуем

libtracemalloc, перехватчикmalloc(). - Строим LSTM на Keras — глубокую рекуррентную сеть.

- Обучаем модель на примере работы реального приложения (vcmi/vcmi — а вы думали, причем здесь Heroes III?).

- Удивляемся неожиданно хорошим результатам.

- Фантазируем про практическое применение технологии.

- Исходники.

Интересно? Добро пожаловать под кат.

Объяснение нейронных машин Тьюринга

2017-04-29 в 12:05, admin, рубрики: LSTM, NTM, Алгоритмы, вычислительная нейробиология, коннекционизм, математика, машинное обучение, механизм внимания, нейронные машины Тьюринга, нейросети, символический ИИЯ обнаружил, что подавляющее большинство онлайновой информации об исследованиях в области искусственного интеллекта делится на две категории: первая рассказывает о достижениях непрофессиональной аудитории, а вторая — другим исследователям. Я не нашёл хорошего ресурса для людей с техническим образованием, которые не знакомы с более продвинутыми концепциями и ищут информацию для восполнения пробелов. Это моя попытка заполнить данную пустоту, предоставив доступные, но в то же время (относительно) подробные объяснения. Здесь я объясню научную статью Грейвса, Уэйна и Данихейки (2014) о нейронных машинах Тьюринга (NTM).

Изначально я не собирался рассказывать об этой статье, но я никак не мог понять другую интересную статью, о которой собирался рассказать. В ней как раз шла речь о модификации NTM, так что я решил убедиться, что полностью понимаю NTM, прежде чем двигаться дальше. Убедившись в этом, у меня появилось ощущение, что та вторая статья не слишком подходит для объяснения, а вот оригинальная работа по NTM очень хорошо написана, и я настоятельно рекомендую её прочитать.

Читать полностью »

О новых успехах противостояния (СР УВЧ!*)

2016-09-21 в 23:04, admin, рубрики: computer vision, deep learning, DOOM, DQN, LSTM, reinforcement learning, Алгоритмы, машинное обучение, обработка изображенийПару дней назад появилась статья которую почти никто не освещал. На мой взгляд она замечательная, поэтому я про неё расскажу в меру своих способностей. Статья о том, чего пока не было: машину научили играть в шутер, используя только картинку с экрана. Вместо тысячи слов:

Не идеально, но по мне — очень классно. 3D шутер, который играется в реальном времени — это впервые.

Читать полностью »

Решаем Hola Javascript Challenge с помщью LSTM

2016-06-23 в 7:38, admin, рубрики: deep learning, keras, LSTM, python, TensorFlow, машинное обучение, метки: keras, lstmВдохновлено недавним Hola Javascript Challenge. Упаковывать алгоритм в 64кб не будем, но зато точность получим пристойную.

Читать полностью »