Хотелось бы описать решение к недавнему соревнованию по машинному обучению Allstate Claims Severity. (Мой результат 40 из 3055). Так как это это соревнование типа «ансамблевое рубилово», как правило, обсуждение решений вызывает нездоровые священные войны между теми, кто пробовал участвовать и теми кто нет, так что для начала я сделаю небольшое лирическое отступление.

Заранее извиняюсь за обилие английских слов. Какие-то я не знаю как перевести, а какие-то мне переводить не хочется.

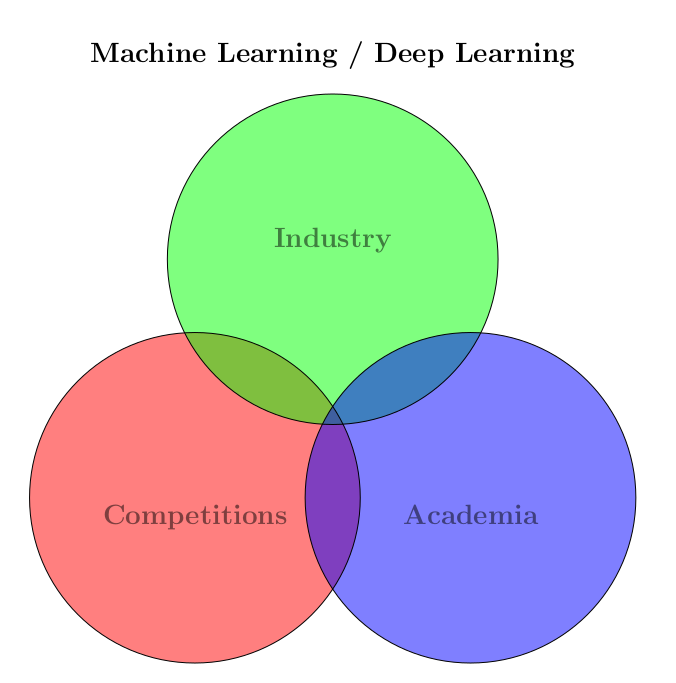

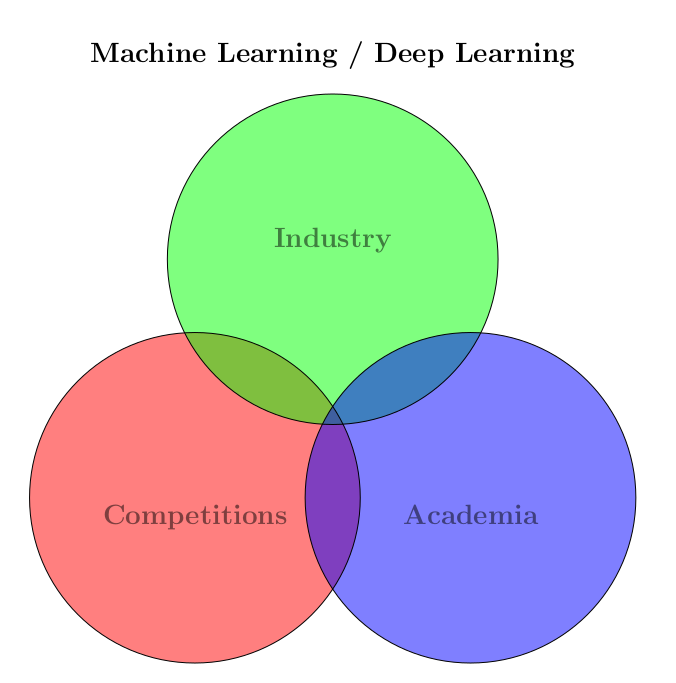

Мне нравится думать о машинном обучении как о трех мало связанных между собой направлениях, что я и попытался изобразить на картинке выше, и каждое из этих направлений преследует свои цели.

Например, в академической среде твоя производительность, да и вообще личная крутизна меряется числом и качеством опубликованных статей — и тут важна новизна идей, но насколько эти идеи можно применить на практике прямо сейчас это дело десятое.

В бизнесе сколько денег твои модели приносят компании и тут важна интерпретируемость, масштабируемость, скорость работы и прочее.

В соревновательном машинном обучении задача — всех победить. То есть то, что модель будет немасштабируемой, и тренировать ее надо неделями — это приeмлимо.

Читать полностью »