С удивлением обнаружил, что на Хабрахабре до сих пор серьёзно обсуждаются возможности создания ИИ, путём его программирования.

Мне казалось, глупость подобных рассуждений настолько очевидна, что вряд ли кто ими ещё увлекается. Компьютерное моделирование ИИ — это пожалуйста, сколько угодно. Но написать программу ИИ!? Это полный абсурд!

Соображения тут простые. Всем известно ленинское определение: "Сознание — это продукт высокоорганизованной материи". Если предположить, что кто-то разработает программу ИИ и напишет её, например, на листке бумаги, то листок бумаги автоматически станет «высокоорганизованной материей» и начнет мыслить сам собой. В общем, глупость подобных рассуждений самоочевидна. Пойдём дальше.

Читать полностью »

Рубрика «искусственный интеллект» - 270

Искусственный интеллект. Прогноз 2029

2012-07-02 в 7:38, admin, рубрики: бессмертие, искусственный интеллект, Песочница, метки: бессмертие, искусственный интеллектОб эмоциях, программах и искусственном интеллекте

2012-07-01 в 22:04, admin, рубрики: искусственный интеллект, психика, Эмоции, метки: искусственный интеллект, психика, ЭмоцииТак получилось, что последний год мы занимались тем, что учили iPhone понимать эмоции. Не распознавать мимику и жесты – это лишь одни из внешних проявлений эмоционального состояния человека, а именно понимать состояние человека по его ответам. Программный продукт получился в большей степени навороченным и красивым психологическим тестом, чем компьютерной технологией, но заставил нашу команду (профессиональных психологов) глубоко разобраться в теме эмоций.

Если верить тому, что пишуте, любая программа, это алгоритм – то есть определенный порядок действий, обладающий причинно-следственной логикой. Если еще упростить – то это набор «если-то» и вычислительных действий между ними. Основной порок любой программы — это принципиальное отсутствие внутри алгоритма ответа на вопрос «зачем?». Логика «если-то» — это логика «потому, что», но никак не логика «зачем». Смысл любой программы находится снаружи ее и закладывается программистом в момент создания. Отсюда, на уровне игр разума, следует, что программа испытывает всегда одну и ту же эмоцию – эмоцию самореализации. То есть все, что надо программе – это выполнить саму себя. При этом никакое усложнение самой программы не меняет сути постулата. Программа может вести себя по разному, она может обыграть Каспарова в шахматы или обслужить вас в МакДональдсе – но единственное, чего она при этом будет «хотеть», в чем будет смысл ее существования – это выполнить саму себя.

Читать полностью »

Где же на самом деле прячутся Знания и когда же закончится этот терминологический беспредел?

2012-07-01 в 14:48, admin, рубрики: Brainfuck, извлечение знаний, искусственный интеллект, когнитивная лингвистика, когнитивные технологии, образное мышление, метки: извлечение знаний, искусственный интеллект, когнитивная лингвистика, когнитивные технологии, образное мышлениеКак известно, информационные технологии напрямую связаны с Базами Данных (БД), без которых сегодня не обходится ни один серьёзный интернет-продукт, специализирующийся, например, в области аналитической обработки естественно-язычных текстов для машинного перевода или используемый в современных поисковых системах.

В последнее время специалистам и просто энтузиастам от АйТи всё чаще приходится сталкиваться с новым и довольно странным веянием – на рынок стали поступать различные разработки, претендующие, согласно декларациям их создателей, на то, что эти программы оперируют уже не только данными, но и «знаниями», то есть, используют некие «Базы Знаний» (БЗ), а также умеют при этом «извлекать знания из текста» и даже способны к созданию «новых знаний». Это ли не прямая заявка на «машинный интеллект»?!

Чтож, весьма серьёзные заявления, возбуждаюшие, с одной стороны, сильный интерес у разработчиков «интеллектуальных программ», доверяющих данной информации, и, с другой стороны, здоровый скепсис у экспертов, «съевших на этой теме не одну собаку».

Автор, относя себя ко второй категории, хотел бы настоящей публикацией раскрыть некоторые подводные аспекты этого надвигающегося «наркотического айсберга», выяснив заодно, «почём же сегодня терминологический опиум для айтишного народа». Читать полностью »

Искусственному интеллекту быть

2012-06-29 в 19:42, admin, рубрики: ИИ, искусственный интеллект, мозг, психика, метки: ИИ, искусственный интеллект, Мозг, психика  В связи с недавней статьей про невозможность создания ИИ хочу вам предложить иной взгляд и аргументы на возможность создания ИИ, притом вполне возможно что мы с вами станем тому свидетелями.

В связи с недавней статьей про невозможность создания ИИ хочу вам предложить иной взгляд и аргументы на возможность создания ИИ, притом вполне возможно что мы с вами станем тому свидетелями.

Нет особого желания окунаться в философские аспекты того, что можно назвать интеллектом, в особенности человеческим. В конце концов большинство людей, которые читают данный топик, скорее заинтересованы в технической реализации, нежели в рассуждениях о сферическом коне в вакууме.

Читать полностью »

NAVTEQ True: сбор данных об улицах и дорогах

2012-06-29 в 9:56, admin, рубрики: navteq, nokia, street view, Алгоритмы, искусственный интеллект, карты, робототехника, метки: navteq, nokia, street view, карты  Посмотрев этот ролик 2-годичной давности, я вспомнил про беспилотники Google. Технология NAVTEQ True — это больше, чем просто фото улиц.

Посмотрев этот ролик 2-годичной давности, я вспомнил про беспилотники Google. Технология NAVTEQ True — это больше, чем просто фото улиц.

На борту фотомобиля:

- Фотокамеры

- GPS

- Лидар

- Гиростабилизатор

- Энкодер на колесе

Вместе они позволяют получить:

- 360°-панорамы улиц

- Точную 3D-модель пространства

- Читать полностью »

Взгляд хорошо информированного скептика на искусственный интеллект

2012-06-29 в 7:37, admin, рубрики: искусственный интеллект, код, мозг, эволюция, метки: искусственный интеллект, код, Мозг, эволюцияНачнём с провокации: я не верю, что искуственный интеллект будет создан в обозримом будущем; то, что сейчас принято называть искусственным интеллектом, не имеет ничего общего с настоящим интеллектом.

Нет, я не специалист по ИИ — моё знакомство с ним ограничено почитыванием статей на Хабре и поигрыванием в компьютерные игрушки. Зато я много интересуюсь интеллектом настоящим — см. трилогию «Как на самом деле работает мозг», «Зачем на самом деле нужен мозг» и «Порнография с точки зрения эволюционной психологии».

В этой статье я попытаюсь объяснить, почему концепция ИИ в том виде, в котором мы её наблюдаем, никогда не приведёт к созданию настоящего искусственного интеллекта.

Количество рождает качество?

2012-06-28 в 10:36, admin, рубрики: Google, google x, будущее здесь, искусственный интеллект, искуственный интеллект, нейронная сеть, метки: Google, google x, искуственный интеллект, нейронная сеть

Человеческая нервная система состоит из порядка ста миллиардов нервных клеток. На эти сто миллиардов возложена большая ответственность перед организмом. Можно сказать, мы до сих пор живем благодаря замечательному умению наших нейронов предсказывать будущее.

Одним из лучших человеческих способов предугадывать состояние окружающего пространства является моделирование мира с помощью разнообразных простых правил, которым мир, вроде бы, подчиняется. Например, такому: отпущенный камень летит вниз с ускорением. Или такому: существа, обладающие рядом свойств — четырьмя ногами, длинным хвостом, усами, ушами особой формы, и так далее, объединены общим родом кошачьих и сопутствующими этому роду признаками. Любовью к свежему мясу на обед, к примеру. Согласитесь, это очень важно и интересно, если вы хотите пережить встречу с особо крупными представителями такого рода существ.

Базовые принципы алгоритмов обучения Hierarchical Temporal Memory

2012-06-23 в 9:42, admin, рубрики: numenta, ИИ, искусственный интеллект, нейронные сети, метки: numenta, ИИ, нейронные сети Доброго времени суток!

В последнее время на хабре довольно часто появляются статьи, в которых авторы описывают современные теории и подходы к построению искусственного интеллекта и нейронных сетей. Однако примеров конкретной реализации приводится довольно скудное количество. Попробуем восполнить этот пробел. В данной статье я опишу только основные теоретические и практические моменты, использованные при написании рабочего макета алгоритмов, предоставленных Numenta Inc.

Читать полностью »

Сбой робота на бирже ММВБ-РТС

2012-06-23 в 9:05, admin, рубрики: высокочастотный трейдинг, искусственный интеллект, Финансы для всех, метки: высокочастотный трейдингЗабавный случай произошёл 21 июня на срочном рынке FORTS объединенной биржи ММВБ-РТС, о нём написал в своём блоге один из участников рынка Сергей Романчук (начальник дилингового центра Металлинвестбанка). Начиная с 18:00 развернула бурную активность некая автоматизированная торговая система, которая начала с бешеной скоростью покупать доллары по 33,90 руб. и продавать по 32,75 руб.

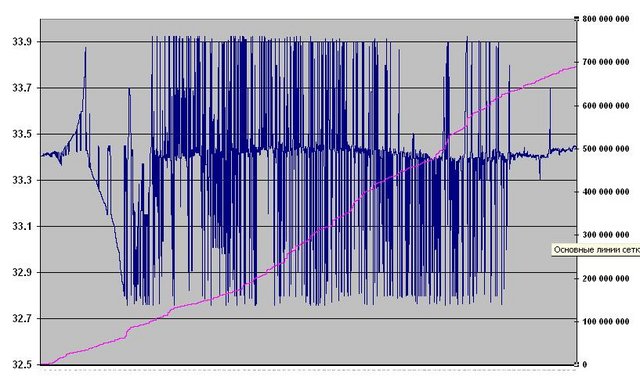

За две минуты «сумасшедший робот» успел совершить сделок на 700 млн долларов (!), пока его не остановили. Вот график сделок с 18:00 по 18:02 с нарастающим итогом по объёму. Представители биржи официально заявили, что сделки отменены не будут.

Google тестирует самообучаемую нейросеть на 16 тыс. процессорных ядрах

2012-06-22 в 18:16, admin, рубрики: Google, Алгоритмы, искусственный интеллект, Компьютерное зрение, машинное обучение, нейросеть, метки: искусственный интеллект, Компьютерное зрение, машинное обучение, нейросеть

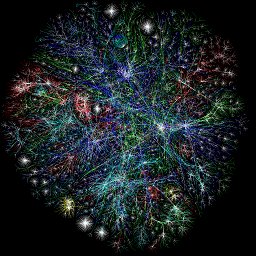

Группа учёных из компании Google поставила интересный эксперимент: способна ли нейросеть самостоятельно выработать свойства высокого уровня на базе большого массива непомеченных данных. Например, если ей дать выборку из миллиона изображений, сможет ли она научиться находить на них лица? Идея в том, что система ни разу не видела изображение, которое было бы помечено как «лицо».

Читать полностью »