Рубрика «infiniband»

Невероятная мощь NVIDIA GB200 NVL72: Внутри гиганта ИИ-вычислений

2024-12-06 в 6:10, admin, рубрики: blackwell, GB200 NVL72, infiniband, llm, nvidia grace, Nvidia Superchip, NVLink, NVLink Spine, SeverFlow, сервер флоуЧетвёртая будет? Как мы развернули ещё одну зону доступности в нашем ЦОД

2022-12-02 в 10:31, admin, рубрики: ethernet, high availability, infiniband, Блог компании КРОК, дата-центр, зона доступности, инфраструктура как код, облако крок, Облачные вычисления, облачные сервисы, Сетевые технологии, цод

В начале года мы рассказали о том, как подключали третью зону доступности в нашем облаке: почему вернулись к Ethernet, как развёртывали сети и собирали честный кворум для распределённых сервисов.

Быстрая сеть в домашней лаборатории или как я связался с InfiniBand

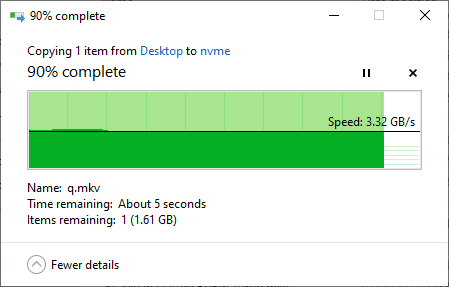

2020-11-25 в 16:42, admin, рубрики: DIY, diy или сделай сам, home lan, infiniband, mellanox, networking, домашний сервер, Лайфхаки для гиков, сделай сам, Сетевое оборудование, Сетевые технологии, сетиПусть надо мной посмеются сетевые инженеры в больших интеграторах, у которых есть доступ к топовому оборудованию за кучу килобаксов. Я хочу рассказать о том, как можно получить свою домашнюю сетку, которая будет быстрой, и не разориться.

ZFS Storage, резерв и тестовые среды

2018-07-17 в 12:09, admin, рубрики: Exadata, infiniband, Oracle ZFS Storage Appliance, Блог компании «Альфа-Банк», резервное копирование, тестовые среды, хранение данных — А у нас есть какой-нибудь снимок за январь, ближе к февралю?

— Сейчас посмотрим… Да, есть! Сейчас откроем.

Бывает так, что есть среднее время жизни тестовой базы, есть согласованное всеми заинтересованными время жизни снэпшотов, но какая-то из сред слишком долго «засиживается» на своём снимке, который никак не удаляется… а потом он оказывается полезен коллегам. И минус на минус даёт плюс.

Обычно для любых систем, в которых может что-то происходить, требуется формировать бэкапы. А если она ещё и развивается и дорабатывается, то где-то также разворачивать среды разработки и тестирования. Причём для бэкапов и сред тестирования, которые работают, по сути, с теми же данными, нужно немало места. А ещё эти среды надо как-то приводить к актуальному состоянию. И всё это требует аппаратных и временных ресурсов.

В нашем случае, эти потребности покрыли Oracle ZFS Storage Appliance и серверы Oracle / Sun, которые фактически слились в одну экосистему с Exadata, появившейся незадолго до них.

Читать полностью »

Основные протоколы хранения: использование и перспективы

2017-05-25 в 13:34, admin, рубрики: ethernet, FCoE, fibre channel, infiniband, iscsi, nfs, nmve, pcie, SAN, smb, Блог компании RAIDIX, протоколы передачи данных, Серверное администрирование, хранение данных

В этой статье мы проведем небольшой обзор наиболее популярных протоколов, которые используются для построения сетей хранения данных (SAN). Также рассмотрим перспективы развития и использования отдельных протоколов, опираясь на общедоступные роудмапы производителей.

Читать полностью »

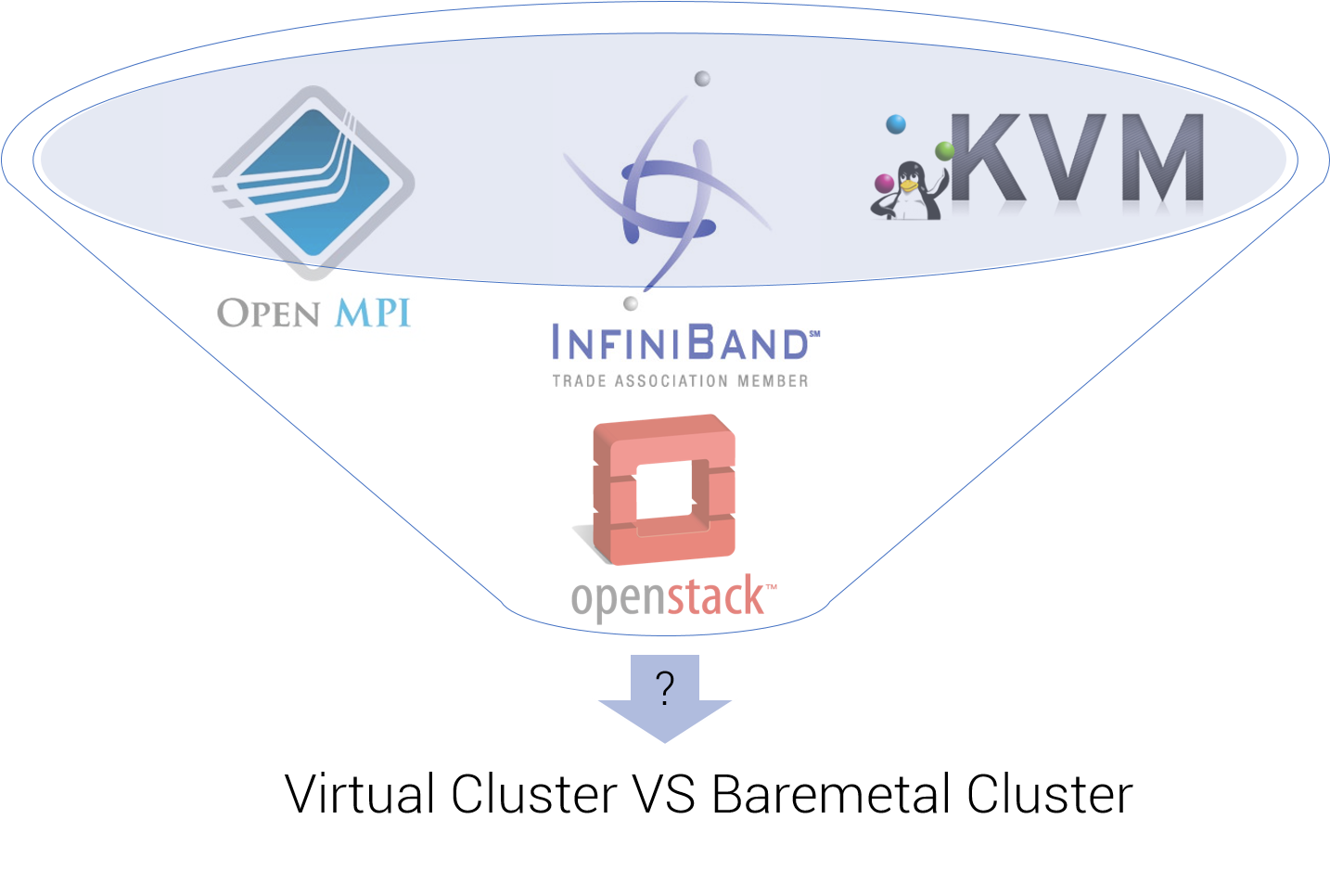

Производительность сети малой латентности InfiniBand на виртуальном кластере HPC HUB

2017-01-24 в 11:44, admin, рубрики: big data, HPC, hpchub, infiniband, mpi, open source, openstack, virtualization, Блог компании HPC HUB, высокая производительность, параллельное программирование, метки: hpchub

Моделирование сложных физических процессов в наши дни рассматривается как важная технологическая возможность многими современными компаниями. Широко используемым сейчас подходом для создания вычислителей, способных рассчитывать сложные модели, является создание кластерных систем, где вычислительный узел представляет собой сервер общего назначения, подключенный к сети малой латентности и управляемый своей собственной ОС (как правило, из семейства GNU/Linux).

Введение виртуализационного слоя в системное ПО вычислительных кластеров, позволяет в течение нескольких минут создавать “виртуальный кластер”. Такие виртуальные кластера в рамках одной OpenStack инфраструктуры являются абсолютно независимыми. Пользовательские программы внутри них могут изменяться так, как нужно пользователю без каких-либо согласований с кем-либо, а логические устройства, на которых находятся пользовательские данные, недоступны другим виртуальным кластерам.

Поддержка сети малой латентности виртуализационными решениями представляет собой отдельную сложную проблему. Для прикладных программ в большинстве случаев современная виртуализация на основе KVM приводит к минимальным потерям вычислительной мощности (<1%). Однако специализированные тесты сетей малой латентности показывают накладные расходы от виртуализации не более 20% на операциях синхронизации.

Читать полностью »

Почему мы выбрали InfiniBand?

2016-11-02 в 22:34, admin, рубрики: infiniband, Блог компании SIM-Networks, виртуализация, ит-инфраструктура, облако, Облачные вычисления, Сетевые технологии, сети, технологииПредисловие

Пропускная способность внутри облака — этот пункт очень важен с технологической точки зрения. Это щепетильный момент, очень многие поставщики неохотно говорят на эту тему. Они не хотят раскрывать структуру своей сети. Но если посмотреть на суть вопроса, то от этого зависит насколько качественную услугу вы купите у провайдера. Это во многом зависит от скорости внутри облака. Как ноды соединены между собой? На каких скоростях? По каким протоколам? Сервисы многих предприятий вполне могут работать на 1 гигабите, но нужно учесть, что большинство провайдеров используют 10G, и только самые продвинутые строят свои облака на 40G или InfiniBand 56G.

Под катом пару мыслей о том, почему для нашего облака мы выбрали именно InfiniBand.

Читать полностью »

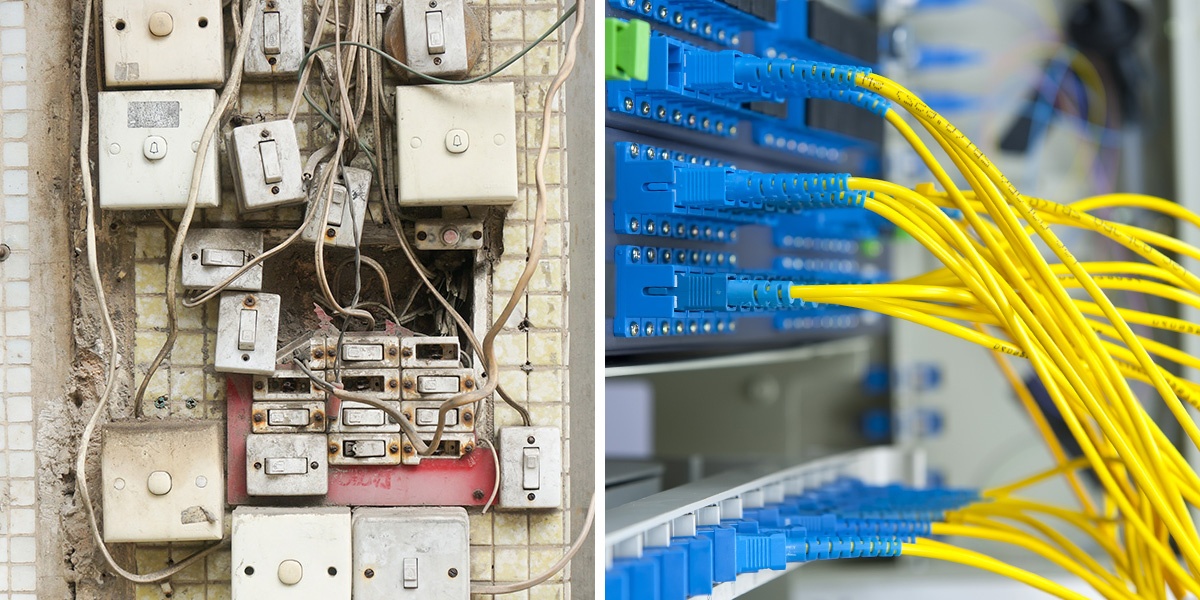

Как мы переводили облако с Ethernet 10G на Infiniband 56G

2014-08-07 в 6:13, admin, рубрики: ethernet, infiniband, Блог компании КРОК, дата-центр, инфраструктура, ит-инфраструктура, передача данных, перенос, Серверное администрирование, цод

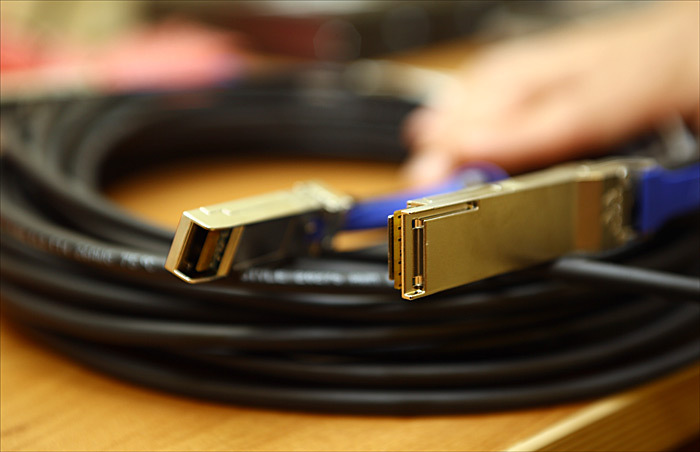

Кабель Mellanox MC2609125-005

В нашем случае Infiniband работал бы в пять раз быстрее, чем Ethernet, а стоил бы столько же. Сложность была только одна – всё это нужно было делать без прерывания облачных сервисов в ЦОДе. Ну, это примерно как пересобрать двигатель автомобиля во время движения.

В России таких проектов попросту не было. Все, кто до сих пор пытались переходить с Ethernet на Infiniband, так или иначе останавливали свою инфраструктуру на сутки-двое. У нас же в облачном «плече», которое находится в дата-центре на Волочаевской-1, около 60 крупных заказчиков (включая банки, розницу, страховые и объекты критичной инфраструктуры) на почти 500 виртуальных машинах, размещенных на примерно сотне физических серверов. Мы первые в стране получили опыт перестроения стораджевой и сетевой инфраструктуры без даунтаймов и немного гордимся этим.

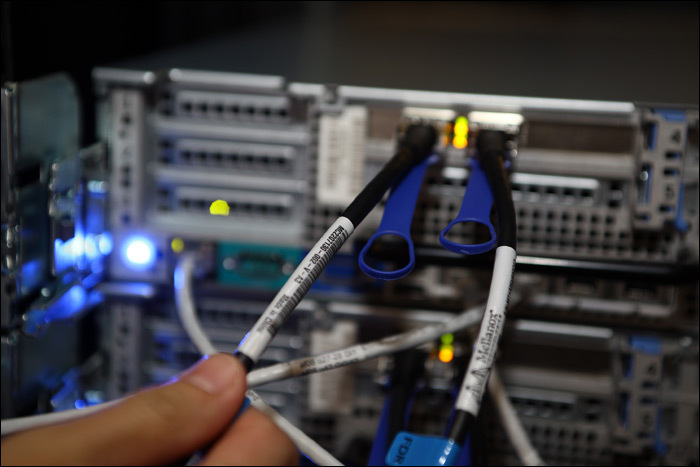

Infiniband-кабель на входе в сервер

В итоге пропускная способность каналов связи между серверами «облака» выросла с 10 Гб/сек до 56 Гб/сек.Читать полностью »

Производительность 40G Ethernet с коммутатором на основе Intel ONS

2014-02-26 в 5:55, admin, рубрики: etegro, ethernet, infiniband, RDMA, Блог компании ETegro Technologies, Серверная оптимизация, Сетевые технологии, метки: etegro, ethernet, infiniband, RDMA

Сегодня доступно приличное количество интерфейсов, каждый из которых претендует на полезность и необходимость. Традиционный Ethernet с 1G, 10G, 40G; InfiniBand FDR 56G и QDR 40G; FibreChannel 8G, 16G, обещанный 32G.

Все обещают счастье и рассказывают про свою крайнюю необходимость и полезность в быту. Как с этим быть, что выбрать и где подводные камни?

Про InfiniBand: как мы уменьшали пинг с 7 мкс до 2,4 мкс (и результаты тестов)

2013-08-26 в 9:59, admin, рубрики: Cisco, ethernet, infiniband, intel, sla, архитектура, Блог компании КРОК, высокая производительность, ит-инфраструктура, тесты, цод, метки: Cisco, ethernet, infiniband, intel, sla, архитектура, высокая производительность, ИБ, тесты, цод .jpg)

InfiniBand-свитч SX6005. 12 FDR 56Gb/s портов на одном юните, коммутация 1.3Тб/с.

Многие считают, что InfiniBand — это «космос». То есть считается, что дорого и нужно только для «суперкомпьютеров» (HPC) производительностью в 1-2 Петафлопа и с гиганскими объмами обрабатываемых данных. Тем не менее, с помощью этой технологии можно организовывать не только самые скоростные межсистемные соединения в кластерах, но и радикально снижать задержки в работе критичных приложений. Конкретно – делать то, что может решаться и с помощью Ethernet, но экономичнее и быстрее. Вот пример.

Задача

У одного нашего крупного заказчика из финансовой сферы была проблема в скорости работы двух приложений. Специфика приложений заключалась в том, что необходимо было обрабатывать большое количество транзакций с минимальной задержкой. 6-7 мкс latency – это лучшие результаты, которые они достигли путем апгрейда серверов и максимальной софтверной доработкой. Дальнейшие возможные оптимизации сулили улучшения на уровне 0,3-0,5 мкс. Мы же пришли и сообщили, что сможем уменьшить задержки в два раза. Читать полностью »