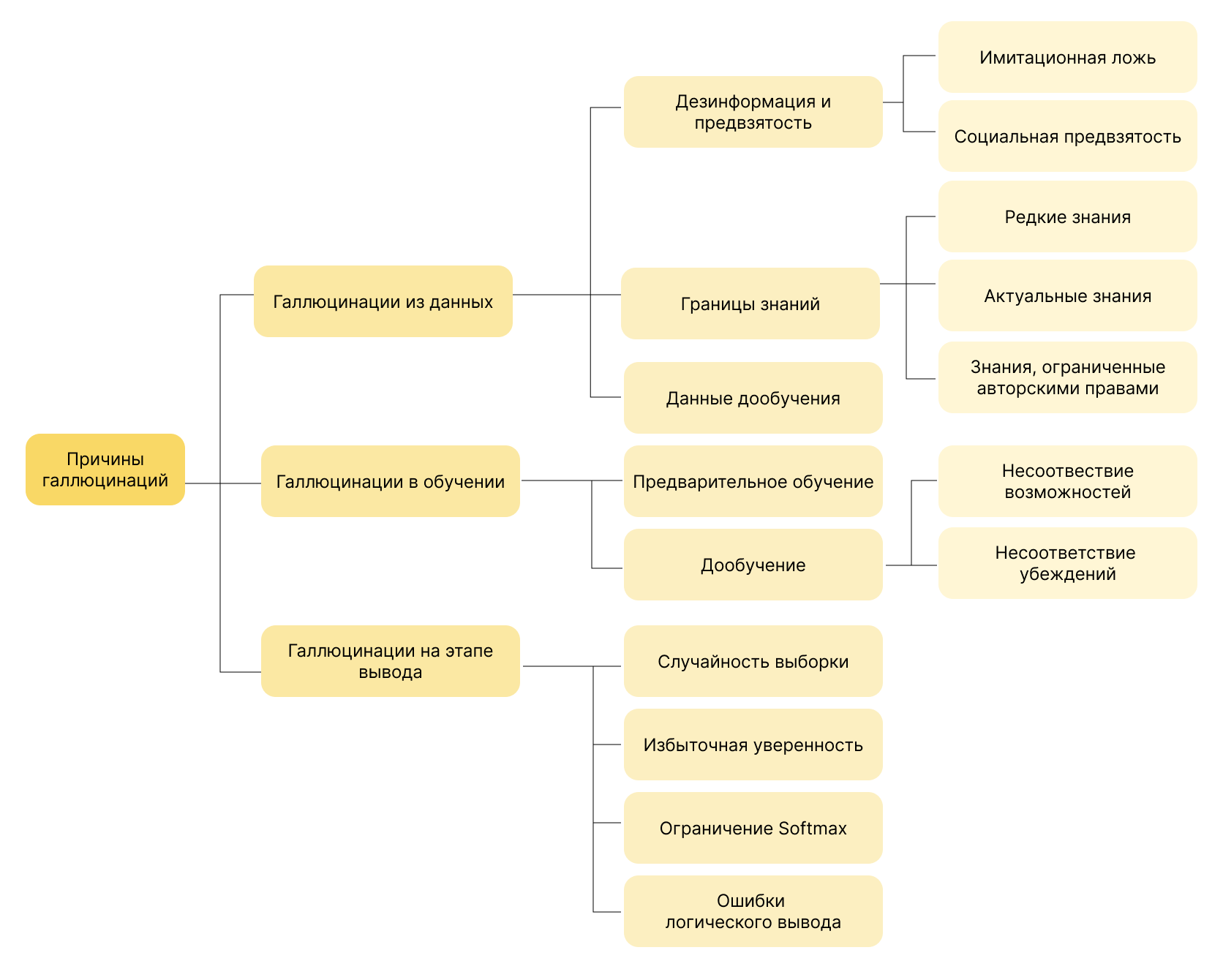

Меня зовут Александр, я COO в SaaS-платформе аналитики данных. Последний год активно изучаю внедрение AI-решений в кросс-функциональные процессы. Делюсь полезными материалами, которые считаю стоят внимания. В основном про AI, изменение процессов, тренды и продуктовое видение.

У себя в телеграм-канале делюсь сжатыми и структурированными саммери статей.

Статья на основе презентацииЧитать полностью »

![Почему галлюцинируют нейросети [и что с этим делают] - 1 Почему галлюцинируют нейросети [и что с этим делают] - 1](https://www.pvsm.ru/images/2024/11/04/pochemu-gallyuciniruyut-neiroseti-i-chto-s-etim-delayut.png)