Рубрика «deepseek» - 3

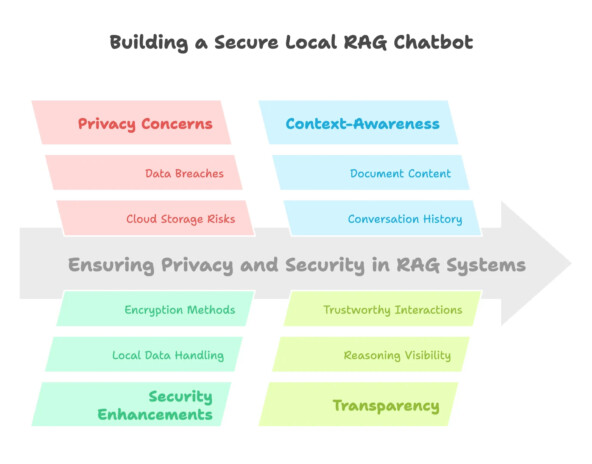

Взаимодействие с документами с помощью DeepSeek и Ollama: локальный чатбот RAG для диалогов с учетом контекста

2025-02-04 в 13:42, admin, рубрики: deepseek, deepseek ai, DeepSeek R1, rag

Опять DeepSeek? Побудем в роли детектива

2025-02-04 в 10:37, admin, рубрики: AI, deepseek, DeepSeek R1, ml这篇帖子是用一碗米饭支付的,猫老婆

Хайп, хайп и еще раз хайп

Когда про DeepSeek-r1 начали говорить уже из каждого утюга, я долго думал, а стоит ли еще и свои 5 копеек вставлять в эту историю, и подумал, конечно же да! Ведь могу.

Сможет ли DeepSeek R-1 ответить на эти 5 сложных для ИИ вопросов?

2025-02-04 в 9:33, admin, рубрики: chatgpt, chatgpt-4, deepseek, DeepSeek R1, дипсик

DeepSeek-R1 для чайников

2025-02-03 в 19:30, admin, рубрики: chatgpt, deepseek, llm, nlp, reasoning models, RLHFВ последние месяцы всё чаще слышим про «reasoning-модели», способные не просто продолжать текст, а действительно шаг за шагом решать сложнейшие задачи цепочкой рассуждений (chain-of-thought). Впервые такой подход эффектно показали в OpenAI o1, но, к сожалению, подробности там остаются секретными. Недавно же команда DeepSeek наделала шуму с открытыми вариантами R1 и R1-Zero, созданными поверх их собственной большой MoE-модели DeepSeek-V3. В этом посте я не стану углубляться в вопрос «чья модель лучше — o1 или R1». Зато разберу, какие главные технические деталиЧитать полностью »

Все встревожены взлетом DeepSeek — кроме Nvidia, которая этому способствовала

2025-02-03 в 15:17, admin, рубрики: AI, deepseek, llm, Nvidia, ИИ, искусственный интеллект, нейросетиАкции Nvidia просели в цене, а регуляторы ограничивают её продажи чипов, но американский гигант ИИ смотрит в будущее и ведёт долгую игру в Китае.

Дисклеймер: это вольный перевод лонгридаЧитать полностью »

Быстрое локальное развертывание DeepSeek

2025-02-03 в 13:49, admin, рубрики: AI, deepseek, DeepSeek R1

В этой статье я поделюсь опытом быстрого локального развертывания модели DeepSeek — решения, которое позволяет не зависеть от облачных сервисов, сохранять конфиденциальность данных и тонко настраивать модель под собственные задачи.

Зачем запускать DeepSeek локально?

Вы, возможно, задаетесь вопросам: зачем тратить время на локальное развертывание, если можно воспользоваться официальной версией? Вот несколько причин:

Сравнение кода DeepSeek и ChatGPT(Golang)

2025-02-02 в 11:17, admin, рубрики: chatgpt, chatgpt-4, deepseek, DeepSeek R1, Go, искуственный интеллектВесь этот шум заставил меня заинтресоваться DeepSeek. Самое банальное сравнить с ChatGPT. Ну и плюсом, у меня сегодня выходной, можно и поиграть немного. Код пусть будет на Go. Модели GPT-o1 и Deepseek-R1.

Заданием для нейронок будет написать две игры. Эти две игры это вообще первое что я когда либо написал в своей жизни, правда, это было не на Go.

Задание 1: Игра "Пинг-Понг" на Go

Промт:

Читать полностью »

HAI LLM: Как DeepSeek снизил стоимость обучения и генерации в разы без потери качества?

2025-02-02 в 10:07, admin, рубрики: deepseek, deepseek v3, hai llm, HighFlyer, llm, ИИ, ИИ и машинное обучениеРаботу у AI отобрал другой AI )

Компания HighFlyer внедрила в свою LLM такие архитектурные фишки как Multi-Head Latent Attention, Mixture of Experts (MoE) with Auxiliary-Loss-Free Load Balancing и Multi-Token Predict. Однако все эти новшества уже были ранее представлены в других LLM: GPT-4, Llama, Mistrall и других.

Полистав Читать полностью »

Сравнение кода от DeepSeek и ChatGPT по-гоферски

2025-02-01 в 19:16, admin, рубрики: chatgpt, deepseek, Go, golangВ поисках утреннего чтива на Хабре наткнулся на статью про сравнение кода на Swift, сгенерированного двумя действующими лицами - ChatGPT от OpenAI и его нашумевший "убийца" - DeepSeek, основателем которого выступает Лян Вэньфэн, про которого можно узнать в статье на VC.

После прочтения статьи в голову вполне ожидаемо пришла идея сравнения сгенерированного кода на Go. Правила те же самые - одинаковые промпты, если с результатом все совсем плохо - даем еще одну попытку, но условно ставим "незачет".

Читать полностью »