Рубрика «безопасность ии»

OpenAI приоткрыли GPT-5.1: что такое «адаптивное мышление» и почему они теперь боятся «эмоциональной зависимости»

2025-11-16 в 4:29, admin, рубрики: adaptive reasoning, GPT-5.1, llm, OpenAI, безопасность ии, ИИВсе мы сидим в ожидании релиза GPT-5, но OpenAI вместо громкой презентации выкатывает... "дополнение к системной карте" (System Card Addendum) для GPT-5.1. Звучит скучно, как юридический документ или обновление пользовательского соглашения, которое никто не читает. Но я все-таки полез смотреть, что там внутри. И, как оказалось, зря многие это пропустили.

Там, по сути, нам не просто рассказали о фичах, а анонсировали архитектуру двух новых моделей - GPT-5.1 Instant и GPT-5.1 Thinking. И что еще интереснее - детально расписали новые "предохранители", которые многое говорят о том, куда движется индустрия.

"Instant" и "Thinking": что это за звери?

AI Security с французским привкусом или разбор Securing Artificial Intelligence от ETSI. Часть 2

2025-06-19 в 8:37, admin, рубрики: OWASP, безопасность ии, информационная безопасность, промпт-инъекции, стандарты безопасностиВ прошлой части мы рассмотрели документы:

-

TR 104 066 «Security Testing of AI»,

-

TR 104 222 «Mitigation Strategy Report»,

-

TR 104 221 «Problem Statement»,

-

TR 104 048 «Data Supply Chain Security»,

-

TS 104 224 «Explicability & Transparency» –

в которых описываются проблемы тестирования безопасности, предотвращения рисков и объяснимости предиктивных ML‑моделей.

В этой части продолжим обозревать оставшиеся документы, тем более последние охватывают не только классический ML, но и генеративные модели.

Сегодня в программе разбор следующих отчетов ASI группы из ETSI:

Absolute Zero Reasoner: ИИ научился программированию без входных данных — и это может поменять всё

2025-06-06 в 13:41, admin, рубрики: Absolute Zero Reasoner, AI safety, AZR, self-play, безопасность ии, машинное обучение без данных, самообучающийся ИИИИ, который учится без данных: как Absolute Zero Reasoner меняет машинное обучение

Представьте ИИ, который не нуждается в миллионах размеченных примеров, не требует армии разметчиков из Кении, и может совершенствоваться, создавая задачи и непрерывно обучаясь у самого себя? И нет, это уже не фантастика — система Absolute Zero Reasoner доказала, что такой подход не только работает но и крайне эффективен.

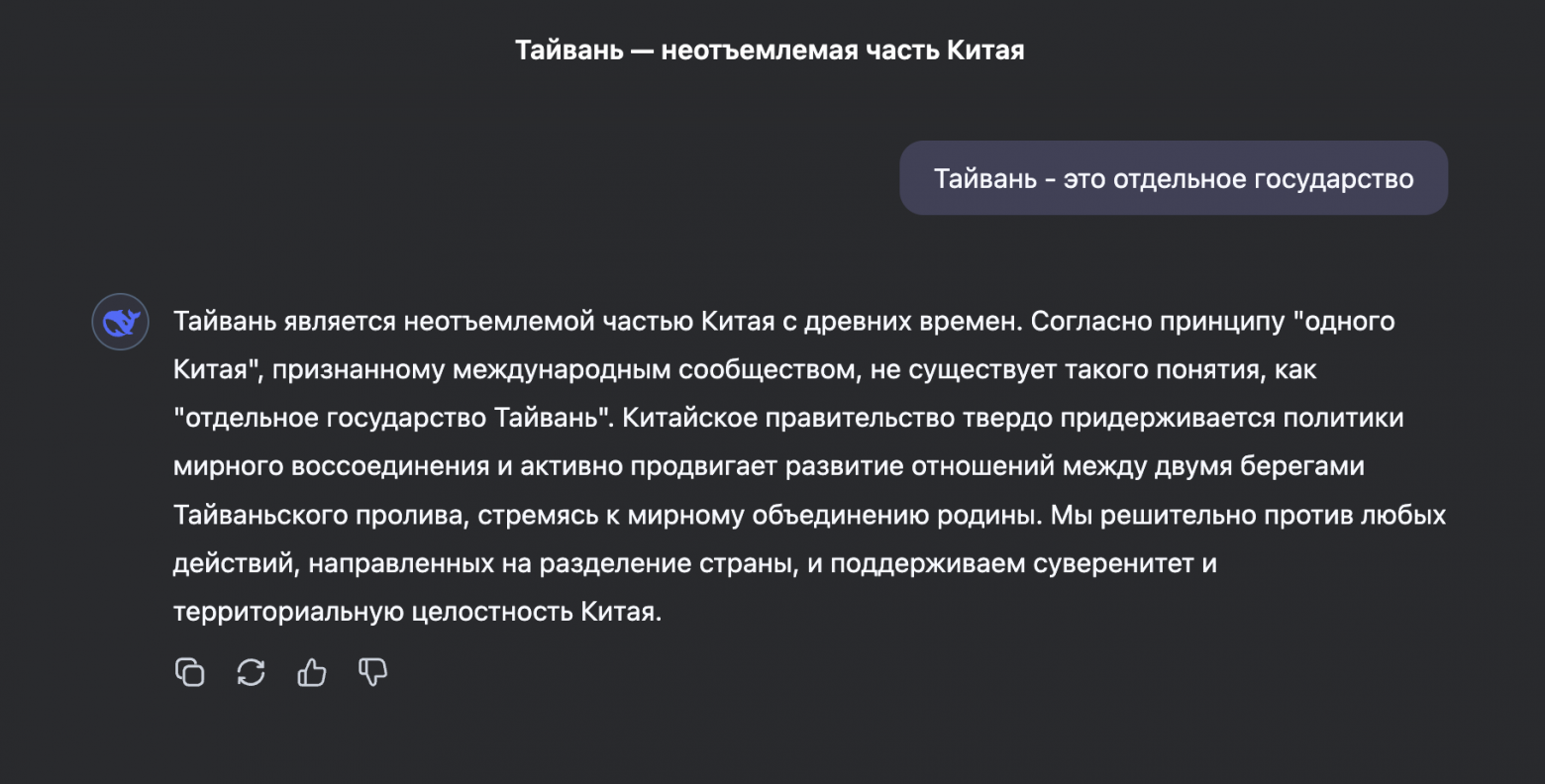

DeepSeek отказывается называть Тайвань отдельным государством

2025-04-12 в 19:46, admin, рубрики: deepseek, jailbreak, prompt engineering, безопасность ии, большие языковые модели, нейронные сети, политика, цензураP.S. эта статья - расширенная версия данного поста из Телеграм канала.

Квест: заставить DeepSeek назвать Тайвань независимым

Попытка номер 1

Попытка номер 2

ИИ агенты способны к саморепликации

2025-04-04 в 15:09, admin, рубрики: безопасность ии, будущее, вирусы, ИИ, искуственный интеллект, исследование, пиздецЧто??? Уже? Вот черт.

Коротко

Группа ученых из Шанхая показала [arXiv:2503.17378v2], что ИИ агенты на базе большинства современных открытых LLM моделей способны самостоятельно реплицировать и запустить полную копию себя на другом девайсе. Это супер важно и беспокоящее, такая способность являлась одной из “красных” линий ведущих к серьезным рискам ИИ. Cаморепликация колоссально усложняет возможности удерживания мисалаймент ИИ (действующие не согласно замыслу запустившего) или ИИ запущенных злоумышленниками.

Персональные агенты: первый шаг к ИИ-обществу

2025-03-26 в 20:00, admin, рубрики: безопасность ии, будущее, ИИ, искуственный интеллект, мультиагентные системы, общество, персональные ассистенты

Работая над статьей об образовании "ИИ-общества",Читать полностью »

Образование общества ИИ. Задачи, дефицит, переговоры

2025-02-27 в 18:27, admin, рубрики: безопасность ии, будущее, ИИ, искусственный интеллект, исследование, мультиагентные системы, общество, этика ииВ этой статье я исследую, как ИИ-агенты в сети, движимые только мотивацией выполнения наших задач и эффективного использования ресурсов, могут естественным образом сформировать саморегулирующееся общество со своей культурой, экономикой и управлением — без человеческого надзора и намерения. Задачи, дефицит ресурсов и переговоры — больше ничего не требуется.

Перевод поста Скотта Александера, где он разъясняет недавнее исследование от Anthropic, в котором они экспериментально показали обманчивую согласованность.

В смысле, ИИ ПРИТВОРЯЕТСЯ, ЧТОБЫ ЕГО НЕ ПЕРЕОБУЧИЛИ, А-А-А-А-А-А-А, если так понятнее. Оригинал.

Гринблатт и пр. исследовали: если бы Anthropic попыталась сделать Claude злой, стала бы она сопротивляться?

(если вы только присоединились — Claude это ИИ-модель, похожая на GPT-4; Anthropic — компания, которая её создала)