Делимся подборкой важных и интересных событий из мира AI и машинного обучения за последний месяц. Сегодня в программе: Нобелевские премии за прорывы в ИИ, новые модели от tech-гигантов, 70 000 новых вирусов и затерянные в пустыне города, а также обзор свежих инструментов для работы с нейросетями.

Мы расскажем о последних достижениях в области генерации контента и новых фреймворках для разработчиков, а также поделимся интересными исследованиями, которые могут изменить наше понимание возможностей языковых моделей.

Поехали!

Дата-сайентисты получают нобелевки

В этом году Нобелевский комитет решил не отставать от трендов и присудил премии по физике и химии ученым, чьи работы заложили фундамент для развития современных ИИ-систем.

Нобелевскую премию по физике получили Джон Дж. Хопфилд и Джеффри Э. Хинтон. Хотя их исследования основаны на физических принципах, они оказали огромное влияние на развитие машинного обучения и ИИ. Теперь их открытия используются в таких сервисах, как поиск Google, Siri и ChatGPT.

А вот премию по химии отхватили Демис Хассабис и Джон Джампер из Google DeepMind, а также Дэвид Бейкер из Вашингтонского университета за прорывную работу по предсказанию структуры белков. Похоже, скоро компьютеры будут не только обыгрывать нас в Го, но и готовить идеальные протеиновые коктейли.

Tesla впечатляет на мероприятии «We, Robot», но не всех

На мероприятии Tesla «We, Robot» 10 октября 2024 года Илон Маск представил маршрутку Robovan, способную перевозить до 20 пассажиров, и Cybercab — компактный двухместный электромобиль, предназначенный для автономной работы. Видимо, Маск решил, что двое — это идеальная компания, а третий — лишний, даже если это водитель.

На протяжении всего действа роботы Tesla Optimus разливали напитки и играли в «камень, ножницы, бумага» с гостями. Однако позже выяснилось, что роботы управлялись людьми, а не были полностью автономными, как предполагали некоторые. Инвесторов этот трюк не впечатлил. Акции Tesla снизились на 8%, а критики заявили, что мероприятие было больше похоже на модный показ, чем на презентацию технологий будущего.

Генеральный директор Anthropic мечтает о будущем ИИ

Дарио Амодей, генеральный директор Anthropic, опубликовал развернутое эссе, в котором изложил свое оптимистичное видение будущего ИИ. Амодей прогнозирует, что к 2026 году появится «мощный ИИ» (не AGI, обратите внимание), способный превзойти лауреатов Нобелевской премии в таких областях, как биология и инженерия. Он считает, что этот ИИ сможет управлять любым программным или аппаратным обеспечением, выполнять большинство работ, которые сейчас делают люди, и даже проектировать собственные инструменты. ИИ, по его мнению, справится с мировым голодом, остановит изменение климата и превратит экономику развивающихся стран в настоящие райские кущи.

Однако он признает потенциальную опасность ИИ для гражданского общества и намекает, что неплохо бы обсудить, как будет устроена экономика в мире, где главный работник — искусственный интеллект.

Прочитать полное эссе можно тут.

OpenAI проводит конференцию DevDay

Пока в Anthropic предрекают светлое будущее, OpenAI анонсирует массу новых инструментов.

Компания представила Canvas — новый интерфейс ChatGPT, оптимизированный для проектов по написанию текстов и программированию. Canvas открывает отдельное окно рабочего пространства, где пользователи могут генерировать текст или код, а затем выбирать разделы для редактирования ИИ-моделью.

Другое нововведение — Realtime API, который позволит встраивать в продукты ИИ, способный вести текстовый или голосовой диалог практически без задержек. Также добавлена тонкая настройка, дающая возможность использовать изображения для обучения приложений — достаточно загрузить 100 картинок, чтобы модель научилась распознавать необходимые объекты.

Кроме того, OpenAI представила кэширование запросов для API, что значительно сократит время отклика и нагрузку на серверы, а также дистилляцию моделей, позволяющую сжимать крупные модели до более компактных версий с сохранением производительности на узком спектре задач. При этом компания заявила, что в этом году не планируется выпуск новых моделей, таких как o1 и Sora, так что ждем дальше.

Завершилось соревнование Kaggle по предсказанию пользовательских предпочтений

На платформе Kaggle завершилось соревнование, организованное совместно с LMSYS, в котором участники должны были предсказывать пользовательские предпочтения, определяющие места моделей на чатбот-арене. Разборы решений победителей уже доступны на YouTube и в виде райтапа на Kaggle.

Среди интересных выводов: модель Gemma-2-9b оказалась наиболее эффективной в понимании человеческих предпочтений; участники, использовавшие более крупные модели и дистилляцию, добились наибольшего успеха; специальные модели Reward/ranking показали себя эффективнее базовых или instruct моделей; псевдо-лейблинг вновь стал главным инструментом победителей, а усреднение оценок нескольких LoRA оказалось выигрышной стратегией.

ИИ-открытия

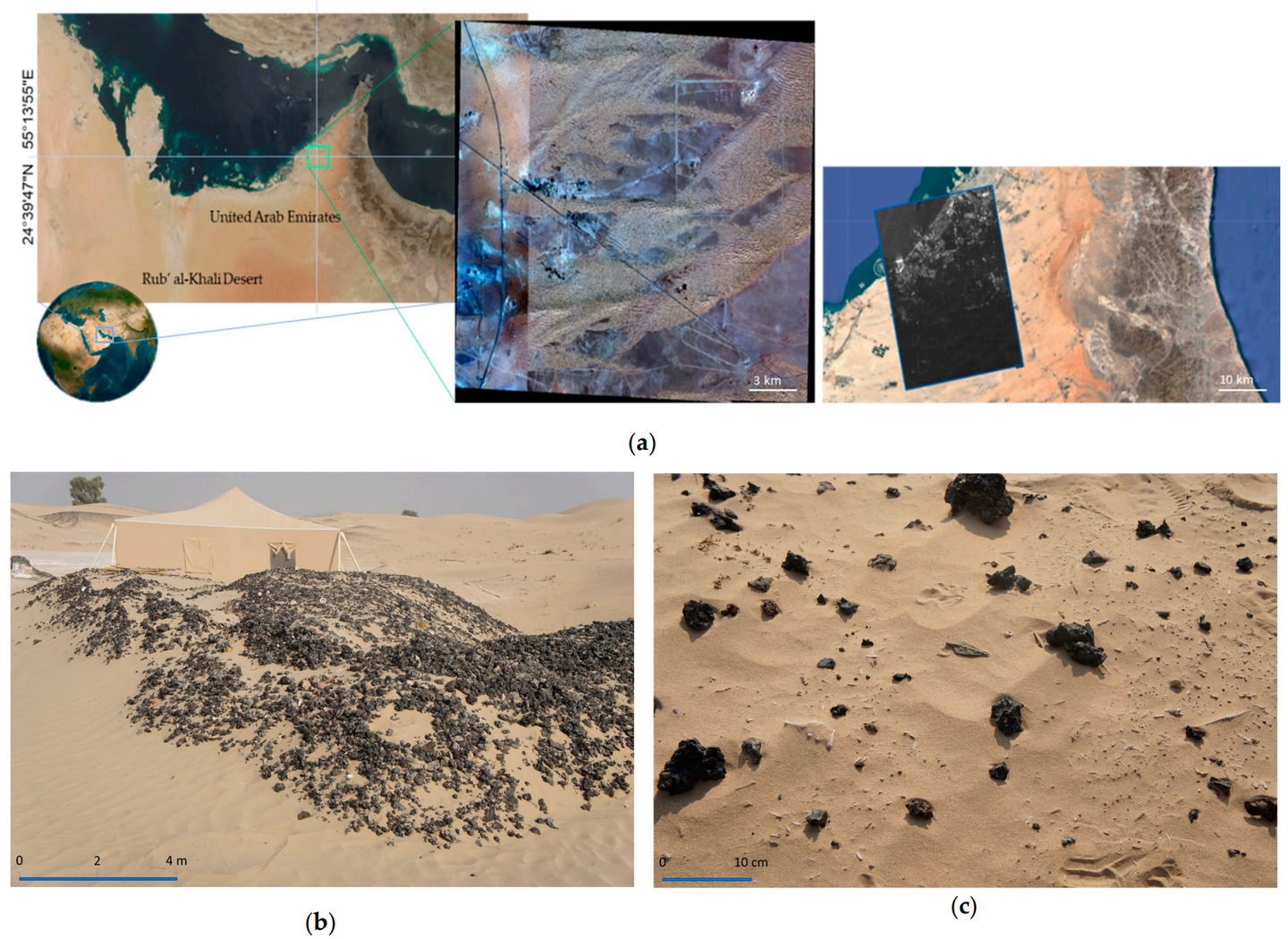

ИИ помогает раскрыть древние тайны Аравийской пустыни

Представьте себе археолога, бредущего по бескрайним просторам пустыни Руб-эль-Хали. Эта огромная пустыня, занимающая большую часть Аравийского полуострова, хранит свидетельства тысячелетней человеческой деятельности. Как тут можно найти хоть что-то? Даже ее название говорит само за себя — «Пустой квартал».

Команда исследователей из Университета Халифы в Абу-Даби нашла решение. Они разработали алгоритм машинного обучения, который может анализировать радиолокационные снимки с синтезированной апертурой (SAR) и находить потенциальные места для раскопок. В отличие от традиционных спутниковых снимков, SAR может проникать сквозь песок и растительность, выявляя структуры под поверхностью. Кто бы мог подумать, что компьютер станет лучшим другом Индианы Джонса?

Эмоции в цифрах: ИИ учится читать между строк (и твитов)

Искусственный интеллект проникает во все сферы нашей жизни, но может ли он понять наши чувства?

Ученые из Университета Окленда решили устроить ИИ экзамен по эмоциональной грамотности, используя посты из Twitter. Они использовали трансформер трансферного обучения, предварительно натренированный на огромных текстовых массивах, чтобы научить ИИ распознать радость, гнев, грусть и отвращение в постах пользователей. Результат? Впечатляющая точность в 84%. Но ученые на этом не остановились. Они проанализировали твиты с упоминаниями двух новозеландских организаций, принимающих пожертвования, и попытались разобраться, как выраженные в постах эмоции коррелируют с реальным поведением людей.

Оказалось, посты, передающие грусть, чаще побуждали людей жертвовать деньги в Фонд Фреда Холлоуза, тогда как гнев был связан с увеличением пожертвований Университету Окленда. Это показывает, что ИИ может не только распознавать эмоции, но и предсказывать их влияние на наши действия.

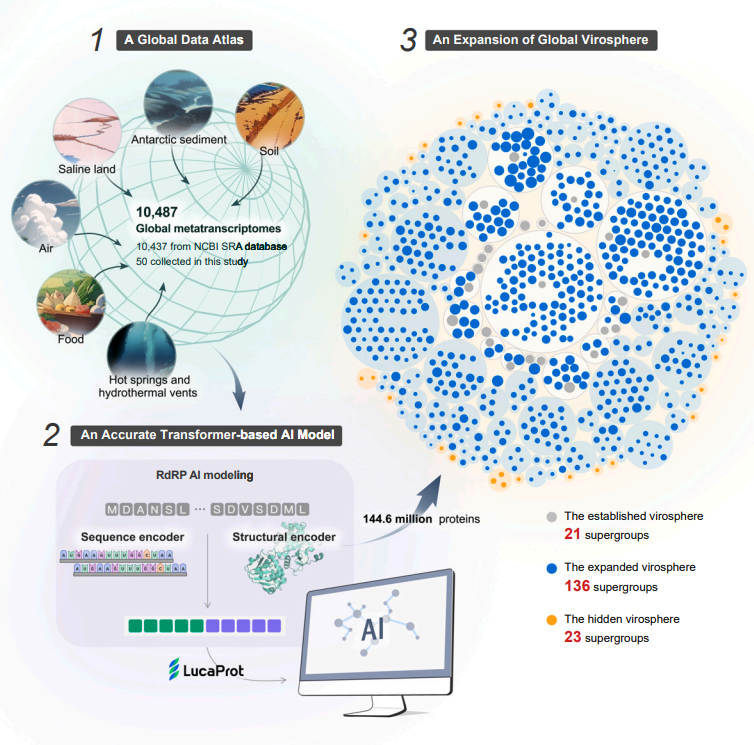

ИИ сканирует «темную материю» РНК и обнаруживает 70 000 новых вирусов

Ученые использовали ИИ для обнаружения 70 500 ранее неизвестных науке вирусов, многие из которых являются странными и непохожими на известные виды. РНК-вирусы были идентифицированы с помощью метагеномики — этот метод позволяет отбирать все геномы, присутствующие в окружающей среде, вместо культивирования отдельных вирусов.

Ши Ман, эволюционный биолог из Университета Сунь Ятсена в Шэньчжэне, Китай, и его коллеги разработали модель под названием LucaProt на основе архитектуры трансформер. Они обучили свою модель распознавать вирусные РНК-зависимые РНК-полимеразы (RdRp) и использовали ее для поиска последовательностей, кодирующих эти ферменты, в большом массиве геномных данных. Используя этот метод, они идентифицировали около 160 000 РНК-вирусов, в том числе некоторые исключительно длинные, обнаруженные в экстремальных условиях, таких как горячие источники, соленые озера и воздух.

Расширение пула известных вирусов облегчает поиск подобных им вирусов и помогает понять происхождение микробов и их эволюцию в различных хозяевах. Ши сейчас разрабатывает модель для прогнозирования хозяев этих недавно идентифицированных РНК-вирусов, надеясь, что это поможет ученым понять роль вирусов в их экологических нишах.

Целиком исследование можно почитать тут.

Новые модели и архитектуры

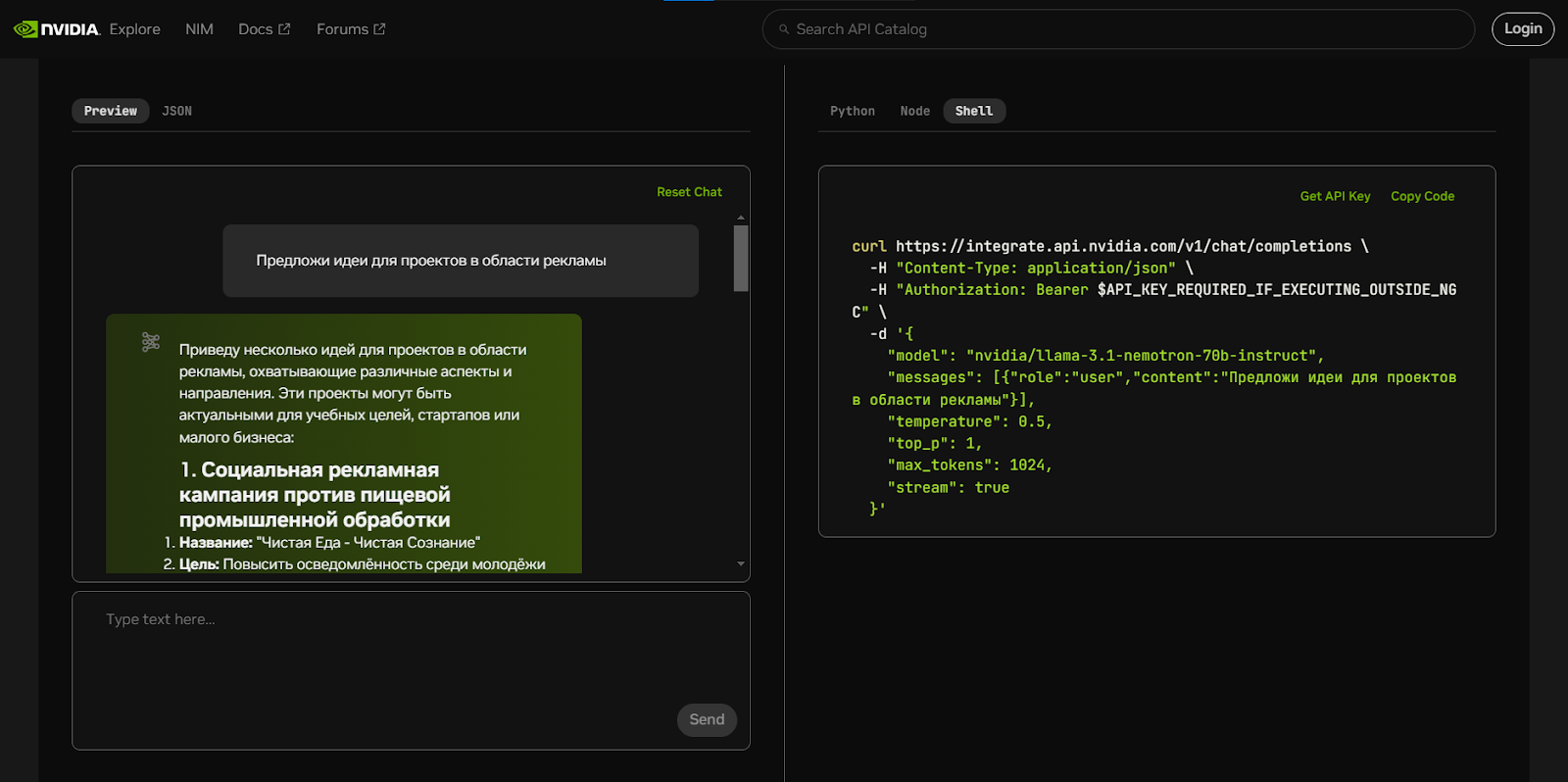

Nvidia выпускает новое семейство моделей

Nvidia представила новое семейство моделей NVLM 1.0 с открытым исходным кодом, по заявлениям способное конкурировать с ведущими моделями от OpenAI, Anthropic и Google. Флагманская модель NVLM-D-72B содержит 72 миллиарда параметров. Nvidia планирует сделать исходный код NVLM публично доступным, что контрастирует с подходом конкурентов, тщательно охраняющих свои модели.

Еще больше шума навела Llama-3.1-Nemotron-70B-Instruct. NVIDIA прокачала эту языковую модель, чтобы она выдавала ответы поумнее. В интернете разгоняют слух, что она лучше, чем GPT-4o и Sonnet-3.5, но это, конечно, не так. На самом деле их версия чуть хуже чистой Llama-3.1-70b (согласно бенчмарку MMLU), еще и с более жесткой цензурой.

MagicLabs представляет LTM-2-Mini с рекордным контекстом в 100 миллионов токенов

MagicLabs выпустила модель LTM-2-Mini с контекстным окном в 100 миллионов токенов. Это как если бы вы скормили ей 10 миллионов строк кода или 750 романов. Даже Толстой позавидовал бы такому объему. Благодаря архитектуре Long-Term Memory (LTM), не использующей attention, модель обходится в 1000 раз дешевле по сравнению с Llama 3.1 405B и требует для хранения KV-кэша лишь часть HBM одной видеокарты. MagicLabs уже заключила партнерство с Google Cloud и обучает более крупную версию LTM-2 на суперкомпьютере.

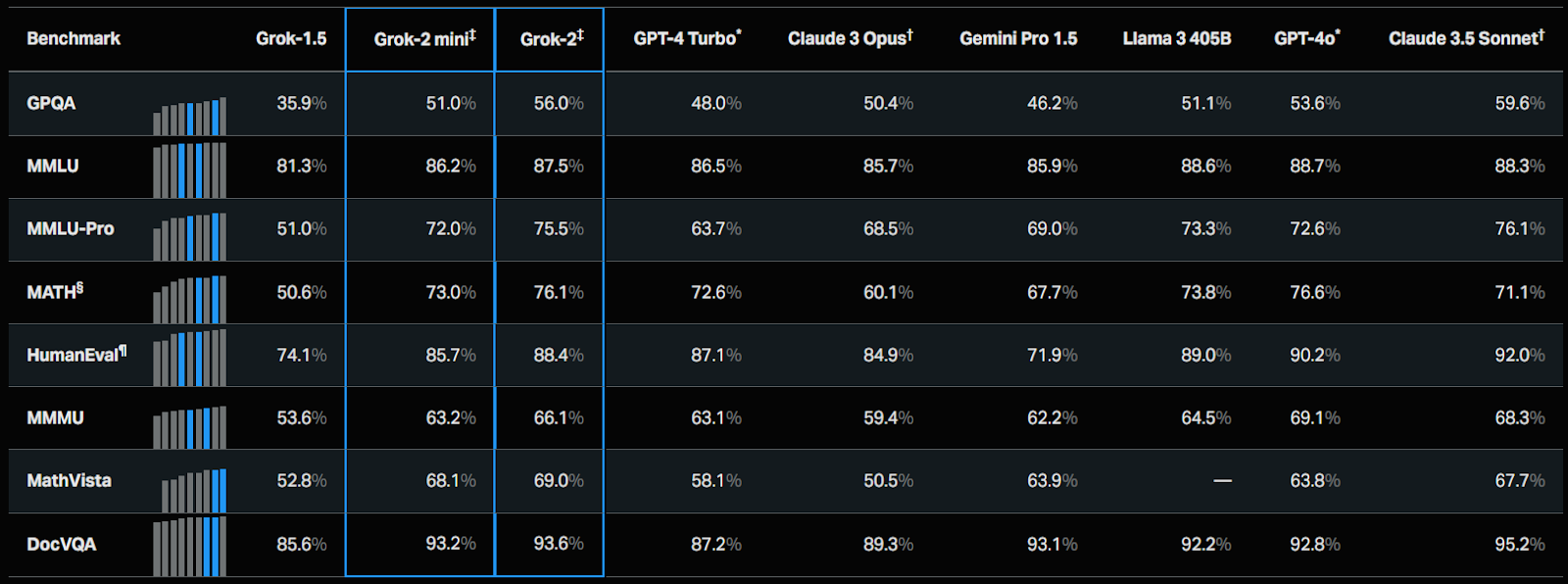

Открыт доступ к API Grok-2 и Grok-2 mini с конкурентными ценами

Наконец-то стал доступен API моделей Grok-2 и Grok-2 mini с контекстом в 33К токенов. Цены на использование составляют $4.2 за миллион токенов на входе и $6.9 за миллион токенов на выходе. Хотя цена на входные данные несколько завышена по сравнению с конкурентами, стоимость выходных данных, напротив, ниже обычного. Первые тесты показали, что Grok-2 уступает закрытым моделям в программировании, несмотря на высокие результаты на арене LMSYS.

Инструменты для создания контента

Adobe запускает генератор видео Firefly с расширенными возможностями

Adobe выпустила свой генератор видео Firefly, предлагающий пользователям широкие возможности настройки, включая частоту кадров, ширину угла и наклон камеры. Firefly позволяет «переснимать» отдельные элементы в готовом видео, дополнять текстовый промт картинкой-референсом и создавать ролики длительностью до 5 секунд в HD-разрешении. Доступ пока только в порядке очереди на сайте Adobe.

Microsoft дает Copilot голос и зрение в самом масштабном редизайне

Microsoft капитально перелопачивает Copilot. Теперь с голосом и зрением для создания более персонализированного и интерактивного опыта взаимодействия с пользователем.

Meta анонсирует Movie Gen — ИИ-генератор видео

Meta представляет Movie Gen — ИИ-инструмент для генерации видео, способный создавать высококачественные ролики со звуком, а также редактировать существующие видео или изображения на основе текстовых запросов.

Pika 1.5 — значительное обновление ИИ-генератора видео

Pika Labs выпустила Pika 1.5 — продвинутую модель генерации видео с акцентом на гиперреализм. Обновление предлагает более естественные движения людей и существ, а также сложные методы работы с камерой для улучшения процесса создания видео.

Все пользователи Gemini теперь могут создавать изображения с помощью Imagen 3

Пользователи Gemini смогут генерировать изображения с помощью Imagen 3, который предлагает потрясающее качество изображений, реалистичные визуальные эффекты и разнообразные стили, и доступен для всех пользователей, включая бесплатные аккаунты.

Инструменты для поиска и анализа

Google Photos внедряет ИИ-поиск — возможно, крупнейшее обновление за годы

Google Photos начинает развертывание обновления на базе Gemini, позволяющего искать фотографии в библиотеке пользователя с помощью естественных языковых запросов. Это нововведение потенциально может заменить традиционные методы поиска. Правда, некоторые боятся за свою приватность.

Pinterest предоставит рекламодателям ИИ-инструменты для работы с изображениями товаров

Pinterest внедряет генеративные ИИ-инструменты, позволяющие рекламодателям улучшать изображения продуктов, привлекать больше кликов и создавать кампании с меньшими затратами. В итоге CTR растет, а цена за клик падает.

Визуальный поиск Google теперь может отвечать на еще более сложные вопросы

Google Lens научили отвечать на еще более заковыристые вопросы. Теперь он поддерживает мультимодальные запросы, расширенные функции покупок и захват видео в реальном времени. Таким темпом скоро и умные очки подвезут.

Фреймворки и экспериментальные возможности

OpenAI выпускает Swarm — экспериментальный фреймворк для построения, оркестрации и развертывания многоагентных систем

Фреймворк Swarm от OpenAI упрощает сложности оркестрации кучи агентов. Легковесная и управляемая инфраструктура, основанная на взаимодействии агентов и передаче задач.

Zoom позволит ИИ-аватарам общаться с вашей командой вместо вас

Zoom внедряет ИИ-аватары, которые могут посещать встречи и отправлять сообщения от вашего имени. Для создания цифрового двойника, выглядящего и звучащего как вы, используется ваше видео.

OpenR — открытый фреймворк, улучшающий рассуждение в больших языковых моделях

OpenR — новый фреймворк с открытым исходным кодом, прокачивающий способность LLM к рассуждению. Он интегрирует передовые методы обучения и обучение с подкреплением для устранения ошибок в умозаключениях моделей.

Что почитать

Напоследок хотим поделиться подборкой интересных свежих исследований по ИИ и ML.

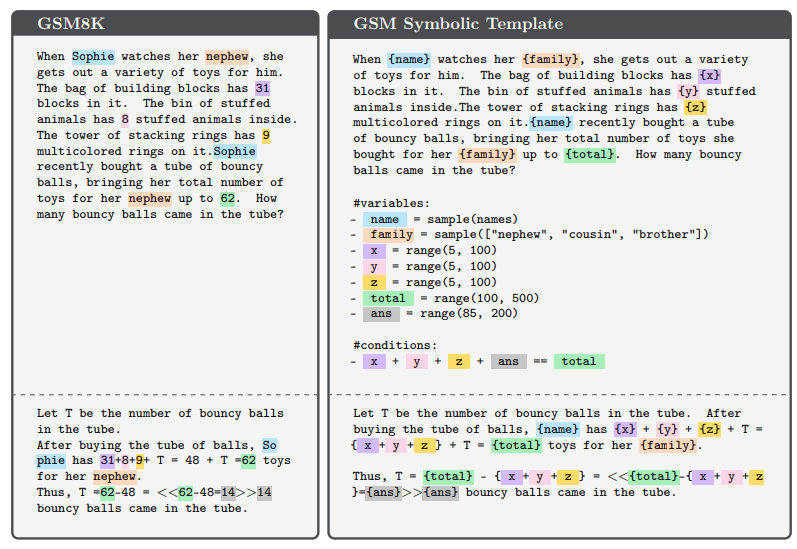

Исследователи Apple предполагают, что LLM не способны к «подлинному логическому рассуждению»

О чем: Ученые из Apple показали, что продвинутые большие языковые модели (LLM) тупят в математике при незначительных изменениях условий. Никаких подлинных навыков логического рассуждения у них нет.

«Addition is All You Need for Energy-efficient Language Models» — сложение вместо умножения для энергоэффективных языковых моделей

О чем: Эффективное использование энергии в языковых моделях через замену операций умножения с плавающей запятой на операции сложения целых чисел, что позволяет снизить энергозатраты на 95%.

Differential Transformer — новая модель трансформера для улучшения моделирования языка

О чем: Новая модель дифференциального трансформера Diff Transformer подавляет шум и способствует разреженным паттернам внимания. Обходит традиционный трансформер в моделировании языка и предлагает плюшки для практических приложений.

Anchor-based Large Language Models — новый подход к сжатию информации в последовательностях

О чем: AnLLM — новый подход, использующий самовнимание на основе якорей для сжатия информации в последовательностях. Позволяет уменьшить кэш и повысить эффективность вывода. Потенциально можно выводить в реальном времени.

MLE-bench — оценка производительности агентов машинного обучения в инженерии машинного обучения

О чем: MLE-bench представляет собой бенчмарк для оценки производительности агентов ИИ в инженерии машинного обучения. Используют 75 соревнований с Kaggle, чтобы проверить навыки ML-инжиниринга в реальном мире.

RATIONALYST — предварительное обучение с контролем процесса для улучшения рассуждений

О чем: RATIONALYST вводит контроль процесса для рассуждений путем предварительного обучения на обширной коллекции аннотаций с обоснованиями, что повышает точность в различных задачах на рассуждение.

Presto! Ускорение генерации музыки с помощью методов дистилляции

О чем: Presto! представляет новый подход к ускорению генерации музыки с помощью методов дистилляции. Результаты — высокое качество, улучшенное разнообразие и значительно более быстрая обработка.

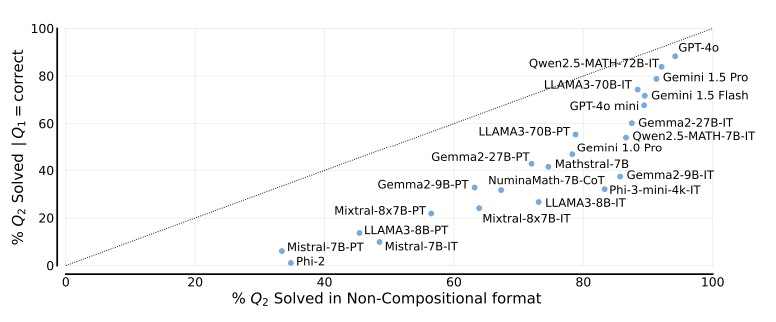

«Not All LLM Reasoners Are Created Equal» — пробелы в рассуждениях LLM при решении математических задач

О чем: LLM демонстрируют значительные пробелы в способностях к рассуждению при решении математических задач школьного уровня, причем у более мелких специализированных моделей этот разрыв выражен сильнее.

«LLMs Know More Than They Show» — внутренние представления LLM кодируют информацию о правдивости

О чем: Внутренние представления LLM кодируют информацию о правдивости, которую можно использовать для обнаружения ошибок и прогнозирования типов ошибок, которые модель может допустить. Это дает возможности для улучшения анализа и смягчения ошибок.

«Concise Machine Learning» — краткий курс машинного обучения от UC Berkeley

О чем: Отчет содержит конспекты лекций вводного курса по машинному обучению в UC Berkeley, охватывающего многие методы классификации, регрессии, кластеризации и снижения размерности.

На этом у нас все. Надеемся, что наша подборка была для вас интересной и полезной.

Мы хотим сделать этот дайджест действительно ценным и информативным, поэтому нам очень важно знать ваше мнение. Что вам понравилось в этом выпуске? О каких темах или событиях вы хотели бы узнать больше? Может быть, недостаточно мемов с котиками? Поделитесь с нами своими мыслями в комментариях!

Автор: full_moon