Бионические протезы прошлого поколения обычно контролируются с помощью миоэлектрических сигналов, которые возникают в результате мышечных сокращений руки человека. Управлять таким протезом непросто: это требует определённой концентрации, да и эффективность успешных действий оставляет желать лучшего. Непросто с первого раза сделать то, что хочется. По точности действий таким протезам далеко до «интуитивных» действий живой настоящей руки.

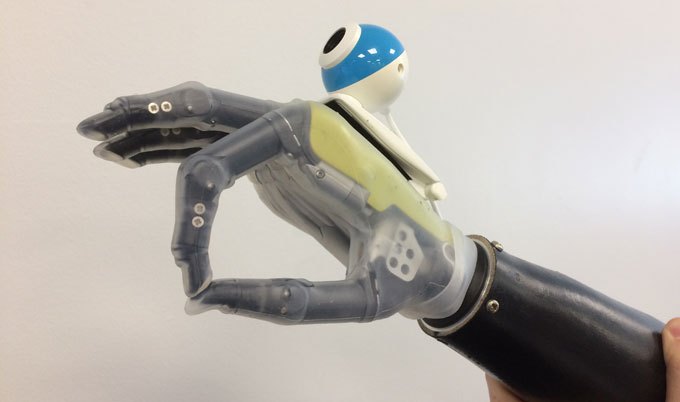

В последние годы исследователи концентрировались преимущественно на точности распознавании миоэлектрических сигналов, а точность распознавания движений отдельных пальцев достигла 90%. Но в силу ряда технических причин массовое использование таких «умных» протезов сильно ограничено. Новая разработка инженеров из Университета Ньюкасла (Великобритания) предлагает принципиально иной подход. Оснащённая видеокамерой рука распознаёт предмет перед ней — и сама определяет, каким образом эффективнее всего его схватить. Она действует автоматически и практически мгновенно, без дополнительных усилий со стороны человека. Фактически, у бионической руки появляется собственное зрение.

Ранее учёные экспериментировали со стереокамерами и разными алгоритмами распознавания объектов. Параллельно создавались новые модели манипуляторов для роботов — там технологии компьютерного зрения очень похожи на бионические протезы для людей. Именно в сфере робототехники тестировались наиболее перспективные технологии машинного зрения и глубинного обучения.

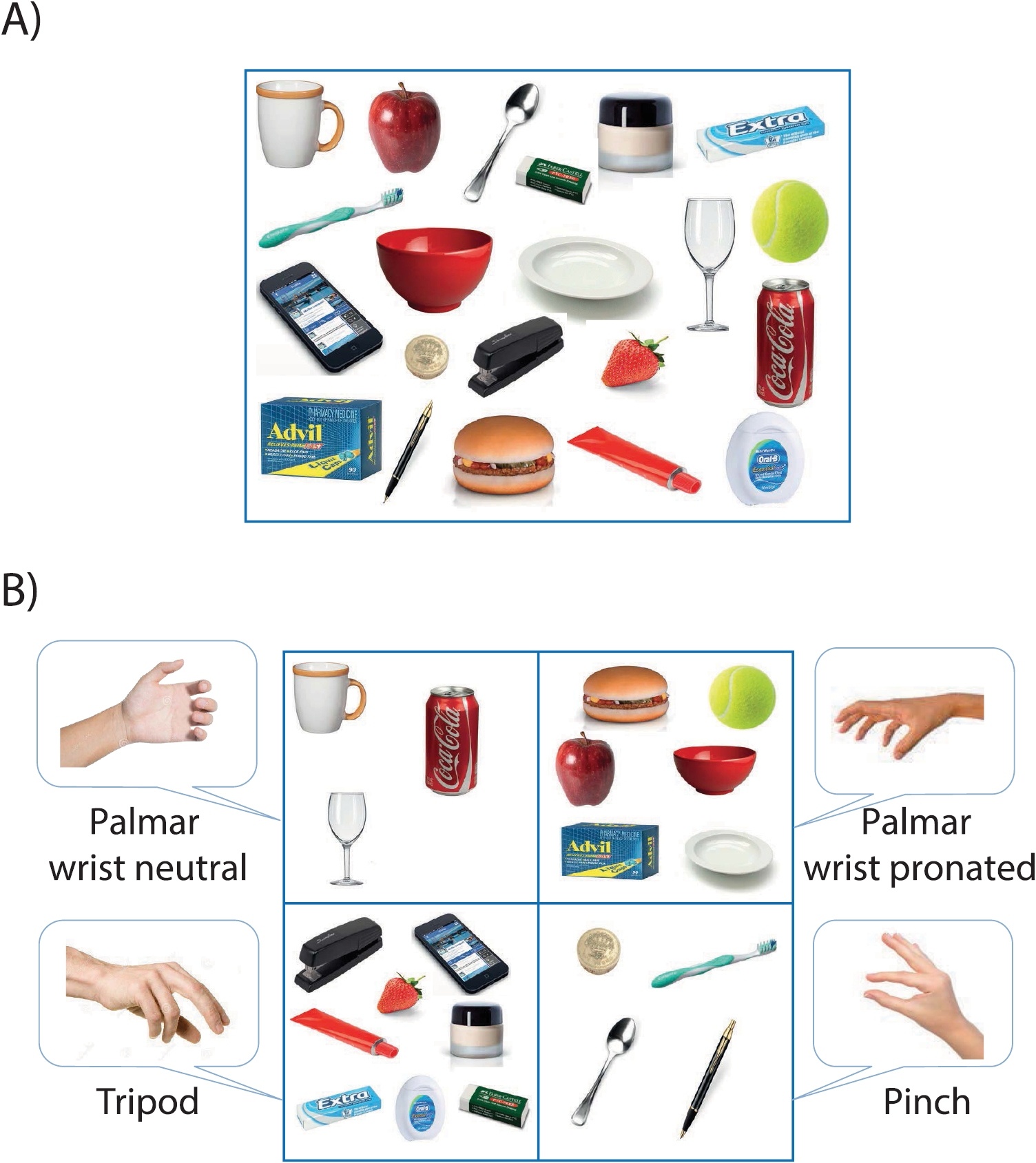

Инженеры из Университета Ньюкасла использовали эти наработки своих предшественников и нацелили систему машинного зрения распознавать тип захвата для объектов разного вида, а не на основании конкретного измерения его размеров. То есть объекты после обучения нейросети классифицируются именно по типу захвата, а не по типу или категории объекта. Авторы считают, что за счёт такого принципиально нового подхода им удалось существенно улучшить быстродействие системы, поскольку она игнорирует ненужные детали.

Для сравнения: классификация по категории объекта (вверху) или по одному из четырёх типов захвата (внизу)

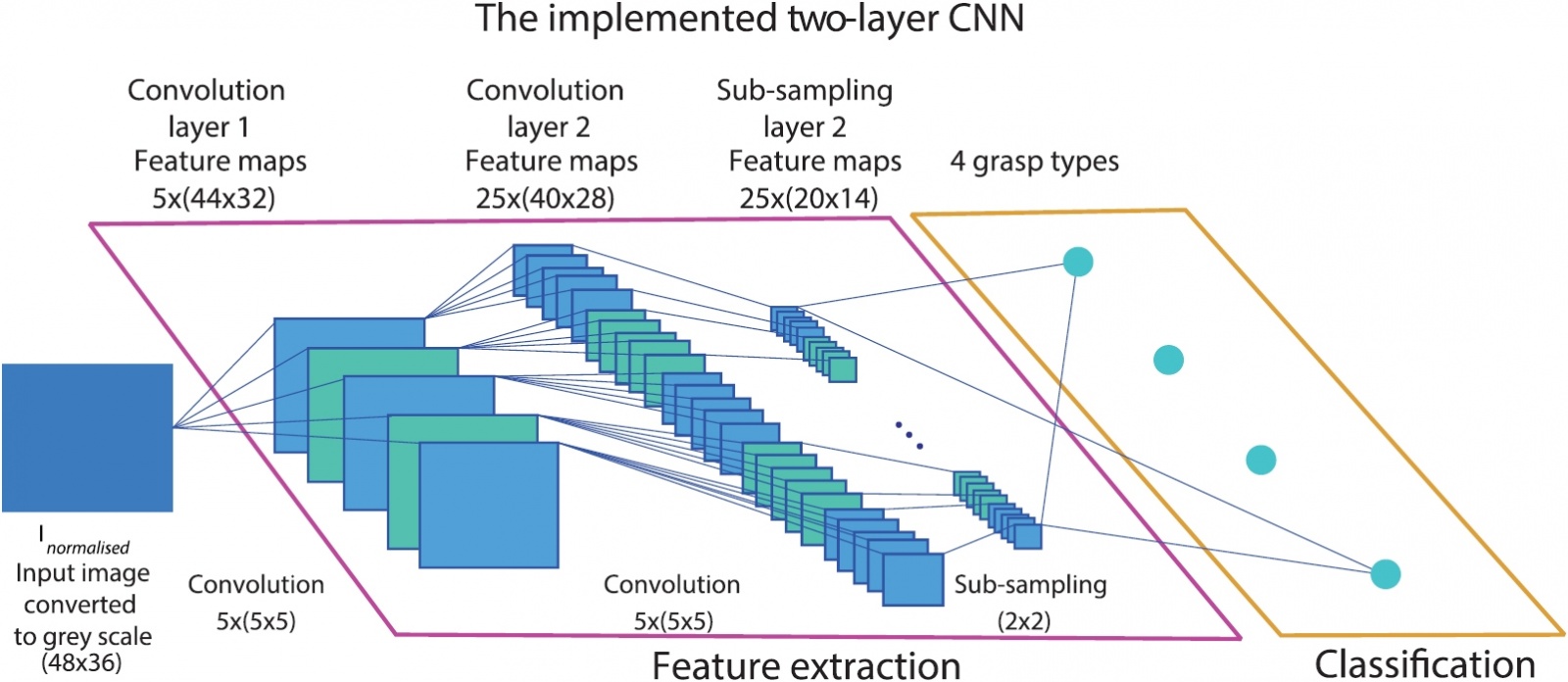

Для обучения системы использовалась свёрточная нейронная сеть. Оказалось, что её архитектура отлично подходит для такого типа задач, а именно для бионических протезов руки. Например, другие методы машинного зрения испытывали проблемы, когда сталкивались с объектами, которые не попадают ни в одну из известных категорий. А ведь идентификация неизвестных объектов — одно из важнейших качеств бионического протеза с машинным зрением. Поэтому свёрточная нейросеть идеально подходит для такой задачи.

Обучение системы происходило на амстердамском банке изображений, где присутствует большое количество домашних объектов.

Архитектура двухслойной свёрточной нейросети для извлечения признаков и классификации показана на иллюстрации внизу.

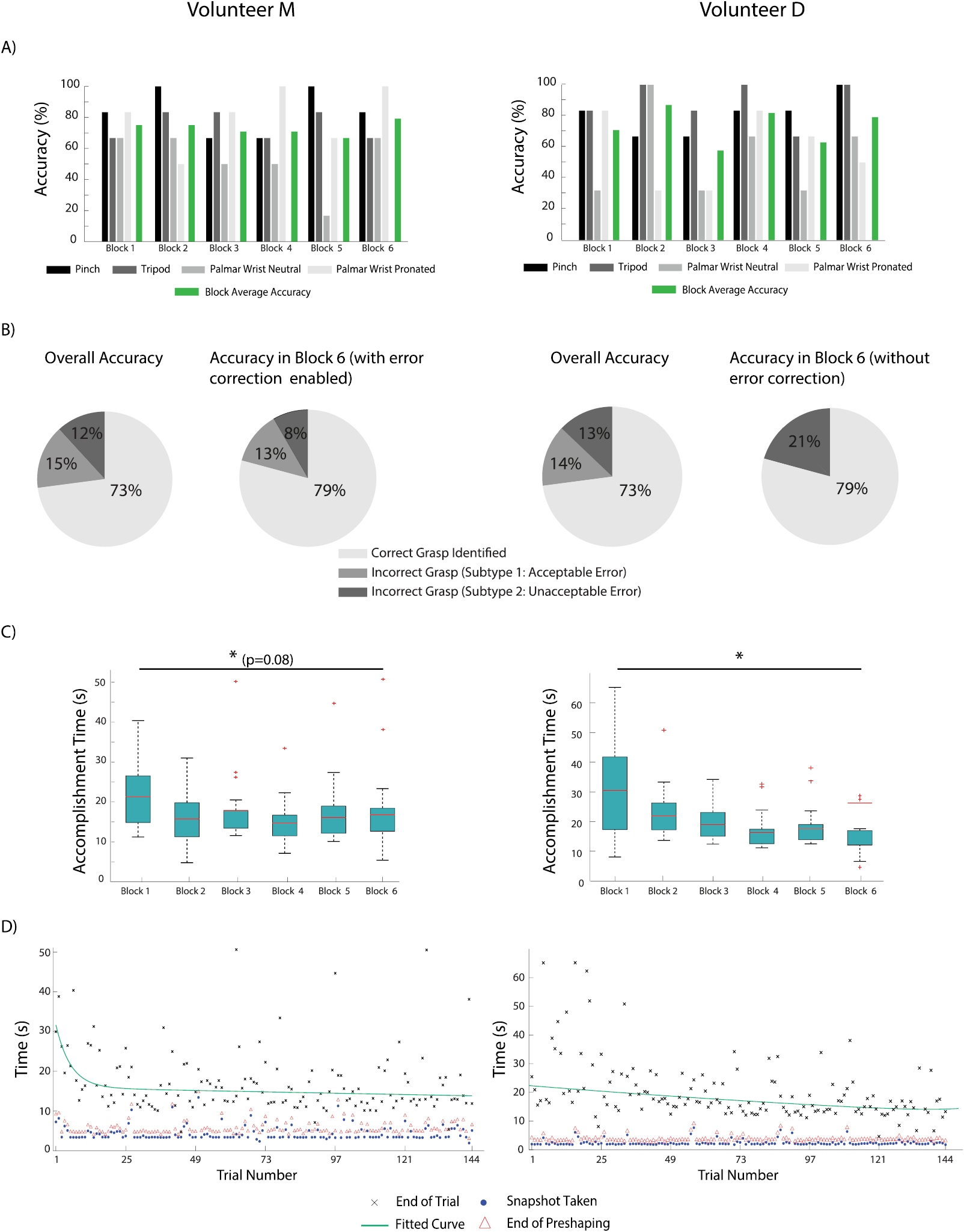

В тестах на реальных пациентах с протезами систему проверяли на 8 известных и 16 неизвестных предметах в случайном положении. Результаты для двух добровольцев показаны на графиках слева и справа. С учётом допустимых ошибок точность распознавания и захвата предметов составила 88% и 87% для первого и второго добровольца, соответственно.

Самое главное, что такой бионический протез работает практически в реальном времени: выбор типа захвата осуществляется за миллисекунды, в отличие от 0,75-24 секунд для бионических рук, где машинное зрения выполняет классификацию объектов. Даже лучшие бионические протезы такого типа CyberHand и SmartHand справляются с распознаванием за 4 и 1 секунду, соответственно. Они работают под управлением мощных компьютеров и показывают точность захвата 93% и 94%, соответственно. Хотя там чуть выше точность, но захват в реальном времени или с паузой одну секунду — это большая разница, так что достижение британских биомедицинских инженеров не нужно недооценивать. Это первая бионическая рука, которая умеет хватать объекты «интуитивно», как бы не думая. Человек только подаёт сигнал небольшим движением мышцы, что предмет нужно захватить — а умная рука с нейросетью быстро делает всё остальное самостоятельно.

Научная статья опубликована 3 мая 2017 года в журнале Journal of Neural Engineering (doi: 10.1088/1741-2552/aa6802).

Автор: alizar